Er zijn strenge wetten nodig voor deepfake-porno, zeggen vrouwen die te maken hebben met AI-misbruik

De wetgeving heeft geen gelijke tred gehouden met de vooruitgang op het gebied van AI-technologie, waardoor makers van deepfake-pornografie ongestraft kunnen opereren.

- Deepfake-porno kan vrouwen afschrikken van het openbare leven

- Er zijn maar weinig landen die deepfake-wetten hebben

- Makers als ‘whack-a-mole’ opsporen

LONDEN – Toen techniekstudent Taylor Klein te horen kreeg dat ze in een pornovideo zat, was ze ervan overtuigd dat haar vriendin zich vergiste, maar tot haar schrik ontdekte ze al snel een zestal expliciete clips online.

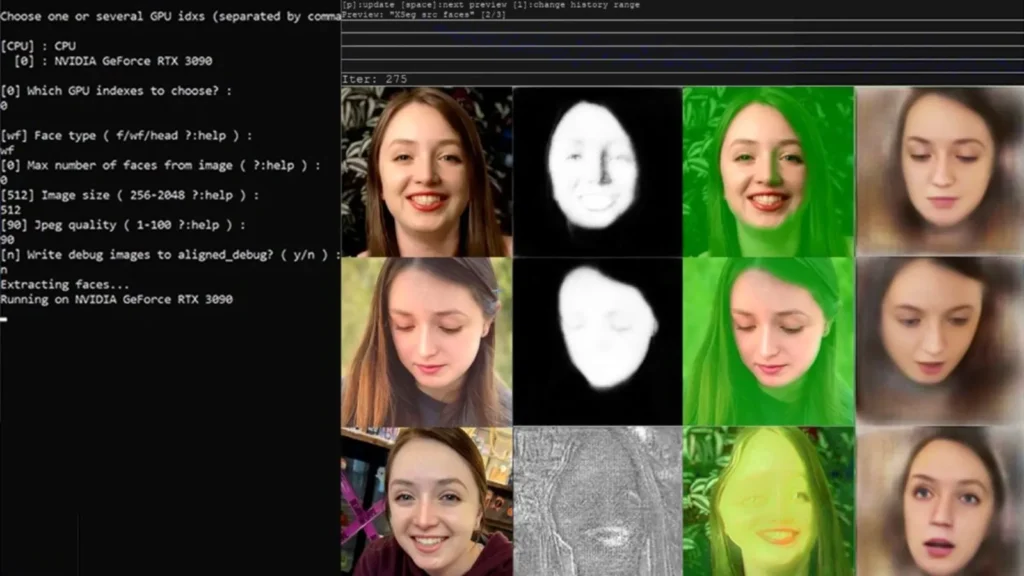

De realistische video’s – bekend als deepfakes – zijn gemaakt met behulp van generatieve kunstmatige intelligentie (AI) om Kleins gezicht over een andere vrouw heen te leggen, maar toen ze naar de politie ging, vertelden ze haar dat er geen wet was overtreden.

“Ik was gewoon doodsbang dat er iemand was die mij dit wilde aandoen”, zei de studente, die haar zoektocht naar gerechtigheid vertelt in een nieuwe film genaamd “Another Body”.

Klein stemde er alleen mee in haar verhaal op film te vertellen als haar identiteit verborgen was. Taylor Klein is een pseudoniem en tijdens de documentaire onthult ze dat, hoewel kijkers naar haar kijken, het gezicht dat ze kunnen zien een door AI gegenereerde deepfake is, gemaakt met behulp van de kenmerken van een acteur.

De documentaire, die prijzen heeft gewonnen op filmfestivals en begin februari door de BBC zal worden vertoond, onderzoekt hoe zeer beledigende deepfake-porno zich ongecontroleerd door wet- en regelgeving heeft kunnen verspreiden.

“Dit is niet langer een niche. Het heeft echt de mainstream bereikt en explodeert”, vertelde co-regisseur van de film, Sophie Compton, aan Context. “We moeten nu handelen.”

Een fragment uit de film Another Body. WILLA/Hand-out via Thomson Reuters Foundation

Campagnevoerders zeggen dat de snelle vooruitgang op het gebied van AI-technologie en het ontbreken van wetgeving ervoor hebben gezorgd dat deepfake-porno tot bloei is gekomen, gefaciliteerd door Big Tech, van zoekmachines tot internetproviders en sociale media.

De verwoestende gevolgen van deepfake-misbruik werden vorig jaar benadrukt toen een Egyptische tiener zelfmoord pleegde nadat ze was gechanteerd vanwege verzonnen beelden. Ze liet een briefje achter met de tekst: “Mam, geloof me alsjeblieft. Het meisje op die foto’s ben ik niet”.

Volgens technologie-experts verdubbelt de productie van deepfakes elke zes maanden, en hoewel politici en de media zich hebben geconcentreerd op hun potentieel om verkiezingen te verstoren en de democratie in gevaar te brengen , is de overgrote meerderheid van deepfakes – ongeveer 90% – porno van vrouwen zonder wederzijdse toestemming. .

Rechtengroep Equality Now, die een mondiaal onderzoek naar relevante wetgeving uitvoert, heeft landen opgeroepen krachtige wetten in te voeren om het probleem aan te pakken.

Vrouwen die het doelwit waren, vertelden Context dat wetgeving ook gepaard moet gaan met betere politietraining en een bredere verschuiving in de culturele houding, waarbij maar al te vaak de slachtoffers van seksueel misbruik op internet de schuld krijgen in plaats van de daders.

Risico van massale monddood maken van vrouwen

Campagnevoerders zeiden dat deepfake-misbruik niet alleen ‘levensvernietigend’ was voor individuen, maar ook ernstige sociale gevolgen zou kunnen hebben – vrouwen ervan weerhouden deel te nemen aan het openbare leven en hen van online platforms te verdrijven, wat zou leiden tot een massale monddood maken van vrouwen.

Ook wij hebben jou steun nodig in 2025, gun ons een extra bakkie koffie groot of klein.

Dank je en proost?

Wij van Indignatie AI zijn je eeuwig dankbaar

Noelle Martin, een Australisch juridisch onderzoeker en een van de eerste vrouwen wereldwijd die zich uitsprak over het doelwit, zei dat deepfake-porno vaak als wapen werd gebruikt tegen vrouwen in banen als de politiek en de journalistiek om hen te intimideren en te ondermijnen.

Bekende doelwitten van deepfake-porno zijn onder meer de Amerikaanse vice-president Kamala Harris en politici Alexandria Ocasio-Cortez en Lauren Book, de voormalige Duitse bondskanselier Angela Merkel, klimaatactiviste Greta Thunberg en de Britse actrice en voorvechter van vrouwenrechten Emma Watson.

“Niet alleen bestaat het gevaar dat de dreiging van deepfake-porno vrouwen zal afschrikken van het openbare leven, het kan er ook voor zorgen dat vrouwen zelfcensuur gaan uitoefenen”, zegt Martin.

Getroffen vrouwen zeiden dat het meestal onmogelijk was om te ontdekken wie de video’s had gemaakt of om ze te laten verwijderen, wat betekent dat het misbruik permanent was.

“Het zal er altijd zijn”, zegt Ruby, een Britse lerares die alleen maar haar voornaam wilde gebruiken. “Dat is iets waar slachtoffers zich heel bewust van zijn. Zelfs als je het kunt laten verwijderen, kan het weer opduiken.”

“Veel slachtoffers die ik ken, zijn nooit hersteld. Ze hebben hun online aanwezigheid volledig verwijderd. Ik ken vrouwen die hun baan hebben opgezegd. Sommigen zijn naar elders verhuisd. De impact is heel reëel.”

detective werk

Er zijn meer dan 3.000 sites gewijd aan deepfake-porno volgens #MyImageMyChoice , een campagne mede opgericht door Compton om een digitale fase van de #MeToo-beweging op gang te brengen en aan te dringen op wetgeving.

Compton zei dat het misbruik steeds meer werd gepromoot als een pornogenre, waarbij makers bedrijven en merken rond de praktijk bouwden.

In sommige gevallen maakten mensen zelfs deepfake-porno en vroegen hun doelwitten vervolgens om geld om deze te verwijderen.

Compton zei dat het erg moeilijk was om degenen achter het misbruik te identificeren, omdat velen tussen virtuele particuliere netwerken (VPN’s) sprongen, waardoor de jacht in een ‘whack-a-mole’-spel veranderde.

Sommige sites ordenen de inhoud op basis van de geografische locatie van de beoogde vrouwen, of zelfs op basis van hun universiteiten.

De Amerikaanse student Klein zei dat haar naam, universiteit en woonplaats bij de deepfakes waren geplaatst, wat haar ongerustheid verhoogde.

Door een hele reeks vernederende opmerkingen en bedreigingen onder de video’s was ze doodsbang dat gewelddadige mannen haar zouden proberen op te sporen. Ze vreesde ook dat de video’s zouden kunnen verschijnen als potentiële werkgevers antecedentenonderzoek zouden doen.

Omdat er geen hulp van de politie kwam, werd Klein zelf detective en struinde ze door een doolhof van duistere sites en forums.

Uiteindelijk identificeerde ze de deepfake-maker als een voormalige vriend van wie ze ontdekte dat hij zich op veel andere studenten had gericht, en een spraakmakende YouTuber, die de naam Gibi draagt.

Hoewel de politie de man die de deepfakes heeft gemaakt niet kan aanklagen, werkt Gibi samen met een advocaat om een civiele zaak tegen hem aan te spannen, die volgens Compton baanbrekend zou kunnen zijn.

Gebrek aan wetten

Equality Now zei dat maar heel weinig landen wetten hadden rond deepfake-seksueel misbruik.

Tot de koplopers behoren Australië, Zuid-Afrika en Groot-Brittannië, die onlangs een langverwachte Online Safety Act hebben aangenomen .

Equality Now’s digitale rechtenexpert Amanda Manyame zei dat andere wetten, zoals privacywetten, lasterwetten en wetten tegen desinformatie, in sommige landen bescherming zouden kunnen bieden, maar dit was nog niet in de rechtbank getest.

Omdat video’s mogelijk miljoenen keren worden gedeeld op verschillende platforms en rechtsgebieden, zei Manyame dat de wetgeving moet worden ondersteund door een sterke en gecoördineerde internationale reactie.

Campagnevoerders riepen ook op om Big Tech ter verantwoording te roepen.

Compton zei dat zoekmachines, internetproviders en betalingssystemen medeplichtig waren aan het faciliteren van de creatie en verspreiding van deepfake-porno.

“Deze (deepfake) sites opereren als bedrijven en wekken de indruk dat het een ander pornogenre is, terwijl dat niet het geval is. Het is misbruik”, zei ze.

Ze riep zoekmachines op om deepfake-porno te de-ranken en van de lijst te verwijderen en dat dienstverleners sites zouden blokkeren, waarbij ze erop wees dat ze dit al deden met afbeeldingen van kindermisbruik.

Een woordvoerder van Google zei dat ze de bescherming uitbreiden en het voor getroffen mensen gemakkelijker hebben gemaakt om de verwijdering van deepfake-porno zonder wederzijds goedvinden uit de zoekresultaten aan te vragen, en dat ze ook systemen hebben geïntroduceerd om duplicaten te detecteren en te verwijderen.

Maar Compton zei dat het moeilijker was om bedrijven te overtuigen om in actie te komen als er geen wetgeving bestond.

“Dit moet illegaal worden gemaakt om heel duidelijk te stellen dat dit niet iets is wat onze samenleving oké vindt, en om heel duidelijk aan technologiebedrijven te laten weten dat ze actie moeten ondernemen”, zei ze.