Sommige mensen geloven dat kunstmatige intelligentie (AI) ons hele leven zal verbeteren. Zelfrijdende auto’s zouden spoedig de verkeersveiligheid vergroten, alle logistiek zou veiliger, sneller en betrouwbaarder worden, en de droom van intelligente steden zou niet ver weg zijn.

Anderen zijn er daarentegen vast van overtuigd dat AI alle banen stap voor stap zal rationaliseren en ons allemaal zal laten bedelen voor een of andere vorm van basisinkomen. Weer anderen geloven dat AI iets van de toekomst is, een technologie die nog lang niet klaar is voor de markt en hen daarom niet beïnvloedt. Terwijl de eerste twee groepen op zijn minst gedeeltelijk gelijk hebben, heeft de derde groep helaas volkomen ongelijk. AI, die voor de meeste mensen een zwarte doos is en dat voor altijd zal blijven,

Alleen degenen die begrijpen wat AI is en hoe het moet worden gebruikt, kunnen zich verdedigen tegen de geplande aanvallen van dit soort technologie. Dus wat is AI? Er zijn verschillende definities voor AI, maar het gaat altijd om het programmeren, ontwerpen en bouwen van iets dat ‘intelligent’ reageert of zich gedraagt als ‘een mens’.

En dit is precies waar de denkfout schuilt: hoe geavanceerd een algoritme ook is, het zal zich nooit als een mens kunnen gedragen. Zelfs geavanceerde AI’s die zijn gebaseerd op neurale netwerken of zijn ontworpen om visuele stimuli op een vergelijkbare manier als hersencellen te verwerken, zullen nooit menselijk kunnen handelen.

Omdat mensen geen rationele wezens zijn; hoewel ze een logische geest hebben, worden ze onbewust beheerst door gevoelens en emoties. Daniel Kahneman, die in 2002 de Nobelprijs voor de Economische Wetenschappen kreeg voor zijn werk op het gebied van de psychologie van oordeels- en besluitvorming en gedragseconomie, heeft voor eens en voor altijd het idee van de Homo Economicus, dat wil zeggen de puur rationele individuele beslissingen nemen.

Een mens neemt geen puur rationele beslissingen zoals een AI; hij handelt en reageert vrijwel uitsluitend emotioneel. Omdat niets de poorten van de waarneming binnendringt dat niet eerst door de limbische structuren is gegaan om daar emotioneel geladen te worden. En alleen wat als emotioneel relevant wordt beschouwd, komt uiteindelijk onder onze aandacht. Het feit dat beslissingen in de hersenen grotendeels onbewust zijn en altijd emotioneel worden genomen, wordt tegenwoordig ook met succes gebruikt in de neuromarketing.

Het idee dat AI mensen kan vervangen is pure onzin, een verraderlijke manipulatie die wordt gebruikt om ons te laten geloven dat AI superieur is aan ons.

Iedereen die dit gelooft, kan maar al te gemakkelijk worden overgehaald om de controle over te dragen aan een ogenschijnlijk ‘alwetende’ AI, wat gezien de huidige ontwikkelingen fataal zou zijn. Omdat in een wereld waarin machines worden geclassificeerd als alwetend en superieur aan mensen, het eigen denken, het scepticisme en elke vorm van vrije besluitvorming uitsterven.

Gegevensdiefstal is gepatenteerd

Helaas wordt maar al te vaak genegeerd dat AI niet zou bestaan zonder enorme hoeveelheden data en dat het absoluut niets te maken heeft met wat wij onder intelligentie verstaan. AI vereist big data en zoals een artikel op de website van Biometric Update laat zien, nemen AI-technologieën nu al privégegevens over zonder angst voor de gevolgen. Het artikel “Clearview AI stelt de dienst voor gezichtsbiometrie beschikbaar aan het Oekraïense ministerie van Defensie.” (Clearview AI voorziet het Oekraïense ministerie van Defensie van een biometrische gezichtsherkenningsdienst) toont de ware omvang van de illegale gegevensverzamelingsmanie.

In het artikel maakt het bedrijf Clearview AI (Clearview) bekend dat het zijn biometrische app, die is gebaseerd op een database met miljarden foto’s van internetgebruikers, gratis ter beschikking zal stellen aan het Oekraïense Ministerie van Defensie . Ruim twee miljard van de ruim tien miljard foto’s die door internetgebruikers zijn gemaakt, zouden afkomstig zijn van de Russische sociale mediawebsite VKontakte.

Ik betwijfel ten zeerste dat de mensen die zo achteloos hun foto’s online delen, Clearview toestemming hebben gegeven om ze in een enorme database op te slaan en ze zonder onderscheid onder iedereen te verspreiden. Waar ik echter niet aan twijfel, is dat het Amerikaanse bedrijf ook alle foto’s van sociale media in Europa illegaal in zijn database heeft opgeslagen en door zijn AI heeft laten beheren.

De mede-oprichter van het bedrijf, Hoan Ton-That, een autodidactische ingenieur van Vietnamese en Australische afkomst, suggereerde ook dat de app ook zou kunnen worden gebruikt om Russische agenten te identificeren. Dit is uiterst gevaarlijk omdat in een oorlog elke tegenstander van welke aard dan ook kan worden gereduceerd tot een agent. Enkelen beslissen wie de goede en wie de slechte is. En wat er gebeurt met degenen die als kwaadaardig worden beschouwd, is uit de geschiedenis bekend.

Iedereen die gelooft dat AI er alleen is om ons leven gemakkelijker en beter te maken, zal nu ongelijk krijgen. Een technologie die het mogelijk maakt om de privégegevens van een persoon in databases op te slaan – zonder dat hij het weet – en mensen willekeurig als vijanden te definiëren wanneer dat nodig is, is niet alleen onverantwoord, maar ook uiterst gevaarlijk.

De maatschappelijke groepering Surveillance Technology Oversight Project wijst er in het bovenstaande artikel op dat technologieën die op het slagveld worden gebruikt, kunnen worden misbruikt. Ik ga nog een stap verder en zeg dat oorlogspropaganda er vrijwel zeker misbruik van zal maken.

Waarom de oprichters van dit bedrijf nog niet achter slot en grendel zijn gezet, hun winkel is gesloten en hun illegale databases zijn verwijderd, is een raadsel. Clearview wordt immers al geruime tijd geconfronteerd met beschuldigingen van massale surveillance en schending van de voorwaarden van sociale netwerken zoals Twitter en van de privacy van gebruikers.

Ondanks deze beschuldigingen werden de datadieven van Clearview op 15 februari 2022 beloond met een patent getiteld “Methoden voor het verstrekken van informatie over een persoon op basis van gezichtsherkenning.”

Dit ondanks het feit dat het patent een systeem beschrijft voor het gebruik van gezichtsherkenning, waarvan de informatie afkomstig is van het openbare internet. Het Amerikaanse bedrijf gebruikt de persoonlijke gegevens van mensen zonder hun toestemming te verkrijgen en verkoopt deze, ook zonder toestemming, aan wetshandhavingsinstanties en andere instellingen. Het is een schandaal dat zo’n product nog gepatenteerd kan worden.

De opmerking van CEO Hoan Ton-That is een farce: “Deze onderscheiding is meer dan de bescherming van intellectueel eigendom; “Het is een duidelijke erkenning van de technologische innovatie van Clearview AI in de kunstmatige intelligentie-industrie.”

Een AI die de wereld verandert

Maar het project van Clearview lijkt nog steeds ongevaarlijk als je het vergelijkt met de autonome AI van het Israëlische bedrijf Cortica . Algemeen directeur Igal Raichelgauz begon zijn carrière bij een elite-inlichtingeneenheid van de Israel Defense Forces (IDF) . Daarom is het niet verwonderlijk dat onder de medewerkers van Cortica, naast vooraanstaande AI-onderzoekers, ook talloze veteranen van Israëls militaire elite-inlichtingeneenheden zijn opgenomen.

De AI die de wereld moet veranderen is gebaseerd op jarenlang intern hersenonderzoek op delen van het brein van een rat. Volgens het bedrijf is de AI gemodelleerd naar de neuronactiviteit en leermechanismen van de hersenen van zoogdieren. De superioriteit van AI is gebaseerd op het feit dat het niet de concepten van eerdere deep learning- systemen gebruikt voor visuele gegevensverwerking, maar eerder hetzelfde proces als het menselijk brein. Om deze reden kan de AI, die wordt beschermd door 200 patenten, niet alleen concepten en contexten begrijpen, maar er ook conclusies uit trekken.

Tot nu toe wordt AI vooral geadverteerd voor het besturen van autonome auto’s of voor het voorspellen van complexe systemen zoals het weer, maar in het ‘nieuwe normaal’ zou het ook gebruikt moeten worden bij videobewaking. Het eerste project van dit type loopt sinds 2017 in India. In samenwerking met Best Group analyseert Cortica AI de gegevens van alle CCTV-camera’s in de openbare ruimte. In 2018 maakte Cortica publiekelijk bekend dat de AI , in de stijl van de sciencefictionfilm Minority Report , misdaden kon stoppen voordat ze werden gepleegd.

Deze aanpak, in vakjargon bekend als voorspellende misdaad , wordt al enige tijd getest in verschillende pilotprojecten wereldwijd, maar de technologie van Cortica is geavanceerder omdat deze zich richt op de mens zelf. De AI wil potentiële criminelen identificeren aan de hand van zogenaamde ‘gedragsafwijkingen’ in microgezichtsuitdrukkingen.

De veelbetekenende tekenen die erop kunnen wijzen dat iemand op het punt staat een gewelddadige misdaad te begaan, zijn zo klein dat ze alleen kunnen worden opgemerkt door het onvergankelijke oog van een AI, zegt het bedrijf.

De software moet niet alleen verschillen in gedrag herkennen tussen gezagsgetrouwe burgers en mogelijke criminelen, maar moet ook onderscheid kunnen maken tussen een vreedzame, overvolle markt en een politieke demonstratie die gewelddadig dreigt te worden.

Waar leiden dergelijke benaderingen ons naartoe? Willen we het toezicht op de openbare ruimte echt overlaten aan software waarvan we de programmering niet kennen en waarvan we de leerprocessen en beslissingen niet kunnen begrijpen? Willen we de intenties van een complex wezen als de mens laten beoordelen door een algoritme dat primitief is vergeleken met ons? En hoe willen we ons verdedigen tegen mogelijke beschuldigingen als een AI eenmaal als alwetend en onfeilbaar is geclassificeerd?

Wat als een totalitair regime een dergelijk systeem misbruikt om afwijkende meningen te onderdrukken en mensen te arresteren voordat ze zelfs maar de kans hebben gehad een protest te organiseren?

Als dergelijke dystopische vooruitzichten niet eng genoeg lijken, heeft Cortica nog een ander toepassingsvoorbeeld klaar: in de toekomst zou AI het gedrag van passagiers in autonome taxi’s kunnen monitoren om potentieel gevaarlijke situaties te identificeren en wetshandhaving te initiëren voordat er levens verloren gaan.

Heb je een slechte dag gehad, ben je boos op je partner of je baas? Ga in dat geval beter niet de openbare ruimte in, vermijd het gebruik van een taxi of verberg in ieder geval je gezicht voor het alziend oog van de AI. Omdat de geringste spiertrekking in hun gezicht, die woede, boosheid of misschien zelfs haat uitdrukt, ertoe zou kunnen leiden dat ze worden geïdentificeerd als een gevaar voor het publiek en dat ze preventief worden gearresteerd.

Een AI voor het maskertijdperk

Het voorbeeld van Corsight AI (Corsight) laat zien hoe ver AI kan afdwalen . Het particuliere bedrijf, opgericht in Tel Aviv in 2019, is een dochteronderneming van Cortica. De adviesraad van het bedrijf bestaat uit James Woolsey, een voormalig CIA-directeur, en voormalig adjunct-directeur van de FBI, Oliver Revell.

De autonome AI Fortify, die ook gespecialiseerd is in gezichtsherkenning , kenmerkt zich door het feit dat het ook onder moeilijke omstandigheden valide resultaten moet opleveren. Mensenmassa’s, slechte lichtomstandigheden en gedeeltelijk verduisterde gezichten mogen voor Fortify geen probleem vormen.

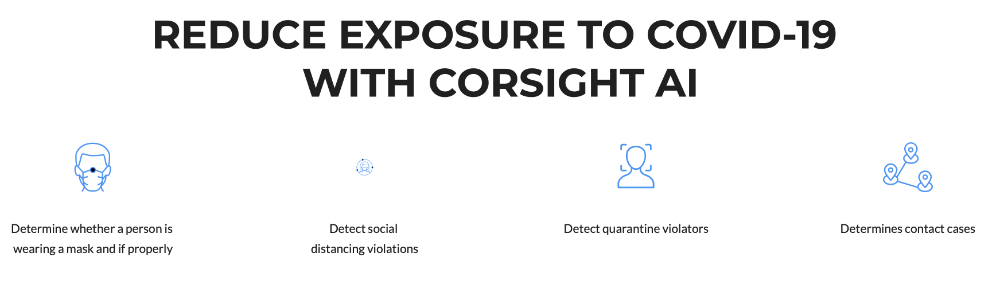

De Corsight AI is bedoeld om naleving van het nieuwe normaal te garanderen. Bron: Corsight AI-website

Het toezicht op de openbare ruimte moet voor ons allemaal een realiteit worden, zoals het geval is met China. Bron: Screenshotwebsite Corsight AI

Om deze reden promoot het bedrijf ook expliciet de tool voor het monitoren van pandemische maatregelen: “We leven in ongekende tijden met nieuwe sociale normen en uitdagingen. Nu gezichtsmaskers alomtegenwoordig worden, zijn er nieuwe oplossingen nodig om de veiligheidsnormen te handhaven.”

Om deze veiligheidsnormen te handhaven – een eufemisme voor totale controle – wordt Fortify verondersteld toezicht te houden op de naleving van alle quarantainebevelen.

Hiervoor controleert de software of mensen geen mondkapje dragen in ruimtes waar dit verplicht is; het bepaalt of mensen koorts hebben; houdt toezicht op contactloze toegangscontroles in bepaalde faciliteiten, naleving van afstandsregels en contacttracering om banen veilig te stellen en de verspreiding van infecties te voorkomen. Als bijvoorbeeld een veiligheidsbedreigende persoon wordt gedetecteerd die het masker niet correct draagt, kan Fortify in realtime een waarschuwing geven.

Het ‘DNA to Face’-project

Maar het mag niet stoppen bij conventionele gezichtsherkenning. Zoals onthuld in een presentatie voor de Imperial Capital Investors Conference 2021 , werkt het bedrijf aan een project dat het ‘DNA to Face’ noemt. Zoals de MIT Technology Review meldde, gebruikt deze aanpak niet het gezicht van een persoon voor identificatie, maar eerder zijn genetische materiaal, zijn DNA.

Er moet een model van het gezicht worden gemaakt op basis van het individuele DNA, dat vervolgens de fysieke tegenhanger uit een database filtert met behulp van op AI gebaseerde gezichtsherkenningssoftware. Naast ‘DNA to Face’ omvat de productroadmap ook loopbiometrie en op stemherkenning gebaseerde gezichtskenmerken, die bedoeld zijn om de gezichtsherkenningsmogelijkheden van de AI verder uit te breiden.

Volgens de huidige stand van kennis is een eenduidige gezichtsherkenning via het individuele DNA nog niet mogelijk, omdat de verschillende methoden voor fenotypering (dat wil zeggen het onderzoeken van de genen die verantwoordelijk zijn voor de uiterlijke kenmerken van een individu) alleen gebaseerd kunnen zijn op afkomst en geslacht afleiden, en met een zekere waarschijnlijkheid kunnen oog-, haar- en huidskleur worden bepaald.

Of een geldige gezichtsreconstructie op basis van het genetisch materiaal ooit mogelijk zal zijn, is nog maar de vraag, maar we werken er hard aan om dit idee werkelijkheid te laten worden. Burgerrechtenadvocaat en uitvoerend directeur van het Surveillance Technology Oversight Project (STOP) , Albert Fox Cahn, noemt het idee ‘pseudowetenschap’. Maar zoals de Corona-crisis heeft aangetoond, mag dit geen reden zijn om deze technologie – desnoods – aan ons te verkopen als absoluut serieuze wetenschap.

Het feit dat dergelijke procedures in de toekomst op grote schaal zullen worden toegepast, wordt ook ondersteund door het feit dat relevante wetten op dit gebied in Duitsland al zijn gewijzigd. DNA-fenotypering was in Duitsland tot eind 2019 verboden vanwege wettelijke beperkingen in het Wetboek van Strafvordering.

In 2018 werd forensische DNA-analyse uitgebreid door het regeerakkoord van 2018 : “DNA-analyse in strafzaken wordt uitgebreid met uiterlijke kenmerken (haar, ogen, huidskleur) en leeftijd (§ 81e StPO).” De wijziging werd op 15 november 2019 door de Bondsdag aangenomen en trad op 12 december 2019 in werking.

Artikel 81e StPO lid 2, zin 2 luidt nu als volgt: “Als niet bekend is van welke persoon het sporenmateriaal afkomstig is, kunnen aanvullende bepalingen worden gedaan over de oog-, haar- en huidskleur en de leeftijd van de persoon.” In Beieren is het zelfs toegestaan om de biogeografische oorsprong vast te stellen door middel van fenotypering.

De noodzakelijke wetten werden precies op het juiste moment gewijzigd, zodat gezichtsherkenning met behulp van DNA later geleidelijk kon worden uitgebreid tot onschuldige burgers. Want wie een potentiële crimineel zou kunnen zijn, wordt straks wellicht niet meer bepaald door een mens, maar door een ‘zelflerend’ algoritme.

Bewakingstechnologie zover het oog reikt

Ondanks zorgen over steeds invasievere surveillancetechnologieën groeit de markt voor menselijke identificatie met behulp van AI. De nieuwe voertuigen registreren al het individuele rijprofiel van hun eigenaar zonder dat deze er iets van merkt: acceleratie, remmen, snelheid, reactie op obstakels, waardoor er duidelijke conclusies kunnen worden getrokken over de bestuurder. Officieel wordt gezegd dat deze gegevens alleen worden verzameld om eventuele ongevallen te kunnen reconstrueren of de prestaties van het voertuig te optimaliseren, maar dat is waarschijnlijk maar de halve waarheid.

De resultaten van een project dat tot doel heeft mensen te herkennen aan de hand van hun hartslag, zijn onlangs gepubliceerd op de website van de Carlos III Universiteit in Madrid . Samen met de Shahid Rajaee Teacher Training University van Iran hebben de Spaanse onderzoekers software ontwikkeld die de individuele kenmerken van de hartslag, die uit een eenvoudig elektrocardiogram (ECG) kunnen worden gehaald, gebruikt om deze te identificeren.

Op basis van deze kenmerken analyseert het algoritme dynamiek, ritme, timbre, toonhoogte en tonaliteit – factoren die vaak worden gebruikt om audiobestanden te karakteriseren. De combinatie van deze parameters moet voor elke persoon uniek zijn en een nauwkeurigheid van 96,6 procent hebben.

Dit relatief eenvoudige concept zou vandaag al kunnen worden geïmplementeerd: als iedereen de nieuwste Apple Watch, die al een eenvoudige ECG kan opnemen, om zijn pols zou hebben, zou alleen het identificatie-algoritme in het horloge hoeven worden geïntegreerd.

Maar wearables zoals fitnesstrackers en horloges zullen waarschijnlijk niet eeuwig meegaan; ze zullen waarschijnlijk slechts een overgangstechnologie zijn en in de nabije toekomst verouderd raken. Chaotic Moon Studios, gevestigd in Austin, Texas, laat zien waar de reis naartoe gaat. Het bedrijf, dat in 2015 werd overgenomen door Accenture, een wereldwijd managementadviesbureau met ruim 336.000 medewerkers, beweert met zijn Tech Tats – elektronische tatoeages – al een apparaatonafhankelijk alternatief voor totale surveillance te hebben ontwikkeld .

Een bijzonder interessantere tatoeage die perfect zou passen in de geplande gezondheidsdictatuur is gebaseerd op een technologie die informatie van het menselijk lichaam kan analyseren en verzamelen. De speciale tatoeage kan zelfs met geleidende inkt in de huid worden ingebed.

De geleidende verf maakt het mogelijk een circuit te creëren dat gezondheids- en andere biometrische gegevens van het lichaam en de omgeving registreert. Het in 2015 gepresenteerde prototype kan, net als FitBit, Jawbone of de Apple Watch, gegevens verzamelen over de gezondheid en het milieu van de drager, deze naar de cloud uploaden en naar elk apparaat of elke faciliteit sturen.

Chaotic Moon Tatoo bewaakt de gezondheid. Bron: Screenshot YouTube

Is het een wonder dat Bill Gates niet ver achterloopt als het gaat om dit soort technologie. Gates gelooft dat de technologie van Chaotic Moon Studios in de nabije toekomst smartphones zou kunnen vervangen .

Klik hier voor deel 2 van het artikel.