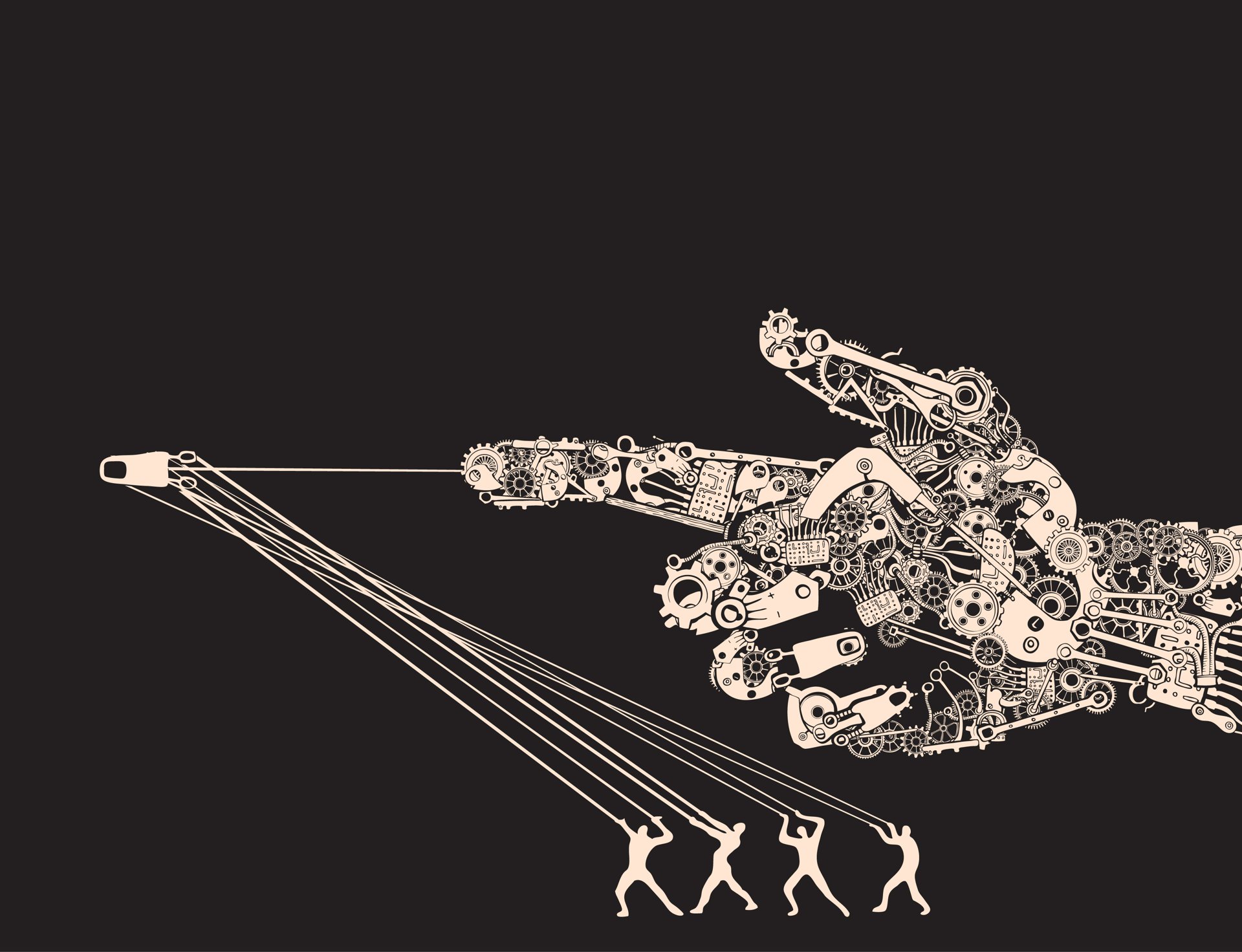

De oorlogen van morgen zullen sneller, hightech en minder menselijk zijn dan ooit tevoren. Welkom in een nieuw tijdperk van machinaal aangedreven oorlogvoering.

Wallops island – een afgelegen, moerassig land aan de oostkust van Virginia, in de buurt van een beroemde nationale schuilplaats voor paarden – staat meestal bekend als een lanceerplaats voor regerings- en privéraketten. Maar het zorgt ook voor een perfecte, rustige plek om een revolutionaire wapentechnologie te testen.

Als een vissersvaartuig afgelopen oktober langs het gebied was gestoomd, had de bemanning misschien een glimp van een half dozijn ongeveer 35 voet lange opblaasbare boten door het ondiepe water gelopen en er maar weinig over gedacht. Maar als bemanningsleden dichterbij hadden gekeken, zouden ze hebben gezien dat er niemand aan boord was: de gashendels van de motor verschoven op en neer alsof ze door geesten werden bestuurd. De boten gebruikten hightech uitrusting om hun omgeving te voelen, met elkaar te communiceren en zichzelf automatisch te positioneren zodat, in theorie, 50-kaliber machinegeweren die aan hun bogen kunnen worden vastgemaakt een gestage stroom kogels kunnen afvuren om troepen te beschermen landing op een strand.

De geheime inspanning – onderdeel van een Marine Corps-programma genaamd Sea Mob – was bedoeld om aan te tonen dat schepen uitgerust met geavanceerde technologie snel dodelijke aanvallen konden uitvoeren zonder een directe menselijke hand aan het roer. Het was succesvol: bronnen die bekend waren met de test beschreven het als een belangrijke mijlpaal in de ontwikkeling van een nieuwe golf van kunstmatig intelligente wapensystemen die binnenkort hun weg naar het slagveld zouden vinden.

Dodelijke, grotendeels autonome wapens zijn niet helemaal nieuw: een handvol van dergelijke systemen wordt al tientallen jaren ingezet, hoewel alleen in beperkte, defensieve functies, zoals het neerschieten van raketten die op schepen afsnellen. Maar met de ontwikkeling van AI-geïnfuseerde systemen staat het leger nu op het punt om veldmachines te gebruiken die in het offensief kunnen gaan, doelen uitkiezen en dodelijke actie ondernemen zonder directe menselijke input.

Tot nu toe hebben Amerikaanse militaire functionarissen machines niet de volledige controle gegeven en ze zeggen dat er geen vaste plannen zijn om dit te doen. Veel officieren – jarenlang geschoold in het belang van het beheersen van het slagveld – blijven diep sceptisch over het overdragen van dergelijke autoriteit aan een robot. Critici, zowel binnen als buiten het leger, maken zich zorgen over het niet kunnen voorspellen of begrijpen van beslissingen van kunstmatig intelligente machines, over computerinstructies die slecht zijn geschreven of gehackt, en over machines die op een of andere manier afwijken van de parameters die door hun uitvinders zijn gecreëerd. Sommigen beweren ook dat het toestaan van wapens om te beslissen om te doden in strijd is met de ethische en wettelijke normen voor het gebruik van geweld op het slagveld sinds de verschrikkingen van de Tweede Wereldoorlog.

Maar als de nadelen van het gebruik van kunstmatig intelligente oorlogsmachines duidelijk zijn, zijn de voordelen dat ook. Mensen hebben over het algemeen ongeveer een kwart seconde nodig om te reageren op iets dat we zien – denk aan een slagman die besluit te slingeren op een honkbalveld. Maar nu hebben machines die we hebben gemaakt ons overtroffen, althans qua verwerkingssnelheid. Eerder dit jaar richtten onderzoekers van de Nanyang Technological University in Singapore een computernetwerk op een dataset van 1,2 miljoen afbeeldingen; de computer probeerde vervolgens alle afgebeelde objecten in slechts 90 seconden of 0,000075 seconden per afbeelding te identificeren.

Het resultaat was niet perfect, of zelfs dichtbij: met die ongelooflijke snelheid identificeerde het systeem objecten slechts 58 procent van de tijd correct, een snelheid die catastrofaal zou zijn op een slagveld. Desalniettemin wordt het feit dat machines veel sneller kunnen handelen en reageren dan we kunnen relevanter naarmate het oorlogstempo versnelt. In het volgende decennium zullen raketten met een mijl per seconde in de buurt van de aarde vliegen, te snel voor mensen om zelf cruciale defensieve beslissingen te nemen. Drones vallen aan in zelfgeleide zwermen en gespecialiseerde computers zullen elkaar aanvallen met de snelheid van het licht. Mensen kunnen de wapens maken en ze eerste instructies geven, maar daarna voorspellen veel militaire functionarissen dat ze alleen maar in de weg zitten.

“Het probleem is dat wanneer je te maken hebt met [oorlog] op machinesnelheid, op welk punt de mens een belemmering is?” Robert Work, die als de 2e ambtenaar van het Pentagon in zowel de Obama- als de Trump-regering diende een interview. “Er is geen manier om een mens bij te houden, dus je moet delegeren aan machines.”

Elke tak van het Amerikaanse leger is momenteel op zoek naar manieren om dat te doen – om gigantische sprongen in beeldherkenning en gegevensverwerking te benutten met als doel een snellere, meer precieze, minder menselijke oorlogvoering te creëren.

De marine experimenteert met een schip van 135 ton, de Sea Hunter, dat zonder bemanning over de oceanen zou kunnen patrouilleren, op zoek naar onderzeeërs die op een dag rechtstreeks konden aanvallen. In een test heeft het schip de 2.500 mijl van Hawaii naar Californië al alleen gevaren, hoewel zonder wapens.

Ondertussen ontwikkelt het leger een nieuw systeem voor zijn tanks dat slim doelen kan uitkiezen en een pistool op hen kan richten. Het ontwikkelt ook een raketsysteem, de Joint Air-to-Ground Missile (JAGM) genaamd, dat voertuigen kan uitkiezen om aan te vallen zonder menselijke zeggenschap; in maart vroeg het Pentagon het Congres om geld om 1.051 JAGM’s te kopen voor een bedrag van $ 367,3 miljoen.

En de luchtmacht werkt aan een pilootloze versie van zijn legendarische F-16 straaljager als onderdeel van zijn provocerend “SkyBorg” -programma, dat op een dag substantiële bewapening zou kunnen meenemen in een computergestuurd gevecht.

Tot nu toe moesten militairen die een explosie op een verre locatie wilden veroorzaken, beslissen wanneer en waar ze moesten toeslaan; gebruik een vliegtuig, raket, boot of tank om een bom naar het doel te vervoeren; direct de bom; en druk op de knop “Go”. Maar drones en systemen zoals Sea Mob halen de mens uit het transport en computeralgoritmen leren hoe ze zich moeten richten. Het belangrijkste probleem is of militaire commandanten robots zullen laten doden, met name op momenten waarop communicatieverbindingen zijn verstoord – een waarschijnlijke gebeurtenis in oorlogstijd.

Tot nu toe worden nieuwe wapensystemen zo ontworpen dat mensen nog steeds de ontketening van hun dodelijk geweld moeten goedkeuren, maar slechts kleine aanpassingen zouden nodig zijn om hen in staat te stellen te handelen zonder menselijke input. De regels van het Pentagon, ingevoerd tijdens de Obama-regering, verbieden computers niet de bevoegdheid te geven om dodelijke beslissingen te nemen; ze vereisen alleen een zorgvuldiger beoordeling van de ontwerpen door hoge ambtenaren. En dus zijn ambtenaren in de militaire dienst begonnen met het netelige, existentiële werk van het bespreken van hoe en wanneer en onder welke omstandigheden ze machines zullen laten beslissen om te doden.

De verenigde staten zijn niet het enige land dat deze weg inslaat. Al in de jaren negentig bouwde Israël een door AI doordrenkte drone genaamd de HARPY, die boven een gebied zweeft en onafhankelijk radarsystemen aanvalt; het land heeft het sindsdien verkocht aan China en anderen. In de vroege jaren 2000 ontwikkelde Groot-Brittannië de Brimstone-raket – die voertuigen op het slagveld kan vinden en met andere raketten kan coördineren om te bepalen welke binnen een bepaald gebied om in welke volgorde te slaan – hoewel het nauwelijks toegestaan is om al die autoriteit uit te oefenen.

En de Russische president Vladimir Poetin pochte in 2018 over de inzet van een drone-onderzeeër waarvan hij beweerde dat deze was uitgerust met ‘nucleaire munitie’, wat een zekere mate van robotcontrole over het dodelijkste wapen van de mens suggereert, hoewel hij niet zei hoeveel autonomie de drone zou hebben hebben. Vorig jaar zei Poetin dat vertrouwen op kunstmatige intelligentie ‘enorme kansen biedt, maar ook bedreigingen die moeilijk te voorspellen zijn.’ Hij voegde er niettemin aan toe dat de natie die leidt in de ontwikkeling van AI ‘de heerser van de wereld wordt’.

China heeft niet op dezelfde wijze grandioze claims gedaan, maar president Xi Jinping maakte Amerikaanse functionarissen onrustig door in 2017 te beweren dat zijn land de wereldleider in kunstmatige intelligentie zal zijn tegen 2030. Het land lijkt in de eerste plaats zijn binnenlandse surveillance te verbeteren met gezichtsherkenning en andere identificerende technologieën, hoewel Amerikaanse experts zeggen dat technologie snel voor militair gebruik kan worden gebruikt.

De angst dat de VS zal worden overtroffen door een rivaal, namelijk China of Rusland, heeft al een ’technische Koude Oorlog’ teweeggebracht , zoals gepensioneerde leger-generaal David Petraeus het noemde toen hem in een CNBC-interview werd gevraagd over de uitdagingen waarmee minister van Defensie nu wordt geconfronteerd Esper. Tot dit jaar heeft het Pentagon nooit gezegd hoeveel het werk van kunstmatige intelligentie kostte, hoewel de Congressional Research Service schatte dat het ministerie van Defensie meer dan $ 600 miljoen besteedde aan niet-geclassificeerd werk van kunstmatige intelligentie in FY2016 en meer dan $ 800 miljoen in FY2017.

In maart zei het Pentagon dat het wil dat het Congres meer – $ 927 miljoen – voor het komende jaar opzij zet om zijn kunstmatige-intelligentieprogramma’s te bevorderen. Hiervan zou $ 209 miljoen gaan naar het nieuwe AI-kantoor van het Pentagon, het Joint Artificial Intelligence Center (JAIC), opgericht in juni 2018 om toezicht te houden op al het AI-werk dat meer dan $ 15 miljoen kost. Het meeste werk van de JAIC is geclassificeerd en ambtenaren hebben openlijk alleen gesproken over AI-projecten van het ministerie van Defensie die zich richten op rampenbestrijding.

Maar het adviesbureau Govini schatte in zijn Federal Scorecard van 2019 dat ongeveer een kwart van de AI-uitgaven van het Pentagon de afgelopen vijf jaar aan fundamenteel onderzoek is besteed, de rest is verdeeld in het ontwikkelen van software die gegevens kan sorteren die het Pentagon al bezit, en het creëren van betere sensoren om gegevens door te geven aan computeralgoritmen – belangrijke mijlpalen op weg naar machinegestuurde gevechten.

Het Pentagon heeft weinig gezegd over deze inspanningen, maar openbare documenten en interviews met hoge ambtenaren en vertrouwelijke bronnen maken duidelijk dat het leger de basis legt voor AI om meer en meer van militaire operaties over te nemen – zelfs als de technologie nog niet helemaal klaar is om het volledige commando te nemen.

Het autonome scheepswerk van marine werd gedeeltelijk geïnspireerd door een uitdaging op Mars.

De planetaire wetenschappers die hielpen de Spirit and Opportunity-rovers in 2003 naar Mars te sturen, wisten dat nadat het vaartuig aan het einde van hun reis van 286 miljoen mijl was geland, dringende hogesnelheidscommunicatie onmogelijk zou zijn: een eenvoudige instructie die van de aarde werd gestuurd om te houden een van hen die over een rots tuimelt, zou 10 minuten na de valpartij aankomen. Dus moesten de wetenschappers sensoren en computers ontwikkelen waarmee de rovers op hun eigen manier door gevaarlijke elementen in Mars’s terrein konden navigeren. De inspanning was een enorm succes: oorspronkelijk ontworpen om slechts 90 dagen te duren en elk een halve mijl rond te dwalen, liepen de rovers mijlen van het oppervlak van de planeet af, over een periode van zes jaar in het geval van Spirit (waarvan er slechts één vast zat) in het zand) en 14 in Discovery’s.

De prestatie trok de aandacht van wetenschappers in de kantoren van het Naval Surface Warfare Center in Bethesda, Maryland, die een team vroegen dat hielp bij het ontwerpen van de sensoren van de rovers om de marine te helpen betere autonome schepen te creëren. Maar terwijl de Mars over rotsachtig, heuvelachtig, onbeweeglijk terrein reed, zouden autonome marineschepen in bewegend water varen, waar ze golven, andere boten, het leven in zee en wild variërende weersomstandigheden zouden moeten overleven. Dat vereiste het beheersen en verbeteren van de identificatiemogelijkheden van de sensoren.Veel van het werk werd gedaan door Michael Wolf , die onmiddellijk na zijn promotie aan het California Institute of Technology bij het Jet Propulsion Laboratory (JPL) van NASA kwam. De marine weigerde hem of andere JPL-functionarissen beschikbaar te stellen voor een interview. Maar hij en zijn collega’s publiceerden vroege onderzoeksrapporten waarin ze hun oplossing Savant: Surface Autonomous Visual Analysis and Tracking noemden.

Tegen de tijd dat de marine het voor het eerst testte, in 2009, volgens een van de papieren en officiële foto’s, zag Savant eruit als de top van een vuurtoren , met zes camera’s in een cirkel gewaaid in een weerbestendige behuizing rond de mast van een schip. Hun beelden werden ingevoerd in een computersysteem dat vergelijking mogelijk maakte met een gegevensbibliotheek van zeescènes, waaronder een groeiend aantal schepen.

Het JPL-systeem is ontworpen om slimmer te worden naarmate het werkte, met behulp van de voortdurende zelfstudie die de kern vormt van elke belangrijke AI-ontwikkeling van het afgelopen half jaar. De eerste test van het marinesysteem gebruikte slechts één schip. Tegen 2014 had Wolf echter niet alleen een betere beeldherkenning geïntegreerd, maar ook geholpen bij het schrijven van algoritmen waarmee meerdere boten konden samenwerken tegen potentiële vijanden, volgens de marine .

Cruciaal is dat alle schepen de gegevens delen die hun sensoren verzamelen, waardoor een gemeenschappelijk beeld ontstaat en elk schip kan beslissen wat het moet doen. Samen functioneren ze als een slimme gevechtsgroep of een groep mariniers. Elk schip doet wat het denkt dat het beste voor zichzelf is, maar maakt ook deel uit van een georkestreerd ballet gericht op het uitzwermen en verslaan van een scala aan potentiële doelen.

Vandaar de naam van de marine voor het programma: Swarmboats. Aanvankelijk was de ambitie uitsluitend defensief – om een manier te vinden om een aanval zoals die op de USS Cole in 2000 te voorkomen, waarbij twee zelfmoordterroristen een kleine boot vol explosieven in de zijkant van het militaire schip ramden terwijl het aan het tanken was de Jemenitische haven van Aden. Zeventien zeelieden werden gedood, 39 anderen raakten gewond en de torpedojager werd buiten dienst gesteld voor meer dan een jaar aan reparaties .

In een test in 2014 op de James River in de buurt van Newport News, Virginia, bewees het programma zichzelf toen vijf boten anderen onder druk zetten die ze vijandig vonden. Die test vond plaats op het moment dat een groep AI-enthousiastelingen van het Pentagon een grote druk begon uit te oefenen op een bredere toepassing van de technologie. Het JPL-systeem kreeg de aandacht van een klein, geheim kantoor in het bureau – het Strategic Capabilities Office (SCO). De SCO vervulde zijn mandaat om de goedkeuring van het leger door geavanceerde technologieën te versnellen, versnelde het werk en wees het op mogelijke aanstootgevende toepassingen.

Mede hierdoor is het JPL-systeem voor autonome controle niet alleen toegepast op het Sea Mob-programma van het Marine Corps, maar wordt het nu ontwikkeld voor vliegende drones door het Office of Naval Research en voor gebruik in landvoertuigen door het Amerikaanse leger Centrum voor onderzoek, ontwikkeling en engineering van tankvoertuigen, volgens twee deskundige bronnen.

SCO werd na de oprichting in 2012 uitgevoerd door Will Roper, een wiskundige en natuurkundige die eerder de hoofdarchitect was van een twaalftal wapensystemen bij het Missile Defense Agency. Toen ik hem in 2017 over dit werk sprak, lichtte zijn jeugdige gezicht op en kregen zijn woorden vaart. “Het zal verbazingwekkende dingen doen,” zei hij. “Voor mij is machine learning, een variant van AI, het belangrijkste impactor van de nationale veiligheid in het volgende decennium.”

Roper, die nu leiding geeft aan de algehele wapeninkoop van de luchtmacht, vertelde verslaggevers dit jaar dat hoewel de luchtmacht lang heeft geprobeerd haar piloten te beschermen tegen veroudering door onbemande slimme vliegtuigen, “ik krijg jonge piloten die bij de luchtmacht komen die super enthousiast over dit idee, die het niet zien als concurreren met de menselijke piloot. ”

Tot nu toe, vertelde Roper aan verslaggevers, heeft hij niet de AI-programma’s die hij ‘in handen van de oorlogsjager’ wil leggen. Maar dit zal snel veranderen en de technologie zal ‘zo snel gaan dat ons beleid het moeilijk zal hebben. het inhalen. ‘

AI is, zei hij, “de technologie die me de afgelopen vijf jaar de meeste hoop en angst heeft gegeven om dit werk te doen.” De angst, zoals Roper verklaarde, is dat andere landen manieren zullen vinden om te profiteren van AI vóór de VS doet. Het land dat kunstmatige intelligentie als eerste in zijn arsenaal integreert, zou, volgens Roper, ‘voor altijd een voordeel kunnen hebben’.

Fei-fei li gaf iets meer dan een decennium geleden les aan de Universiteit van Illinois op Urbana-Champaign toen ze begon na te denken over het verbeteren van algoritmen voor beeldherkenning. De uitdaging was in sommige opzichten verrassend eenvoudig: computers moesten slimmer worden en dat moesten ze oefenen. Maar ze konden niet goed oefenen als ze geen toegang hadden tot een grote hoeveelheid beelden waarvan ze konden leren.

Ook wij hebben jou steun nodig in 2025, gun ons een extra bakkie koffie groot of klein.

Dank je en proost?

Wij van Indignatie AI zijn je eeuwig dankbaar

Dus in 2007 begon Li te werken aan wat ImageNet zou worden , een bibliotheek van 3,2 miljoen afbeeldingen getagd door mensen om AI-algoritmen te trainen. ImageNet heeft gediend als een soort Rosetta Stone voor het onderzoek dat nu wordt uitgevoerd naar de ontwikkeling van futuristische wapens. In 2009 hebben Li en haar team van vier andere onderzoekers van Princeton de dataset openbaar gemaakt, en het jaar daarop begonnen teams van over de hele wereld te racen om het beste algoritme te maken dat voor al die afbeeldingen kon worden gebruikt.

Elk jaar werden de algoritmen een beetje beter. Al snel begonnen sommige teams neurale netwerken te integreren , een computermodel dat bedoeld was om de structuur van het menselijk brein na te bootsen met lagen van gegevensverwerkende clusters die neuronen imiteren. Tegen 2015 rapporteerden twee van hen – een team van Microsoft en een van Google – opvallende resultaten: ze hadden algoritmen gecreëerd, zeiden ze, die beter zouden kunnen doen dan mensen. Terwijl mensen afbeeldingen 5,1 procent van de tijd verkeerd labelden, behaalden de algoritmen van Google en Microsoft foutenpercentages onder de 5 procent.

Li, die toen naar Stanford University was verhuisd, vond deze prestatie een interessante benchmark, maar was op zijn hoede voor koppen die de suprematie van computers verklaarden . Het ImageNet-project toonde aan dat “voor die specifieke taak, met die specifieke gegevensset, zeer krachtige algoritmen met diepgaand leren heel goed deden”, vertelde Li me in een interview. “Maar als een onderzoeker die dit al 20 jaar bestudeert, was het geen moment van ‘Oh mijn God, de machines verslaan mensen.'”

Het menselijk gezichtsvermogen is enorm complex, legde ze uit, en omvat mogelijkheden zoals het lezen van gezichtsbewegingen en andere subtiele signalen. De ImageNet-competitie creëerde geen computeralgoritmen die de wereld met al zijn gradaties zouden zien. Maar het hielp wel om machine learning te bevorderen. “Het lijkt erg op zeggen dat je een petrischaaltje gebruikt om penicilline te bestuderen en uiteindelijk wordt het een algemeen antibioticum voor mensen,” zei ze. “ImageNet was dat petrischaaltje met bacteriën. Het werk heeft gelukkig voor ons geleid tot een grote vooruitgang in diepgaande algoritmen. ”

Een AI-doctoraatsstudent, Matt Zeiler, behaalde bijvoorbeeld de beste ImageNet-tagingsnelheid van 2013 en gebruikte vervolgens het AI-systeem dat hij had ontwikkeld om een bedrijf te starten met de naam Clarafai. Clarafai is nu een van de technologiebedrijven die samenwerken met het Pentagon op Project Maven, dat AI gebruikt om door satelliet- en drone-opnamen te graven en objecten te identificeren en te volgen waarop wapens kunnen worden gericht.

Onderzoekers van beeldherkenning hebben niet alle problemen opgelost. Een groep van negen wetenschappers van vier Amerikaanse universiteiten werkten samen aan een 2018-test om te kijken of het plakken van kleine zwart-witte stickers op stopborden geavanceerde beeldherkenningssystemen zou kunnen bedriegen. Vijfentachtig procent van de tijd bepaalden de algoritmen dat de enigszins gewijzigde stoptekens helemaal geen stoptekens waren. Onderzoekers noemen dit soort onvermogen om zich aan te passen aan de omstandigheden ‘broosheid’ in AI, en het is een van de belangrijkste problemen waarmee het veld wordt geconfronteerd. Overweeg bijvoorbeeld wat een onvermogen om stopborden te herkennen betekent voor auto’s zonder bestuurder.

Maar het nieuws van de opvallende prestaties van Google en Microsoft met ImageNet in 2015 hielp Pentagon-functionarissen ervan te overtuigen dat “machines beter in objectdetectie kunnen zijn” dan mensen, herinnerde Robert Work, die toen de plaatsvervangend secretaris van defensie was – een cruciale vaardigheid die kon definiëren wat automatisch wordt gedood en wat automatisch wordt gespaard.

“Wat het ministerie van Defensie betreft, was dat een belangrijke dag,” zei hij.

Thij phalanx is een zes-loop naval gun dat 75 kogels een tweede vanaf het dek van de middelgrote en grote marineschepen schiet, en het wordt nog zenuwachtig voor de ontploffing. Het maakt tal van kleine correcties als het binnenkomende bedreigingen twee mijl uit het spoor begint te volgen, inclusief raketten en vliegtuigen. Het houdt ook zijn eigen kogels bij om te controleren of deze op het doelwit staan. Het doet dit allemaal zonder menselijke tussenkomst.

Een van zijn radars, opgenomen in een grote koepel waardoor het totale systeem eruitziet als een graansilo met een pistool dat uit zijn zijkant steekt, zoekt voortdurend naar nieuwe doelen; wanneer de beweging van een doel overeenkomt met een patroon in een bibliotheek met potentiële bedreigingen, opent het pistool het vuur. De tweede radar, lager in de koepel van de Phalanx, houdt bij waar alle kogels naartoe gaan, zodat het systeem bij het lossen aanpassingen kan doen.

De Phalanx is geen noviteit. Het is ongeveer 30 jaar op de schepen van de marine geweest en verkocht aan twee dozijn Amerikaanse bondgenoten. Die lange geschiedenis is een van de redenen dat marineofficieren zoals schout-bij-nacht David Hahn op hun gemak zijn om machines dodelijke beslissingen te laten nemen in een conflict. Hahn heeft zelf een lange geschiedenis met machine-intelligentie: na zijn afstuderen aan de Naval Academy, werd Hahn toegewezen aan de USS Casimir Pulaski, een 425-voet schip dat afhankelijk was van computers om zijn nucleaire reactor te helpen besturen. “Wat jouw rol is, als mens, is toezicht houden op die [systemen] en dan, wanneer je moet handelen, ingrijpen,” vertelde Hahn mij. Maar “vaak ben je niet snel genoeg, dus je bent afhankelijk van de machine die moet optreden om de kettingreactie te stoppen en de plant veilig te houden, zodat de mensen deze kunnen herstellen.”

Hahn runt nu het Office of Naval Research (ONR), dat een budget heeft van $ 1,7 miljard en houdt toezicht op de inspanningen van de marine om kunstmatige intelligentie in meer van zijn systemen te introduceren. “We hebben al deze gesprekken vandaag over hoe dit nieuw is, of dit is anders,” zei Hahn. “Nee, het is gewoon een andere vorm. Het kan sneller zijn, het kan een uitgebreidere dataset zijn, het kan groter zijn, maar de fundamenten zijn hetzelfde. ”

Zijn kantoor was een van de oorspronkelijke financiers van het Sea Mob-programma, maar hij noch het Marine Corps wilden erover praten of de test van oktober 2018 bespreken. Een bron die bekend is met het programma zei dat het voortschrijdt van het identificeren van schepen naar het kunnen nemen van beslissingen over of ze vriendelijk of bedreigend zijn, op basis van hun gedrag in het water. Dat vereist het volgen van hun bewegingen en deze vergelijken met nieuwe, complexere dreigingsgegevens, die nog steeds worden verzameld. De software om de bewegingen van een naderend schip te volgen en te vergelijken met potentiële bedreigingen is al aanwezig.

Andere marine-autonomieprogramma’s worden gebouwd rond veel grotere schepen, zoals de 132-voet, Sea Hunter, die voor het eerst werd gelanceerd in 2016. Hoe de Marine de Sea Hunter zou kunnen bewapenen is nog niet duidelijk, maar anti-onderzeeër oorlogvoering van de het oceaanoppervlak vereist meestal sonar – ofwel op het schip gemonteerd of meegesleept onder het oppervlak – plus torpedo’s.

Een reden waarom autonomie zo belangrijk is, is dat commandanten zich zorgen maken dat radio-storing en cyberaanvallen ervoor kunnen zorgen dat schepen in de toekomst contact verliezen. Als dat gebeurt, moeten de wapensystemen van een robotschip zelfstandig kunnen handelen, anders zijn ze nutteloos.

Robert Brizzolara, die het Sea Hunter-programma beheert, zegt dat veel van het werk om het systeem gereed te maken voor gebruik op het slagveld is voltooid en dat het volgend jaar zal worden overgedragen aan Naval Sea Systems Command zodat ingenieurs kunnen uitzoeken hoe het schip zou kunnen bewapend en gebruikt worden in gevechten. Het testen zal echter doorgaan, in een poging om commandanten te overtuigen dat het een betrouwbare partner in conflict kan zijn.

“Zeilers en hun commandanten zullen erop moeten vertrouwen dat de autonome systemen op het juiste moment het juiste zullen doen,” vertelde Brizzolara me. Om dat vertrouwen te creëren, is Brizzolara van plan om naar de commandanten te gaan met “een verzameling bewijsmateriaal dat we kunnen presenteren dat hen zal overtuigen” of nieuwe tests zal leiden.

De marine kijkt niet alleen naar onafhankelijke systemen die op zee kunnen werken; het experimenteert ook met kleine onbemande, autonome onderzeeërs die kunnen zoeken naar niet-ontplofte zeemijnen en bommen inzetten die bedoeld zijn om ze te laten ontploffen, waardoor grotere en duurdere schepen worden opgeslagen die mensen voor andere taken vervoeren. Het is een vruchtbare arena voor autonomie, omdat de kansen op ongelukken onder water klein zijn.

Hahn beschreef deze tegenmijnboten, de meest gebruikte versie is de MK18, als een toegangspoort tot een breder maritiem gebruik van onbemande onderwatersystemen. “Krijgt u daarmee anti-onderzeeër oorlogvoering? Nee, maar het brengt je in dat domein een weg verder, ‘zei hij. “En dan kun je begrijpen hoe de uitdagingen eruit zien als je dat probeert toe te passen [op een autonoom vaartuig] in plaats van op een object dat door het water beweegt en dat door mensen wordt geleid.”

In februari ontving Boeing een contract van $ 43 miljoen om tegen 2022 vier autonome onderzeeërs te bouwen. Ze zijn elk 51 voet lang en kunnen 7.500 mijl onder water reizen. Zodra ze zijn gebouwd, is de marine van plan om te experimenteren met hoe de schepen kunnen worden gebruikt om zowel onderzeeërs als oppervlakteschepen aan te vallen, volgens marinedocumenten. Gevraagd naar het programma, Boeing richtte alle vragen aan Naval Sea Systems Command, en een woordvoerder van het commando weigerde details te geven, en zei alleen dat de boten “een rigoureuze integratie en testplan zouden ondergaan.”

Tsurge hij pentagon belangstelling voor autonome wapens is deels te wijten aan sprongen in de informatica en techniek, maar het is ook een groot deel het werk van Robert Work, die 27 jaar doorgebracht in de mariniers voordat hij adjunct-secretaris van defensie. Werk heeft veel van zijn tijd doorgebracht, zowel in uniform als buiten, waar hij militaire geschiedenis en strategie bestudeerde. Zelfs nu, twee keer in civiele functies in het Pentagon, heeft hij nog steeds de uitstraling van een officier, met vliegeniers met heldere lenzen en een enthousiasme voor het bespreken van historische veldslagen die belangrijke technologieën of tactieken demonstreren.

Terwijl Work in 2013 in het Center for a New American Security was, een denktank in Washington, waren hij en zijn collega’s verrast door de uitkomst van enkele geclassificeerde Pentagon-simulaties van theoretische conflicten met China of Rusland. Na de Koude Oorlog eindigde dit soort oefeningen meestal met ofwel de VS die een beslissende overwinning claimden, ofwel een nucleaire Armageddon. Maar de nieuwe simulaties maakten duidelijk dat de technologische voorsprong van de VS begon te verdampen, zeggen hij en anderen. Nieuwe ontwrichtende technologieën hadden het speelveld geëgaliseerd, waardoor “blauw [te krijgen] … de reet aan hem werd overhandigd” soms, in de kleurrijke volkstaal van een analist van de RAND Corporation in Washington in maart. De VS zijn afhankelijk van grote vliegdekschepen om militaire macht te leveren aan conflictgebieden, vooral in de Stille Oceaan, maar die luchtvaartmaatschappijen.

Werk concludeerde dat de VS hun spel moesten opvoeren, zoals het deed tijdens twee andere momenten in de afgelopen halve eeuw toen de dominantie van het slagveld in twijfel kwam. Eén was vroeg in de Koude Oorlog, toen het Pentagon besefte dat het Europa niet adequaat kon verdedigen tegen een Sovjet-grondinvasie en reageerde met kleine nucleaire wapens die bedoeld waren om een opmars van Sovjet-troepen tegen te houden. De tweede was in de jaren zeventig, toen het begon te begrijpen dat geleide bommen en raketten nodig waren om militaire commandanten opties te bieden, behalve het bombarderen van hele gebieden op het slagveld.

Begin 2014 begon Work rapporten te publiceren waarin de behoefte aan geavanceerde, flexibele, snelle en goedkope wapens werd geschetst die Amerikaanse troepen vlugger en minder afhankelijk van vliegdekschepen en andere kwetsbare hardware zouden kunnen maken . Vervolgens, in februari van dat jaar, benoemde president Barack Obama hem tot de volgende plaatsvervangend secretaris van defensie. Enkele maanden later lanceerde Work formeel zijn technologie-initiatief.

“In laboratoria en fabrieken over de hele wereld … worden enorme hoeveelheden tijd, geld en mankracht besteed aan de ontwikkeling van de volgende golf van ontwrichtende militaire technologieën,” zei Work op 5 augustus 2014, sprekend aan de Nationale Defensie Universiteit . “Om onze technologische superioriteit te behouden bij de overgang van het ene oorlogsbestrijdingsregime naar het andere, moeten we ons nu beginnen voorbereiden.”

In zijn toespraak werd in zijn toespraak geen kunstmatige intelligentie genoemd en zijn aanvankelijke beschrijving van technologieën was breed, gericht op het idee van behendigheid en flexibiliteit in plaats van een specifiek type militair wapen . Maar nadat Work en anderen het soort technologieën hadden geïdentificeerd waarvan zij dachten dat het de machtsverhoudingen in het voordeel van de VS zou kunnen kantelen, namelijk cyberoorlogvoering, kunstmatige intelligentie en hypersonics, begonnen ze geld en mankracht te verschuiven om die technologieën klaar te maken voor gevechten.

Andere landen zagen de VS aandringen op nieuwe technologieën en besloten dat ze zelf innovatieve militaire opties moesten bedenken. In 2016 onthulde China de Junweikejiwei, zijn nieuwe militaire onderzoeks- en ontwikkelingsagentschap gemodelleerd naar het Amerikaanse Defense Advanced Research Projects Agency (DARPA). Evenzo heeft Rusland het Skolkovo Instituut voor Wetenschap en Technologie buiten Moskou, dat defensie-inlichtingenbronnen beschrijven als een andere DARPA-kloon. Skolkovo werd oorspronkelijk opgericht in samenwerking met het Massachusetts Institute of Technology, maar de universiteit stopte begin 2019 met de regeling nadat de Russische miljardair die het project financierde, Viktor Vekselberg, door de VS werd gesanctioneerd wegens vermoedelijke connecties met Russische bemoeienis in 2016 verkiezing.

Werk heeft consequent getracht de verwachtingen over de resultaten van zijn technologische inspanningen te kalibreren, door duidelijk te maken dat machines Amerika zijn militaire voorsprong zouden kunnen teruggeven, maar dat oorlogen zich niet precies zouden ontvouwen volgens de beste plannen van de mens.

“Er zullen tijden zijn dat de machines de fout maken,” vertelde Work me een recent interview. “We zijn niet op zoek naar de alwetende machine die nooit verkeerd is. We zijn op zoek naar machines die getest zijn tot het punt waarop we erop kunnen vertrouwen dat de AI zal doen waarvoor hij is ontworpen en hopelijk kunnen uitleggen waarom hij de beslissing heeft genomen. ”

Toch beweert Work dat AI de mogelijkheid heeft om levens te redden vanwege de precisie die computers kunnen benutten. “AI zal wapens discriminerend en beter maken, minder kans om de oorlogswetten te overtreden, minder kans om burgers te doden, minder kans om bijkomende schade te veroorzaken,” zei hij.

Werk, zoals alle huidige en voormalige ambtenaren die de toekomst van AI in wapens met mij bespraken, zei dat hij niemand kent in het leger die nu mensen volledig probeert te verwijderen uit de dodelijke besluitvorming. Een dergelijk aanstootgevend systeem is niet door het gespecialiseerde beoordelingsproces gebracht dat is gecreëerd door een Pentagon-richtlijn uit het Obama-tijdperk, hoewel de procedures veel interne aandacht hebben gekregen, volgens de huidige en voormalige functionarissen van het ministerie van Defensie.

Werk zegt ook dat het concept van machines die volledig hun eigen doelen kiezen of vreselijk mis gaan, zoals iets uit de Terminator- films, onwaarschijnlijk is omdat de offensieve technologieën die worden ontwikkeld slechts beperkte toepassingen hebben. Ze “zullen alleen de dingen aanvallen die we zeiden” ze konden, zei Work.

De ideeën van Work kregen een sympathieke hoorzitting van luchtmacht-generaal Paul Selva, die in juli met pensioen ging als vice-voorzitter van de Joint Chiefs of Staff en een belangrijke steun was voor AI-gerelateerde innovaties. Maar Selva sprak botweg over het ‘ Terminator- raadsel’, de vraag hoe te worstelen met de komst van machines die in staat zijn om zelf te doden.

Toen hij in 2016 in een denktank in Washington sprak, maakte hij duidelijk dat het probleem niet hypothetisch was: “In de wereld van autonomie kijken we naar wat onze concurrenten in dezelfde ruimte zouden kunnen doen, het idee van een volledig robotsysteem dat een beslissing nemen over het al dan niet schaden van een tegenstander is hier, ‘zei hij. “Het is niet vreselijk verfijnd, het is niet vreselijk goed, maar het is hier.”

Hij legde in juni verder uit bij de Brookings Institution dat aan machines kan worden verteld dat ze de aanwezigheid van doelen moeten voelen volgens de specifieke instructies van een programmeur. In een dergelijk geval, zei Selva, herkennen de machines de unieke identificerende kenmerken van een of meer doelen – hun “handtekening” – en kunnen ze worden verteld om te ontploffen wanneer ze een doel duidelijk identificeren. “Het is code die we schrijven … De handtekeningen zijn bekend, dus de gevolgen zijn bekend.”

Met kunstmatige intelligentie, zei Selva bij Brookings, kunnen machines minder direct worden geïnstrueerd om ‘de handtekening te gaan leren’. Dan kunnen ze worden verteld: ‘Zodra je de handtekening hebt geleerd, identificeer je het doelwit.’ In die gevallen zijn machines niet ‘ Bij het uitvoeren van alleen instructies van anderen, handelen ze naar aanwijzingen die ze zelf hebben gecreëerd, nadat ze uit ervaring hebben geleerd – van henzelf of van anderen ‘.

Selva heeft gezegd dat het leger tot nu toe heeft terughoudend om beslissingen over het doden rechtstreeks over te dragen aan intelligente machines. Maar hij heeft een breed “nationaal debat” aanbevolen, waarin de implicaties van het laten kiezen van machines door wie en wanneer te doden kunnen worden gemeten.

Systemen zoals Sea Mob zijn er nog niet, maar ze leggen de basis voor beslissingen over leven en dood door machines. In de donkere weergave van de Terminator- films besluit een kunstmatig intelligent militair systeem met de naam SkyNet de mensheid uit te roeien. Een van de aannemers die werken aan Sea Mob heeft zijn presentaties over het programma afgesloten met een verwijzing naar de films: “We zijn SkyNet aan het bouwen”, leest de laatste PowerPoint-dia, half voor de grap. Maar “het is onze taak om ervoor te zorgen dat de robots ons niet doden.”