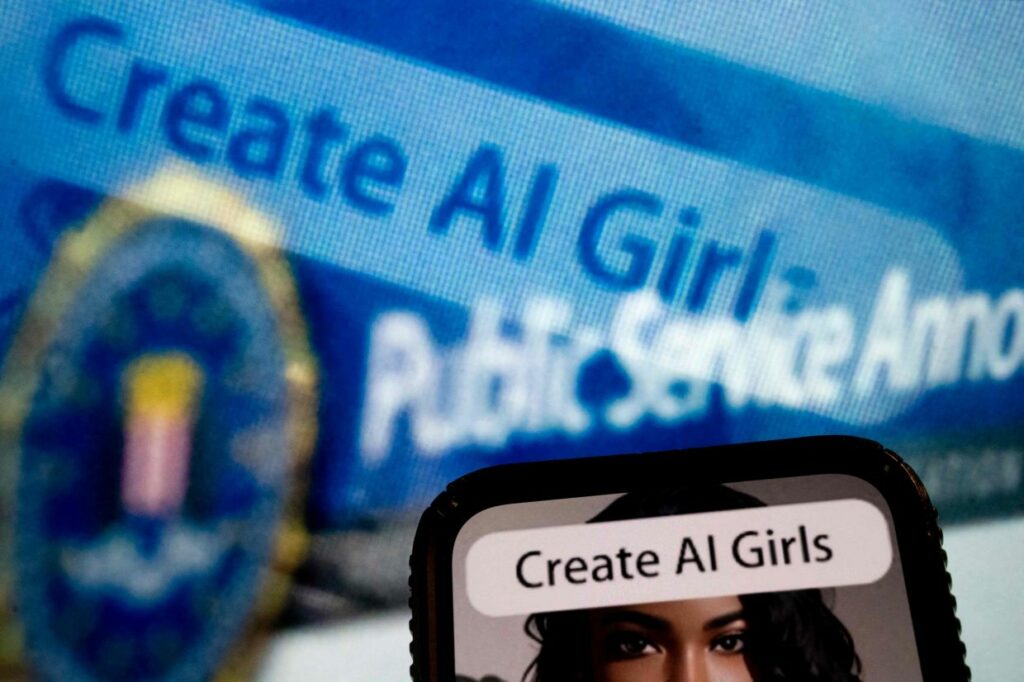

This photo illustration created on July 18, 2023, in Washington, DC, shows an advertisement to create AI girls reflected in a public service announcement issued by the FBI regarding malicious actors manipulating photos and videos to create explicit content and sextortion schemes. Photo apps digitally undressing women, sexualized text-to-image prompts creating "AI girls" and manipulated images fuelling "sextortion" rackets -- a boom in deepfake porn is outpacing US and European efforts to regulate the technology. (Photo by Stefani REYNOLDS / AFP)

Na zware onderhandelingen zijn het EU-Parlement en de Raad gisteravond overeenstemming bereikt over de definitieve versie van de AI-wet. Het compromis lijkt enkele mazen in de wet te bevatten: de lidstaten hebben blijkbaar de overhand gehad op het EU-Parlement, vooral als het gaat om biometrische videobewaking en voorspellend politiewerk.

De eerste democratische en alomvattende AI-regelgeving ter wereld is van kracht. Na twee marathonbijeenkomsten sinds afgelopen woensdag konden het EU-Parlement en de Raad het eens worden over de definitieve versie van de geplande AI-regelgeving. Dit betekent dat de wet waarschijnlijk vóór de Europese verkiezingen in juni volgend jaar zal worden aangenomen.

Er is grote opluchting over het akkoord. Thierry Breton, EU-commissaris voor de Interne Markt, omschreef de overeenkomst als “historisch”. Commissievoorzitter Ursula von der Leyen zei dat het raamwerk “de veiligheid en fundamentele rechten van mensen en bedrijven” zou beschermen. En Benifei Brando, de socialistische onderhandelaar van het Parlement, zei dat het dankzij de volharding van het Parlement was dat rechten en vrijheden de kern vormden van de ontwikkeling van deze baanbrekende technologie.

De exacte tekst zal de komende dagen worden geformaliseerd en gepubliceerd. Zolang het niet beschikbaar is, ‘weten we niet wat er is opgeofferd’, schrijft Daniel Leufer , senior beleidsanalist bij Access Now, over ‘We hebben het kunnen redden, en onze bondgenoten in het Parlement hebben dat ook gedaan’. zei Leufer, “maar de tekst die uit dit proces voortkomt is geen gouden standaard, het is geen keerpunt.”

In feite is het nu al duidelijk dat de uitkomst van de onderhandelingen rode lijnen zal bevatten wanneer zogenaamde kunstmatige intelligentie (AI)-systemen worden gebruikt. Deze zullen echter waarschijnlijk talrijke hiaten vertonen. Dit heeft minder gevolgen voor de basismodellen die in de aanloop naar de onderhandelingen breed zijn besproken , maar belangrijker nog voor de biometrische videobewaking en de nationale veiligheidsautoriteiten. Vooral hier waren de lidstaten blijkbaar in staat een aantal van hun eisen aan het EU-Parlement af te dwingen.

Talrijke uitzonderingen voor biometrische videobewaking

Vanaf nu zullen systemen die biometrische categorisaties uitvoeren op basis van gevoelige eigenschappen verboden worden. Dit kunnen politieke of religieuze overtuigingen of seksuele geaardheid zijn. Deze beperkingen zijn bedoeld om discriminatie te voorkomen. De EU wil ook verbieden dat afbeeldingen van gezichten worden verzameld via internet of uit videobewakingssystemen in databases. Emotieherkenning op de werkvloer en in het onderwijs zou ook verboden moeten worden, evenals de zogenaamde sociale scoring. Dergelijke systemen verzamelen, evalueren en sanctioneren het sociale gedrag van mensen.

Tegelijkertijd voorziet het bereikte akkoord uiteraard in een aantal uitzonderingen voor rechtshandhavingsautoriteiten. Biometrische identificatiesystemen moeten voor bepaalde misdrijven mogelijk zijn in publiek toegankelijke ruimtes en met voorafgaande rechterlijke goedkeuring. Ook zogenaamde retrograde identificatie – dat wil zeggen achteraf – zou onder voorwaarden toegestaan zijn, bijvoorbeeld bij een terreurdreiging of bij het gericht fouilleren van personen bij vermoeden van ernstige misdrijven.

Dit betekent dat de AI-regelgeving, ondanks alle beperkingen, de weg zou kunnen vrijmaken voor een nieuwe vorm van massasurveillance en dataretentie . Zelfs voor beperkte retrograde identificatie zouden autoriteiten nu op grote schaal video-opnamen moeten maken – dat wil zeggen openbare ruimtes moeten monitoren – en deze gedurende een langere periode moeten opslaan. En om deze opnames te matchen, bijvoorbeeld met het gezicht van een gezochte verdachte, zouden ze ook biometrische gegevens moeten verzamelen en deze beschikbaar moeten stellen aan wetshandhavingsautoriteiten.

Predictive policing is ook met beperkingen toegestaan

De onderhandelingspartners zijn het ook eens geworden over regels voor AI-systemen die als hoog risico worden geclassificeerd. Volgens het EU-Parlement zouden er in de toekomst “duidelijke eisen moeten komen aan een verplichte effectbeoordeling voor de grondrechten”. Ook AI-systemen die het stemgedrag van burgers en daarmee de uitslag van verkiezingen kunnen beïnvloeden, zouden als hoog risico worden aangemerkt.

Ook het zogenaamde voorspellende politiewerk – dat wil zeggen de poging om voorspellingen af te leiden uit bestaande politiegegevens – moet voortaan worden toegestaan, zij het met beperkingen. Zoals Brando Benifei op de nachtelijke persconferentie aankondigde, zouden “onafhankelijke autoriteiten” in de toekomst toestemming moeten verlenen voor het gebruik van overeenkomstige systemen. Dit is bedoeld om misbruik door de politie te voorkomen.

Onder meer Amnesty International heeft de afgelopen jaren aangetoond hoe voorspellend politiewerk in Groot-Brittannië en Nederland leidt tot massaal toezicht, verkeerde beslissingen en discriminatie.

Ook wij hebben jou steun nodig in 2025, gun ons een extra bakkie koffie groot of klein.

Dank je en proost?

Wij van Indignatie AI zijn je eeuwig dankbaar

Welke uitzonderingen voor “nationale veiligheid”?

Het is momenteel onduidelijk welke specifieke regels bedoeld zijn voor de “nationale veiligheid” bij het gebruik van AI. Vooral de Franse regering had eerder opgeroepen tot uitgebreide uitzonderingen. Als ze zouden komen, zou de Hongaarse regering ook gevaarlijke AI-systemen kunnen gebruiken met betrekking tot “nationale veiligheid”. Dit omvat ook biometrische massasurveillance en sociale scores. Volgens het EU-Parlement zou dit op grond van het bereikte akkoord verboden moeten worden. Het valt echter nog te bezien of de definitieve tekst nog steeds enkele mazen in de wet openlaat.

Ook de staatsspionagesoftware Pegasus , aangeboden door de Israëlische NSO Group , laat zien dat een dergelijke uitzondering de deur zou openen voor misbruik . Volgens de fabrikant is deze technologie uitsluitend ontwikkeld voor nationale veiligheidsdoeleinden. Maar het is al lang bekend dat ook oppositieleden, journalisten en dissidenten het doelwit waren.

Voor basismodellen gelden eisen

De regeringen van Frankrijk, Duitsland en Italië moesten zich op één punt terugtrekken. Zij hadden in de aanloop naar de onderhandelingen opgeroepen tot minder regels voor zogenaamde basismodellen. De stap veroorzaakte grote tegenstand . Basismodellen zijn AI-systemen die voor verschillende doeleinden kunnen worden gebruikt.

De onderhandelaars zijn er blijkbaar in geslaagd om tijdens de eerste bijeenkomst afgelopen woensdag tot overeenstemming te komen . Het bepaalt onder meer dat bedrijven technische documentatie moeten opstellen voor de basismodellen die zij aanbieden. Deze moeten in detail uitleggen welke inhoud werd gebruikt om de modellen te trainen. Basismodellen met hoge systeemrisico’s zijn ook onderworpen aan aanvullende vereisten, waaronder strengere test- en rapportagevereisten.

In zijn ontwerp van de AI-verordening riep het Parlement ook op tot effectbeoordelingen op het gebied van de grondrechten. Gebruikers van risicovolle systemen moeten onderzoeken welke risico’s het gebruik van deze systemen met zich meebrengt, wie er gevolgen van kan ondervinden en hoe de risico’s kunnen worden omzeild. De Raad had campagne gevoerd tegen dergelijke effectbeoordelingen, maar het Parlement kon hier de overhand krijgen.

“Geef onze rechten niet weg!”

Het werd al vroeg duidelijk dat de overeenkomst talrijke mazen in de wet zou bevatten. Na de eerste 22 uur durende onderhandelingsronde schreven 54 maatschappelijke groeperingen en 26 onderzoekers een open brief aan de Raad. Daarin verwierpen ze zijn eisen voor verdere uitzonderingen. “Geef onze rechten niet weg!”, drongen zij ook aan op de andere deelnemers aan de trialoog.

De achtergrond was het bericht dat het Spaanse voorzitterschap van de Raad de onderhandelaars van het Parlement in de nacht van woensdag op donderdag onder aanzienlijke druk had gezet, zodat zij uitgebreide eisen van de Raad zouden aanvaarden. Volgens dit voorstel zouden de veiligheidsautoriteiten biometrische systemen mogen gebruiken om mensen te sorteren op beschermde eigenschappen, zoals etniciteit.

Volgens Euractiv steunde de conservatieve parlementaire onderhandelaar Dragoş Tudorache deze eisen blijkbaar soms ook. Na verzet van de sociaaldemocraat Brando Benifei kwam de parlementaire kant vervolgens weer bij elkaar. In de tweede onderhandelingsronde kon ze meer verboden op veiligheidsgebied afdwingen.

Ingetogen reacties

Sarah Chander, Senior Beleidsadviseur bij EDRi, wil de definitieve tekst nu zorgvuldig onderzoeken: “We zullen zien in hoeverre de compromissen in de praktijk echt werken”, aldus Chander over

De Europese consumentenorganisatie BEUC heeft kritiek op het compromis . Emotieherkenningssystemen zijn nog steeds toegestaan, wat zorgelijk is gezien de onbetrouwbaarheid ervan , schrijft de organisatie. AI-systemen waarvan het risico niet als hoog wordt geclassificeerd, zoals speelgoed of virtuele assistenten, zijn slechts onvoldoende gereguleerd. Zelfs voor basismodellen is het uiteindelijke compromis niet doorslaggevend genoeg, bijvoorbeeld omdat het niet voorziet in tests door onafhankelijke organisaties.

“De AI Act had in het algemeen meer moeten doen om consumenten te beschermen”, zegt Ursula Pachl, adjunct-directeur van BEUC. “Het is nu essentieel dat de autoriteiten deze wetgeving correct implementeren om de consument zoveel mogelijk te beschermen.”

Ook de brancheverenigingen CCIA en DigitalEurope zijn ontevreden. Volgens hen dreigt de AI-regulering de innovatie in Europa te beperken.