Vorige week plaatste Donald Trump op Truth Social een door kunstmatige intelligentie gegenereerde afbeelding van Taylor Swift in een Uncle Sam-outfit, waarbij hij ten onrechte beweerde dat zij hem had gesteund. De afbeelding is duidelijk nep en werd vergezeld door andere afbeeldingen, waarvan sommige ook door kunstmatige intelligentie zijn gegenereerd, van jonge vrouwen in T-shirts met de tekst “Swifties for Trump“.

Sterker nog, Swift heeft dit jaar nog geen enkele presidentskandidaat gesteund. In 2020 steunde ze Joe Biden boven Trump.

Een paar dagen later gaf Trump toe dat de beelden niet echt waren.

“Ik weet er niets over, behalve dat iemand anders ze heeft gegenereerd, ik heb ze niet gegenereerd. Iemand kwam naar buiten en zei: ‘Oh, kijk hier eens naar.’ Deze zijn allemaal verzonnen door andere mensen,” vertelde hij aan Fox Business als antwoord op een vraag of hij zich zorgen maakte over een rechtszaak van Swift.

“AI is op die manier altijd erg gevaarlijk”, vervolgde hij, en zei dat hij ook het onderwerp is geweest van vervalsingen die suggereerden dat hij aanbevelingen deed die hij nooit heeft gedaan.

Maar in werkelijkheid heeft Trump zelf herhaaldelijk door AI gegenereerde content gedeeld op sociale media, het laatste voorbeeld van hoe kunstmatige intelligentie opduikt in de verkiezingen van 2024. De Trump-campagne reageerde niet op een verzoek om commentaar.

Normaal gesproken deelt Trump berichten van zijn aanhangers die nieuwe tools hebben omarmd waarmee ze snel tekstuele beschrijvingen kunnen omzetten in afbeeldingen, die zowel geloofwaardig als fantastisch zijn .

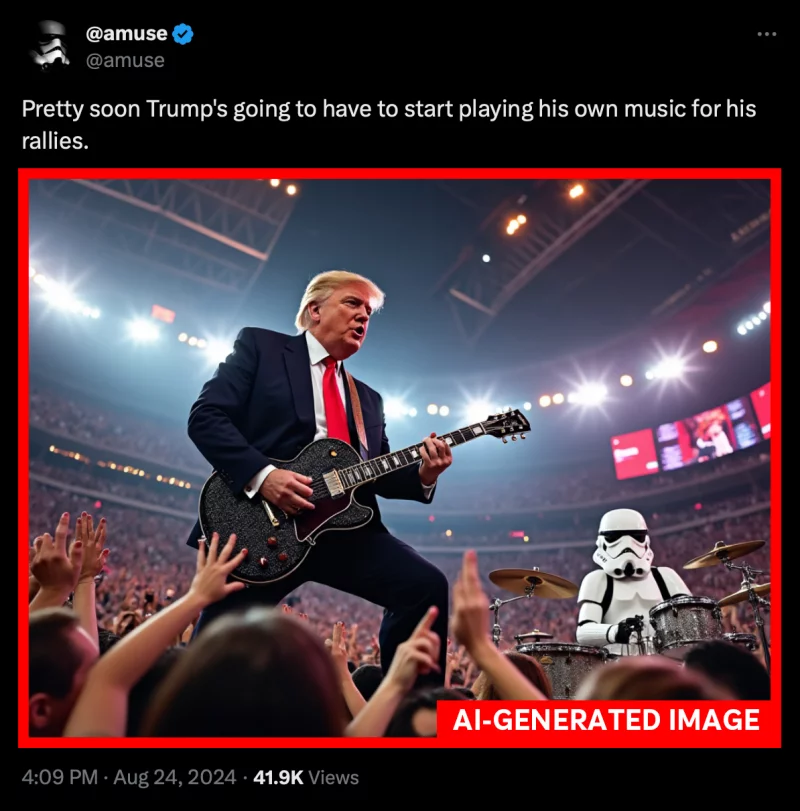

Een door AI gegenereerde afbeelding van Donald Trump die gitaar speelt met een stormtrooper-personage uit Star Wars, die is gemaakt door een supporter en op X is geplaatst. Trumps supporters maken vaak fantastische afbeeldingen van de voormalige president in allerlei settings die op sociale media worden gedeeld. NPR heeft de randen aan de afbeelding toegevoegd om duidelijk te maken dat de afbeelding door AI is gegenereerd.

@amuse/screenshot door NPR/Screenshot door NPR

Het onderwerp van de beelden die ze maken is vaak Trump zelf: op een leeuw , als bodybuilder , optredend op een rockconcert met een Star Wars stormtrooper ( echt waar ).

Andere keren bespotten of belasteren ze zijn tegenstanders, zoals een recente nepfoto die hij deelde van wat vicepresident Harris leek te zijn terwijl hij een toespraak hield op een bijeenkomst in Sovjetstijl , compleet met een communistische hamer-en-sikkelvlag.

“Een ding waar AI in het bijzonder goed in is, is het omzetten van ideeën of beweringen in tekst in metaforische representaties”, aldus Brendan Nyhan, hoogleraar politieke wetenschappen aan Dartmouth College. Hij zegt dat dit een door AI aangestuurde draai is aan het soort memes, satire en commentaar dat een hoofdbestanddeel is van politieke communicatie .

“Het is een maatje voor mensen die veel politiek nieuws online lezen en vaak een eenzijdig informatiedieet volgen”, zei hij.

Een door AI gegenereerde afbeelding die is gepost door het X-account van voormalig president Trump, waarop vicepresident Kamala Harris te zien is die een toespraak houdt voor een politieke conventie in Sovjetstijl. Trumps aanhangers genereren vaak afbeeldingen die Trumps tegenstanders denigreren en bespotten. NPR heeft de rand aan de afbeelding toegevoegd om duidelijk te maken dat deze met AI is gegenereerd.

@realdonaldtrump/screenshot door NPR

Trump-aanhangers omarmen AI voor grappen en satire

Veel van deze AI-afbeeldingen lijken niet bedoeld om letterlijk als waar te worden opgevat. Ze worden vaak gedeeld als grappen of parodieën. Sommige van de nep Swifties voor Trump-foto’s die Trump postte, werden door hun oorspronkelijke maker zelfs als satire bestempeld .

Ze zijn gericht op een publiek van mensen die al fan zijn van Trump. Dat is in lijn met Trumps lange geschiedenis van het opnieuw delen van grove memes, het geven van kleinerende bijnamen en het maken van grappen ten koste van zijn rivalen.

“Deze beelden dienen om mensen eraan te herinneren aan welke kant ze staan, welke politici ze wel en niet mogen, enzovoort”, aldus Nyhan.

Nu AI-tools steeds breder beschikbaar zijn, richt men zich steeds meer op de meest kwaadaardige toepassingen ervan , namelijk het misleiden van kiezers. Denk bijvoorbeeld aan deepfakes van kandidaten of fotorealistische weergaven van gebeurtenissen die nooit hebben plaatsgevonden .

Sommige van die zorgen zijn zowel in de VS als daarbuiten werkelijkheid geworden, zoals de door AI gegenereerde nep-robocall die zich voordeed als president Biden en de Democraten vertelde niet te stemmen in de voorverkiezingen in New Hampshire.

Er is een gebrek aan consensus onder de bedrijven achter AI-generatoren over welke beschermingsmaatregelen er moeten worden getroffen. OpenAI, de maker van DALL-E en ChatGPT, verbiedt gebruikers om afbeeldingen te maken van publieke figuren, waaronder politieke kandidaten en beroemdheden. Maar de onlangs gelanceerde AI-afbeeldingengenerator op X, het socialemediaplatform dat voorheen bekendstond als Twitter, lijkt minder beperkingen te hebben. Toen NPR het medio augustus testte , produceerde de tool afbeeldingen die leken te tonen hoe Trump en Harris vuurwapens vasthielden en stembusjes werden gevuld.

Ook alledaagse toepassingen van AI kunnen bijdragen aan een omgeving waarin mensen steeds minder vertrouwen hebben in wat ze zien, aldus Hany Farid, hoogleraar aan de UC Berkeley en gespecialiseerd in beeldforensisch onderzoek.

Trump zelf heeft van dat wantrouwen geprofiteerd door ten onrechte te beweren dat de campagne van Harris-Walz AI had gebruikt om een menigte te faken bij een recente bijeenkomst. (De menigte en de foto in kwestie waren echt.)

“Als je constant nepbeelden ziet en beelden die er echt aantrekkelijk en heel fotorealistisch uitzien … geloof je het dan minder snel? Begin je nu gewoon aan alles te twijfelen?” zei Farid.

Door AI gegenereerd materiaal kan spanningen doen toenemen

Nyhan zegt dat dit soort AI-content waarschijnlijk niet mensen zal overtuigen die nog niet op één lijn zitten met Trump, maar dat het wel degenen die al de meest extreme standpunten hebben, kan aanwakkeren of zelfs mobiliseren. Daarom maakt hij zich zorgen over representaties van geweld, zelfs als die duidelijk nep zijn.

“Mensen zullen natuurlijk online AI-content tegenkomen. Iedereen zal dat doen. Maar mensen die de meest misleidende of opruiende content tegenkomen, komen waarschijnlijk al van de randgroepen”, zei hij. “Deze mensen zijn al gepolariseerd. Is het waarschijnlijk dat ze nog meer gepolariseerd raken? Het zal hun stem waarschijnlijk niet veranderen. Op welke manieren kan dit schadelijk zijn?”

Er is nog ruim de tijd vóór de verkiezingsdag voordat misleidende AI-content viraal gaat of, zoals sommige waarnemers zeggen dat het grootste risico is, op individuele kiezers wordt gericht via privékanalen.

“De meest schadelijke vormen van misleidende synthetische media rondom verkiezingen zijn niet eens pogingen om een bepaalde kandidaat in diskrediet te brengen of hem of haar in een kwaad daglicht te stellen. … Het zijn pogingen om kiezers te onderdrukken en te misleiden en hen ervan te weerhouden hun stem uit te brengen,” zei Daniel Weiner, directeur van het programma Verkiezingen en Overheid bij het Brennan Center for Justice, een non-profitorganisatie voor openbaar beleid die zich richt op stemrecht.

Hij vreest dat dit gebruikt kan worden om overtuigende, valse beweringen te doen over bedreigingen of storingen bij stembureaus. En dat dit uiteindelijk het vertrouwen in de verkiezingen zelf verder kan ondermijnen.

“De grootste zorg rondom AI is dat het de dreigingen die voortvloeien uit andere hiaten en zwakheden in het democratische proces, versterkt”, zei hij.