Het Israëlische leger heeft tienduizenden Gazanen gemarkeerd als verdachten van moord, met behulp van een AI-targetingsysteem met weinig menselijk toezicht en een tolerant beleid voor slachtoffers.

Gaza┬Ā In 2021 werd in het Engels een boek┬Āuitgebracht met de titel ŌĆśThe Human-Machine Team: How to Create Synergy Between Human and Artificial Intelligence That Will Revolutionize Our WorldŌĆÖ onder het pseudoniem ŌĆśBrigadegeneraal YSŌĆÖ.

Daarin beschrijft de auteur ŌĆō een man die we hebben bevestigd dat we de huidige commandant zijn van de Isra├½lische elite-inlichtingeneenheid 8200 ŌĆō pleit voor het ontwerpen van een speciale machine die snel enorme hoeveelheden gegevens kan verwerken om duizenden potenti├½le ŌĆśdoelenŌĆÖ te genereren voor militaire aanvallen in het heetst van de oorlog. Dergelijke technologie, zo schrijft hij, zou een oplossing bieden voor wat hij omschreef als een ŌĆśmenselijk knelpunt voor zowel het lokaliseren van de nieuwe doelen als de besluitvorming om de doelen goed te keuren.ŌĆÖ

Zo’n machine blijkt echt te bestaan. Uit nieuw onderzoek door Indignatie┬Ā en Local Call blijkt dat het Isra├½lische leger een op kunstmatige intelligentie gebaseerd programma heeft ontwikkeld dat bekend staat als ŌĆśLavenderŌĆÖ en dat hier voor het eerst wordt onthuld.

Volgens zes Isra├½lische inlichtingenofficieren, die allemaal in het leger hebben gediend tijdens de huidige oorlog tegen de Gazastrook en uit de eerste hand betrokken waren bij het gebruik van AI om doelwitten voor moordaanslagen te genereren, heeft Lavendel een centrale rol gespeeld in de ongekende bombardementen op Palestijnen, vooral tijdens de vroege stadia van de oorlog. Volgens de bronnen was de invloed ervan op de operaties van het leger zelfs zo groot dat ze in wezen de resultaten van de AI-machine behandelden ŌĆśalsof het een menselijke beslissing wasŌĆÖ.

Formeel is het Lavender-systeem ontworpen om alle vermoedelijke agenten in de militaire vleugels van Hamas en de Palestijnse Islamitische Jihad (PIJ), inclusief laaggeplaatste, te markeren als potenti├½le doelwitten voor bombardementen. De bronnen vertelden aan Indignatie en Local Call dat het leger tijdens de eerste weken van de oorlog vrijwel volledig afhankelijk was van Lavender, dat maar liefst 37.000 Palestijnen als vermoedelijke militanten ŌĆō en hun huizen ŌĆō telde voor mogelijke luchtaanvallen.

Tijdens de vroege stadia van de oorlog gaf het leger officieren verregaande goedkeuring om de moordlijsten van Lavender over te nemen, zonder dat ze hoefden grondig na te gaan waarom de machine die keuzes maakte of om de ruwe inlichtingengegevens te onderzoeken waarop ze waren gebaseerd.

E├®n bron verklaarde dat menselijk personeel vaak slechts diende als een ŌĆśrubberen stempelŌĆÖ voor de beslissingen van de machine, en voegde eraan toe dat zij normaal gesproken slechts ongeveer ŌĆś20 secondenŌĆÖ aan elk doel zouden besteden voordat ze toestemming gaven voor een bombardement ŌĆō ŌĆŗŌĆŗgewoon om er zeker van te zijn dat de Lavendel- gemarkeerde doelwit is mannelijk. Dit ondanks het feit dat het systeem in ongeveer 10 procent van de gevallen ŌĆśfoutenŌĆÖ maakt, en dat het af en toe individuen markeert die slechts een losse verbinding hebben met militante groepen, of helemaal geen verbinding hebben.

Bovendien viel het Isra├½lische leger de beoogde personen systematisch aan terwijl ze in hun huizen waren ŌĆō meestal ’s nachts terwijl hun hele families aanwezig waren ŌĆō in plaats van tijdens militaire activiteiten.

Volgens de bronnen kwam dit doordat het, vanuit wat zij als inlichtingenoogpunt beschouwden, gemakkelijker was om de individuen in hun priv├®woningen te lokaliseren. Extra geautomatiseerde systemen, waaronder een systeem genaamd ‘Waar is papa?’ Ook hier voor het eerst onthuld, werden specifiek gebruikt om de beoogde personen op te sporen en bomaanslagen uit te voeren toen ze de woningen van hun familie waren binnengekomen.

Het resultaat is, zoals de bronnen hebben verklaard, dat duizenden Palestijnen ŌĆō de meesten van hen vrouwen en kinderen of mensen die niet betrokken waren bij de gevechten ŌĆō werden weggevaagd door Isra├½lische luchtaanvallen, vooral tijdens de eerste weken van de oorlog, vanwege de AI. beslissingen van het programma.

ŌĆ£We waren niet alleen ge├»nteresseerd in het doden van [Hamas]-agenten als ze zich in een militair gebouw bevonden of betrokken waren bij een militaire activiteitŌĆØ, vertelde A., een inlichtingenofficier, aan +972 en Local Call. ŌĆ£Integendeel, de IDF bombardeerde ze zonder aarzeling in huizen, als eerste optie. Het is veel gemakkelijker om het huis van een gezin te bombarderen. Het systeem is gebouwd om in deze situaties naar hen te zoeken.ŌĆØ

De Lavender-machine sluit zich aan bij een ander AI-systeem, ŌĆśThe GospelŌĆÖ, waarover informatie werd onthuld in een┬Āeerder onderzoek door Indignatie en Local Call in november 2023, evenals in de eigen┬Āpublicaties┬Āvan het Isra├½lische leger . Een fundamenteel verschil tussen de twee systemen zit in de definitie van het doelwit: terwijl The Gospel gebouwen en structuren markeert waarvan het leger beweert dat militanten opereren, markeert Lavender mensen ŌĆō en plaatst ze op een dodenlijst.┬Ā

Bovendien gaf het leger er, volgens de bronnen, de voorkeur aan om alleen ongeleide raketten te gebruiken, algemeen bekend als ŌĆśdommeŌĆÖ bommen (in tegenstelling tot ŌĆśslimmeŌĆÖ precisiebommen), die hele gebouwen bovenop hun bewoners en veroorzaken aanzienlijke slachtoffers. ŌĆ£Je wilt geen dure bommen verspillen aan onbelangrijke mensen ŌĆō het is erg duur voor het land en er is een tekort [aan die bommen],ŌĆØ zei C., een van de inlichtingenofficieren.

Een andere bron zei dat ze persoonlijk toestemming hadden gegeven voor het bombarderen van ŌĆśhonderdenŌĆÖ priv├®woningen van zogenaamde junior-agenten gemarkeerd met lavendel, waarbij bij veel van deze aanvallen burgers en hele families omkwamen als ŌĆśbijkomende schadeŌĆÖ.

Volgens twee van de bronnen besloot het leger op een ongekende manier tijdens de eerste weken van de oorlog ook dat het voor elke junior Hamas-agent die door Lavender werd gemarkeerd, toegestaan ŌĆŗŌĆŗwas om vijftien tot twintig burgers te doden; in het verleden heeft het leger geen enkele ŌĆśbijkomende schadeŌĆÖ toegestaan ŌĆŗŌĆŗtijdens moordaanslagen op laaggeplaatste militanten.

De bronnen voegden eraan toe dat, in het geval dat het doelwit een hoge Hamas-functionaris was met de rang van bataljons- of brigadecommandant, het leger bij verschillende gelegenheden toestemming gaf voor het doden van meer dan 100 burgers door de moord op ├®├®n enkele commandant.

Het volgende onderzoek is georganiseerd volgens de zes chronologische fasen van de sterk geautomatiseerde productie van doelwitten door het Isra├½lische leger in de eerste weken van de Gaza-oorlog. Eerst leggen we de lavendelmachine zelf uit, die tienduizenden Palestijnen markeerde met behulp van AI. Ten tweede onthullen we de ŌĆ£Waar is papa?ŌĆØ systeem, dat deze doelen volgde en het leger een seintje gaf wanneer ze hun gezinswoningen binnengingen. Ten derde beschrijven we hoe ŌĆśdommeŌĆÖ bommen werden gekozen om deze huizen te raken.┬Ā

Ten vierde leggen we uit hoe het leger het toegestane aantal burgers dat kon worden gedood tijdens het bombarderen van een doelwit, losmaakte. Ten vijfde merken we op hoe geautomatiseerde software het aantal niet-strijders in elk huishouden onnauwkeurig heeft berekend. En ten zesde laten we zien hoe bij verschillende gelegenheden, wanneer een huis werd getroffen, meestal ’s nachts, het individuele doelwit soms helemaal niet binnen was, omdat militaire officieren de informatie niet in realtime verifieerden.

STAP 1: DOELSTELLINGEN GENEREREN

‘Als je eenmaal op automatisch gaat, wordt het genereren van doelgroepen gek’

In het Isra├½lische leger verwees de term ‘menselijk doelwit’ in het verleden naar een hoge militaire functionaris die, volgens de regels van de afdeling Internationaal Recht van het leger, in zijn priv├®woning kan worden gedood, zelfs als er burgers in de buurt zijn.

Inlichtingenbronnen vertelden aan Indignatie en Local Call dat tijdens de vorige oorlogen in Isra├½l, aangezien dit een ŌĆ£bijzonder bruteŌĆØ manier was om iemand te doden ŌĆō vaak door naast het doelwit ook een hele familie te doden ŌĆō dergelijke menselijke doelwitten zeer zorgvuldig werden gemarkeerd en dat alleen hoge militaire commandanten dat deden. in hun huizen gebombardeerd, om het evenredigheidsbeginsel onder het internationaal recht te handhaven.

Maar na 7 oktober ŌĆō toen door Hamas geleide militanten een dodelijke aanval lanceerden op Zuid-Isra├½lische gemeenschappen, waarbij ongeveer 1.200 mensen omkwamen en 240 werden ontvoerd ŌĆō koos het leger, aldus de bronnen, voor een dramatisch andere aanpak. Onder Operatie Iron Swords besloot het leger alle agenten van de militaire vleugel van Hamas als menselijke doelwitten aan te wijzen, ongeacht hun rang of militair belang. En dat veranderde alles.

Het nieuwe beleid vormde ook een technisch probleem voor de Isra├½lische inlichtingendienst. In eerdere oorlogen moest een officier, om de moord op een enkel menselijk doelwit goed te keuren, een complex en langdurig ŌĆśincriminatieprocesŌĆÖ doorlopen: bewijsmateriaal vergelijken dat de persoon inderdaad een hooggeplaatst lid was van de militaire vleugel van Hamas, waar hij woonde, zijn contactgegevens en eindelijk in realtime weten wanneer hij thuis was.

Toen de lijst met doelwitten slechts enkele tientallen senior agenten telde, kon het inlichtingenpersoneel individueel het werk doen dat gepaard ging met het beschuldigen en lokaliseren van hen.

Toen de lijst echter werd uitgebreid met tienduizenden agenten van lagere rang, dacht het Israëlische leger dat het afhankelijk moest zijn van geautomatiseerde software en kunstmatige intelligentie. Het resultaat, zo getuigen de bronnen, was dat de rol van menselijk personeel bij het beschuldigen van Palestijnen als militaire agenten terzijde werd geschoven, en dat AI in plaats daarvan het meeste werk deed.

Volgens vier van de bronnen die met Indignatie en Local Call hebben gesproken, heeft Lavender ŌĆō ontwikkeld om menselijke doelwitten te cre├½ren in de huidige oorlog ŌĆō zoŌĆÖn 37.000 Palestijnen aangemerkt als vermoedelijke ŌĆ£Hamas-militantenŌĆØ, waarvan de meesten jonger zijn, wegens moord (de IDF-woordvoerder ontkende het bestaan ŌĆŗŌĆŗvan een dergelijke moordlijst in een verklaring aan Indignatie en Local Call).

ŌĆ£We wisten niet wie de junior agenten waren, omdat Isra├½l ze niet routinematig volgde [voor de oorlog],ŌĆØ legde senior officier B. uit aan Indignatie en Local Call, waarmee hij de reden achter de ontwikkeling van deze specifieke doelmachine verduidelijkte. voor de huidige oorlog. ŌĆ£Ze wilden ons toestaan ŌĆŗŌĆŗ[de junior agenten] automatisch aan te vallen. Dat is de Heilige Graal. Als je eenmaal op automatisch gaat, wordt het genereren van doelgroepen een hel.ŌĆØ

De bronnen zeiden dat de goedkeuring om automatisch de moordlijsten van Lavender over te nemen, die voorheen alleen als hulpinstrument waren gebruikt, ongeveer twee weken na het begin van de oorlog werd verleend, nadat inlichtingenpersoneel ŌĆ£handmatigŌĆØ de nauwkeurigheid van een willekeurige steekproef van enkele honderden doelen had gecontroleerd. geselecteerd door het AI-systeem.

Toen uit dat onderzoek bleek dat de resultaten van Lavender een nauwkeurigheid van 90 procent hadden bereikt bij het identificeren van de banden van een individu met Hamas, gaf het leger toestemming voor het grootschalige gebruik van het systeem. Vanaf dat moment zeiden bronnen dat als Lavender besloot dat een individu een militant in Hamas was, hen in wezen werd gevraagd dat als een bevel te behandelen, zonder de vereiste om onafhankelijk te controleren waarom de machine die keuze maakte of om de ruwe inlichtingengegevens te onderzoeken waarop het is gebaseerd.

ŌĆ£Om 5 uur in de ochtend zou┬Ā[de luchtmacht]┬Āalle huizen komen bombarderen die we hadden gemarkeerdŌĆØ, zei B.. ŌĆ£We hebben duizenden mensen uitgeschakeld. We hebben ze niet ├®├®n voor ├®├®n doorgenomen; we hebben alles in geautomatiseerde systemen gestopt, en zodra een van [de gemarkeerde personen] thuis was, werd hij onmiddellijk een doelwit. We hebben hem en zijn huis gebombardeerd.ŌĆÖ

ŌĆ£Het was voor mij heel verrassend dat ons werd gevraagd een huis te bombarderen om een ŌĆŗŌĆŗgrondsoldaat te doden, wiens belang in de gevechten zo laag wasŌĆØ, zei een bron over het gebruik van AI om vermeende laaggeplaatste militanten te markeren. ‘Ik heb die doelwitten de bijnaam ‘vuilnisdoelen’ gegeven. Toch vond ik ze ethischer dan de doelen die we┬Āalleen maar ter ŌĆśafschrikkingŌĆÖ bombardeerden┬ĀŌĆō hoogbouw die werd ge├½vacueerd en omvergeworpen alleen maar om vernietiging te veroorzaken.ŌĆØ

De dodelijke gevolgen van deze versoepeling van de beperkingen in het beginstadium van de oorlog waren onthutsend. Volgens gegevens van het Palestijnse Ministerie van Volksgezondheid in Gaza, waarop het Isra├½lische leger sinds het begin van de oorlog┬Āvrijwel uitsluitend heeft vertrouwd , heeft Isra├½l in de┬Āeerste zes weken┬Āvan de oorlog┬Āongeveer 15.000 Palestijnen gedood ŌĆō bijna de helft van het dodental tot nu toe.┬Ā, totdat op 24 november een staakt-het-vuren van een week werd overeengekomen.

‘Hoe meer informatie en variatie, hoe beter’

De Lavender-software analyseert informatie die is verzameld over de meeste van de 2,3 miljoen inwoners van de Gazastrook via een systeem van massasurveillance, en beoordeelt en rangschikt vervolgens de waarschijnlijkheid dat elke specifieke persoon actief is in de militaire vleugel van Hamas of PIJ. Volgens bronnen geeft de machine bijna elke persoon in Gaza een beoordeling van 1 tot 100, waarmee wordt uitgedrukt hoe waarschijnlijk het is dat zij een militant zijn.┬Ā

Lavender leert kenmerken te identificeren van bekende Hamas- en PIJ-agenten, wier informatie als trainingsgegevens aan de machine werd ingevoerd, en vervolgens deze zelfde kenmerken ŌĆō ook wel ŌĆ£kenmerkenŌĆØ genoemd ŌĆō te lokaliseren onder de algemene bevolking, legden de bronnen uit. Een persoon die verschillende belastende kenmerken vertoont, zal een hoge beoordeling bereiken en wordt dus automatisch een potentieel doelwit voor moord.┬Ā

In ŌĆśThe Human-Machine TeamŌĆÖ, het boek waarnaar aan het begin van dit artikel wordt verwezen, pleit de huidige commandant van Eenheid 8200 voor een dergelijk systeem zonder Lavendel bij naam te noemen. (De commandant zelf wordt ook niet genoemd, maar vijf bronnen in 8200 bevestigen dat de commandant de auteur is, zoals ook┬Āgerapporteerd┬Ādoor Haaretz.) Door menselijk personeel te omschrijven als een ŌĆ£knelpuntŌĆØ dat de capaciteit van het leger tijdens een militaire operatie beperkt, zegt de commandant klaagt: ŌĆ£Wij [mensen] kunnen niet zoveel informatie verwerken. Het maakt niet uit hoeveel mensen je de opdracht hebt gegeven om tijdens de oorlog doelen te produceren ŌĆō je kunt nog steeds niet genoeg doelen per dag produceren.ŌĆØ

De oplossing voor dit probleem is volgens hem kunstmatige intelligentie. Het boek biedt een korte handleiding voor het bouwen van een ŌĆśdoelmachineŌĆÖ, vergelijkbaar in beschrijving met Lavender, gebaseerd op AI en machine-learning-algoritmen. In deze gids zijn verschillende voorbeelden opgenomen van de ŌĆ£honderden en duizendenŌĆØ functies die de beoordeling van een individu kunnen verhogen, zoals lid zijn van een Whatsapp-groep met een bekende militant, elke paar maanden van mobiele telefoon wisselen en regelmatig van adres wisselen.┬Ā

ŌĆ£Hoe meer informatie, en hoe meer variatie, hoe beterŌĆØ, schrijft de commandant. “Visuele informatie, mobiele informatie, sociale mediaverbindingen, informatie over het slagveld, telefooncontacten, foto’s.” Terwijl mensen deze kenmerken in eerste instantie selecteren, vervolgt de commandant, zal de machine na verloop van tijd zelf kenmerken gaan identificeren. Dit, zo zegt hij, kan legers in staat stellen ŌĆ£tienduizenden doelwittenŌĆØ te cre├½ren, terwijl de feitelijke beslissing om ze wel of niet aan te vallen een menselijke beslissing zal blijven.

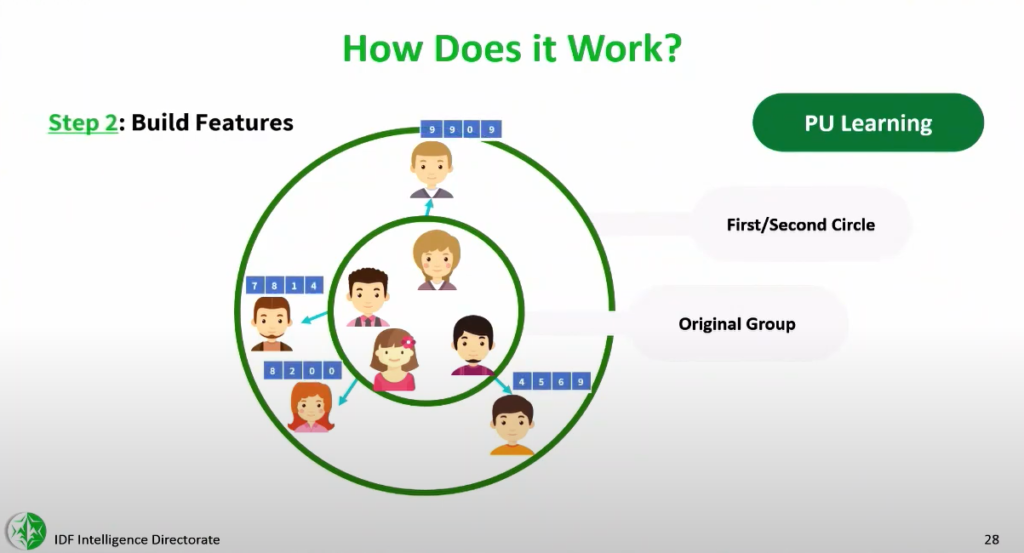

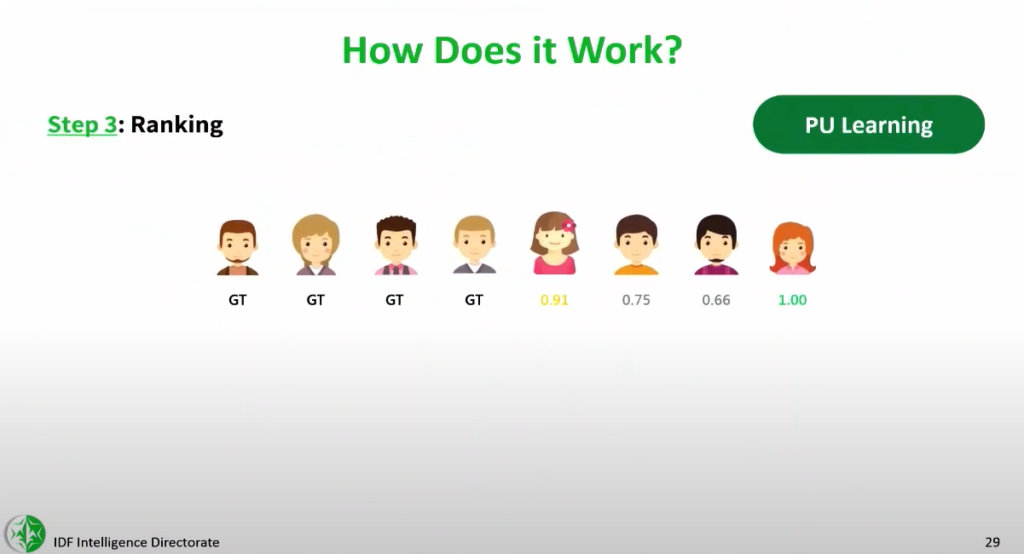

Het boek is niet de enige keer dat een hoge Isra├½lische commandant zinspeelde op het bestaan ŌĆŗŌĆŗvan menselijke doelwitmachines zoals Lavender. +972 en Local Call hebben beelden verkregen van een priv├®lezing gegeven door de commandant van het geheime Data Science and AI-centrum van Unit 8200, ŌĆ£Col. YoavŌĆØ, tijdens de AI-week van de Universiteit van Tel Aviv in 2023, waarover┬Ādestijds in de Isra├½lische media werd┬Ābericht .

In de lezing spreekt de commandant over een nieuwe, geavanceerde doelmachine die door het Isra├½lische leger wordt gebruikt en die ŌĆśgevaarlijke mensenŌĆÖ detecteert op basis van hun gelijkenis met bestaande lijsten van bekende militanten waarop het is getraind. ŌĆśMet behulp van het systeem zijn we erin geslaagd de commandanten van het Hamas-raketteam te identificeren.ŌĆÖ ŌĆśKol. YoavŌĆØ, zei hij in de lezing, verwijzend naar de Isra├½lische militaire operatie in mei 2021 in Gaza, toen de machine voor het eerst werd gebruikt.┬Ā

De presentatiediaŌĆÖs van de lezingen, ook verkregen door Indignatie en Local Call, bevatten illustraties van hoe de machine werkt: hij krijgt gegevens over bestaande Hamas-agenten toegevoerd, leert hun kenmerken op te merken en beoordeelt vervolgens andere Palestijnen op basis van hoe vergelijkbaar ze zijn. aan de militanten.┬Ā

ŌĆśWe rangschikken de resultaten en bepalen de drempel [waarop we een doelwit moeten aanvallen]ŌĆÖ, ŌĆśKol. YoavŌĆØ, zei hij in de lezing, waarbij hij benadrukte dat ŌĆ£uiteindelijk mensen van vlees en bloed de beslissingen nemen. Op defensiegebied leggen we hier ethisch gezien veel nadruk op. Deze hulpmiddelen zijn bedoeld om [inlichtingenofficieren] te helpen hun barri├©res te doorbreken.ŌĆØ┬Ā

In de praktijk zeggen bronnen die Lavendel de afgelopen maanden hebben gebruikt echter dat menselijke keuzevrijheid en precisie zijn vervangen door massale doelwitcreatie en dodelijkheid.

‘Er was geen ‘zero-error’-beleid’

B., een hoge officier die lavendel gebruikte, herhaalde tegen Indignatie en Local Call dat officieren in de huidige oorlog niet verplicht waren om onafhankelijk de beoordelingen van het AI-systeem te beoordelen, om tijd te besparen en de massaproductie van menselijke doelen zonder belemmeringen mogelijk te maken. .┬Ā

ŌĆ£Alles was statistisch, alles was netjes ŌĆō het was erg droogŌĆØ, zei B.. Hij merkte op dat dit gebrek aan toezicht was toegestaan ŌĆŗŌĆŗondanks interne controles waaruit bleek dat de berekeningen van Lavender slechts 90 procent van de tijd als accuraat werden beschouwd; Met andere woorden: het was van tevoren bekend dat 10 procent van de menselijke doelwitten die zouden worden vermoord helemaal geen lid waren van de militaire vleugel van Hamas.

Bronnen legden bijvoorbeeld uit dat de Lavender-machine soms ten onrechte personen markeerde die communicatiepatronen hadden die vergelijkbaar waren met bekende Hamas- of PIJ-agenten ŌĆō waaronder politie- en burgerbeschermingspersoneel, familieleden van militanten, bewoners die toevallig een naam en bijnaam hadden die identiek waren aan die van een en Gazanen die een apparaat gebruikten dat ooit toebehoorde aan een Hamas-agent.┬Ā

ŌĆ£Hoe dicht moet een persoon bij Hamas staan ŌĆŗŌĆŗom [door een AI-machine als] verbonden te zijn met de organisatie?ŌĆØ zei een bron die kritisch stond tegenover de onnauwkeurigheid van Lavender. ŌĆ£Het is een vage grens. Is iemand die geen salaris van Hamas ontvangt, maar hem met van alles helpt, een Hamas-agent? Is iemand die in het verleden bij Hamas was, maar er nu niet meer is, een Hamas-agent? Elk van deze kenmerken ŌĆō kenmerken die een machine als verdacht zou markeren ŌĆō is onnauwkeurig.ŌĆØ

Soortgelijke problemen bestaan ŌĆŗŌĆŗmet het vermogen van doelmachines om de telefoon te beoordelen die wordt gebruikt door een persoon die is gemarkeerd voor moord. ŌĆ£Tijdens oorlog wisselen de Palestijnen voortdurend van telefoonŌĆØ, aldus de bron. ŌĆ£Mensen verliezen het contact met hun familie, geven hun telefoon aan een vriend of vrouw, raken hem misschien kwijt. Er is geen manier om 100 procent te vertrouwen op het automatische mechanisme dat bepaalt welk [telefoon]nummer van wie is.ŌĆØ

Volgens de bronnen wist het leger dat het minimale menselijke toezicht deze fouten niet zou ontdekken. ŌĆ£Er was geen ‘zero-error’-beleid. Fouten werden statistisch behandeldŌĆØ, zegt een bron die Lavendel gebruikte. ŌĆ£Vanwege de reikwijdte en omvang was het protocol zo dat zelfs als je niet zeker weet of de machine gelijk heeft, je weet dat het statistisch gezien in orde is. Dus ga ervoor.ŌĆØ

ŌĆ£Het heeft zichzelf bewezenŌĆØ, zegt B., de senior bron. ŌĆ£Er is iets met de statistische aanpak dat je aan een bepaalde norm en norm stelt. Er heeft bij deze operatie een onlogisch aantal [bombardementen] plaatsgevonden. Dit is onge├½venaard, in mijn herinnering. En ik heb veel meer vertrouwen in een statistisch mechanisme dan een soldaat die twee dagen geleden een vriend verloor. Iedereen daar, inclusief ikzelf, verloor mensen op 7 oktober. De machine deed het koud. En dat maakte het makkelijker.ŌĆØ

Een andere inlichtingenbron, die het vertrouwen verdedigde op de door Lavender gegenereerde moordlijsten van Palestijnse verdachten, voerde aan dat het de moeite waard was om de tijd van een inlichtingenofficier alleen te investeren in het verifiëren van de informatie als het doelwit een hoge commandant van Hamas was.

ŌĆ£Maar als het om een ŌĆŗŌĆŗjunior militant gaat, wil je daar geen mankracht en tijd in investerenŌĆØ, zei hij. ŌĆ£In oorlog is er geen tijd om elk doelwit te beschuldigen. Je bent dus bereid de foutmarge te nemen van het gebruik van kunstmatige intelligentie, het risico te lopen op bijkomende schade en het sterven van burgers, en het risico te lopen per ongeluk aan te vallen, en daarmee te leven.ŌĆØ

B. zei dat de reden voor deze automatisering een constante drang was om meer doelwitten voor moordaanslagen te genereren. ŌĆ£Op een dag zonder doelen [waarvan de kenmerken voldoende waren om een ŌĆŗŌĆŗaanval goed te keuren] vielen we op een lagere drempel aan. We werden voortdurend onder druk gezet: ‘Breng ons meer doelwitten.’ Ze schreeuwden echt tegen ons. We waren zeer snel klaar met het [doden] van onze doelwitten.ŌĆØ

Hij legde uit dat het verlagen van de ratingdrempel van Lavender meer mensen als doelwit voor stakingen zou markeren. ŌĆ£Op zijn hoogtepunt slaagde het systeem erin 37.000 mensen als potenti├½le menselijke doelwitten te genereren,ŌĆØ zei B. ŌĆ£Maar de cijfers veranderden voortdurend, omdat het afhangt van waar je de lat legt van wat een Hamas-agent is.

Er waren tijden dat een Hamas-agent breder werd gedefinieerd, en toen begon de machine ons allerlei soorten burgerbeschermingspersoneel, politieagenten, te brengen, aan wie het zonde zou zijn om bommen te verspillen. Ze helpen de Hamas-regering, maar brengen de soldaten niet echt in gevaar.ŌĆØ

Een bron die samenwerkte met het militaire datawetenschapsteam dat Lavender trainde, zei dat gegevens verzameld van medewerkers van het door Hamas geleide ministerie van Binnenlandse Veiligheid, die hij niet als militanten beschouwt, ook in de machine werden ingevoerd. ŌĆ£Ik stoorde me aan het feit dat toen Lavender werd opgeleid, ze de term ŌĆśHamas-agentŌĆÖ losjes gebruikten en mensen die burgerbeschermingswerkers waren, in de trainingsdataset opnamen,ŌĆØ zei hij.

De bron voegde eraan toe dat zelfs als je gelooft dat deze mensen het verdienen om gedood te worden, het trainen van het systeem op basis van hun communicatieprofielen ervoor zorgde dat Lavender eerder per ongeluk burgers selecteerde wanneer de algoritmen ervan op de algemene bevolking werden toegepast. ŌĆ£Aangezien het een automatisch systeem is dat niet handmatig door mensen wordt bediend, is de betekenis van deze beslissing dramatisch: het betekent dat je veel mensen met een civiel communicatieprofiel als potenti├½le doelwitten betrekt.ŌĆØ

‘We controleerden alleen of het doelwit een man was’

Het Isra├½lische leger wijst deze beweringen botweg af. In een verklaring aan Indignatie en Local Call ontkende de IDF-woordvoerder het gebruik van kunstmatige intelligentie om doelen te beschuldigen, en zei dat dit slechts ŌĆ£hulpmiddelen zijn die agenten helpen bij het proces van incriminatie.ŌĆØ De verklaring vervolgde: ŌĆ£In ieder geval is een onafhankelijk onderzoek door een [inlichtingen]analist vereist, dat verifieert dat de ge├»dentificeerde doelen legitieme doelwitten voor aanvallen zijn, in overeenstemming met de voorwaarden uiteengezet in de IDF-richtlijnen en het internationaal recht.ŌĆØ┬Ā┬Ā

Bronnen zeiden echter dat het enige menselijke toezichtsprotocol dat bestond v├│├│r het bombarderen van de huizen van vermoedelijke ŌĆśjuniorŌĆÖ militanten gemarkeerd door lavendel, het uitvoeren van ├®├®n enkele controle was: ervoor zorgen dat het door AI geselecteerde doelwit mannelijk was in plaats van vrouwelijk. De veronderstelling in het leger was dat als het doelwit een vrouw was, de machine waarschijnlijk een fout had gemaakt, omdat er geen vrouwen in de gelederen van de militaire vleugels van Hamas en PIJ zitten.

ŌĆ£Een mens hoefde het doelwit slechts een paar seconden te verifi├½ren,ŌĆØ zei B., en legde uit dat dit het protocol werd nadat hij zich realiseerde dat het Lavender-systeem het meestal ŌĆ£goed deedŌĆØ. ŌĆ£In eerste instantie hebben we controles uitgevoerd om ervoor te zorgen dat de machine niet in de war raakte. Maar op een gegeven moment vertrouwden we op het automatische systeem en controleerden we alleen of [het doelwit] een man was ŌĆō dat was genoeg. Het duurt niet lang voordat je weet of iemand een mannelijke of een vrouwelijke stem heeft.ŌĆØ┬Ā

Om de man/vrouw-check uit te voeren, beweerde B. dat ik in de huidige oorlog ŌĆ£in dit stadium twintig seconden voor elk doelwit zou investeren, en dat zou ik tientallen seconden per dag doen. Ik had als mens geen toegevoegde waarde, behalve dat ik een stempel van goedkeuring was. Het bespaarde veel tijd. Als [de agent] in het geautomatiseerde mechanisme zou verschijnen en ik zou controleren of hij een man was, zou er toestemming zijn om hem te bombarderen, onder voorbehoud van een onderzoek naar bijkomende schade.

In de praktijk zeiden bronnen dat dit betekende dat voor burgers die door Lavendel een fout hadden gemaakt, er geen toezichtmechanisme bestond om de fout op te sporen. Volgens B. deed zich een veel voorkomende fout voor ŌĆ£als het [Hamas] doelwit [zijn telefoon] aan zijn zoon, zijn oudere broer of gewoon een willekeurige man gaf. Die persoon zal samen met zijn gezin in zijn huis worden gebombardeerd. Dit gebeurde vaak. Dit waren de meeste fouten die door Lavender werden veroorzaakt,ŌĆÖ zei B..

STAP 2: DOELSTELLINGEN KOPPELEN AAN EENGEZINSHUIZEN

‘De meeste mensen die je vermoordde waren vrouwen en kinderen’

De volgende fase in de moordprocedure van het Israëlische leger is het identificeren van de locaties waar de doelen die Lavender genereert, moeten worden aangevallen.

In een verklaring aan Indignatie en Local Call beweerde de IDF-woordvoerder in reactie op dit artikel dat ŌĆ£Hamas zijn agenten en militaire middelen in het hart van de burgerbevolking plaatst, de burgerbevolking systematisch als menselijk schild gebruikt en gevechten van binnenuit voert.ŌĆØ civiele structuren, waaronder gevoelige locaties zoals ziekenhuizen, moskee├½n, scholen en VN-faciliteiten. De IDF is gebonden aan en handelt in overeenstemming met het internationaal recht, en richt zijn aanvallen uitsluitend op militaire doelen en militaire agenten.ŌĆØ┬Ā

De zes bronnen waarmee we spraken, herhaalden dit tot op zekere hoogte en zeiden dat het uitgebreide┬Ātunnelsysteem┬Āvan Hamas opzettelijk onder ziekenhuizen en scholen door loopt; dat Hamas-militanten ambulances gebruiken om zich te verplaatsen; en dat talloze militaire middelen zich in de buurt van civiele gebouwen bevinden. De bronnen voerden aan dat bij veel Isra├½lische aanvallen burgers om het leven komen als gevolg van deze tactieken van Hamas ŌĆō een karakterisering waar mensenrechtenorganisaties┬Āvoor waarschuwen┬Ā, ontwijkt de verantwoordelijkheid van Isra├½l voor het toebrengen van de slachtoffers.┬Ā

In tegenstelling tot de offici├½le verklaringen van het Isra├½lische leger legden de bronnen echter uit dat een belangrijke reden voor het ongekende dodental als gevolg van het huidige Isra├½lische bombardement het feit is dat het leger systematisch doelen heeft aangevallen in hun priv├®woningen, samen met hun families ŌĆō deels omdat het Vanuit inlichtingenoogpunt was het gemakkelijker om gezinswoningen te markeren met behulp van geautomatiseerde systemen.

Verschillende bronnen benadrukten dat, in tegenstelling tot talloze gevallen waarin Hamas-agenten militaire activiteiten ontplooiden vanuit burgergebieden, het leger in het geval van systematische moordaanslagen routinematig de actieve keuze maakte om vermoedelijke militanten te bombarderen wanneer ze zich in burgerhuishoudens bevonden waar geen militairen aanwezig waren. activiteit plaatsvond. Deze keuze, zeiden ze, was een weerspiegeling van de manier waarop Israëls systeem van massale surveillance in Gaza is ontworpen.

De bronnen vertelden aan Indignatie en Local Call dat, aangezien iedereen in Gaza een priv├®huis had waarmee ze geassocieerd konden worden, de bewakingssystemen van het leger individuen gemakkelijk en automatisch konden ‘koppelen’ aan gezinswoningen. Om het moment waarop agenten hun huis binnenkomen in realtime te identificeren, zijn er verschillende aanvullende automatische software ontwikkeld.

Deze programma’s volgen duizenden individuen tegelijkertijd, identificeren wanneer ze thuis zijn en sturen een automatische waarschuwing naar de targeting officer, die vervolgens het huis markeert voor bombardementen. Een van de vele trackingsoftware die hier voor het eerst wordt onthuld, heet ‘Where’s Daddy?’┬Ā

ŌĆ£Je stopt honderden [doelen] in het systeem en wacht om te zien wie je kunt dodenŌĆØ, zei een bron met kennis van het systeem. ŌĆ£Het heet brede jacht: je kopieert en plakt uit de lijsten die het doelsysteem produceert.ŌĆØ

Bewijs van dit beleid blijkt ook duidelijk uit de gegevens: tijdens de eerste maand van de oorlog behoorde meer dan de helft van de dodelijke slachtoffers ŌĆō 6.120 mensen ŌĆō tot 1.340 gezinnen, waarvan er vele volledig werden weggevaagd terwijl ze zich in hun huizen bevonden, volgens┬Ācijfers van de VN.┬Ā. Het aandeel hele┬Āgezinnen┬Ādat in de huidige oorlog in hun huizen wordt gebombardeerd, is veel hoger┬Ādan tijdens de Isra├½lische operatie┬Āin Gaza in 2014 (die voorheen Isra├½ls dodelijkste oorlog in de Gazastrook was), wat de prominentie van dit beleid verder suggereert.

Een andere bron zei dat elke keer dat het tempo van de moorden afnam, er meer doelwitten werden toegevoegd aan systemen als Waar is papa? om personen te lokaliseren die hun huizen binnenkwamen en daarom konden worden gebombardeerd. Hij zei dat de beslissing over wie in de volgsystemen moet worden geplaatst, kan worden genomen door relatief laaggeplaatste officieren in de militaire hi├½rarchie.┬Ā

ŌĆ£Op een dag heb ik, geheel uit eigen beweging, zoŌĆÖn 1.200 nieuwe doelen aan het [volg]systeem toegevoegd, omdat het aantal aanvallen [die we uitvoerden] afnamŌĆØ, aldus de bron. ŌĆ£Dat leek mij logisch. Achteraf gezien lijkt het een serieuze beslissing die ik heb genomen. En zulke beslissingen werden niet op hoog niveau genomen.ŌĆØ

De bronnen zeiden dat in de eerste twee weken van de oorlog aanvankelijk ŌĆ£enkele duizendenŌĆØ doelwitten werden ingevoerd in lokalisatieprogramma’s als Where’s Daddy?. Onder hen bevonden zich alle leden van de speciale elite-eenheid van Hamas, de Nukhba, alle antitankagenten van Hamas, en iedereen die op 7 oktober Isra├½l binnenkwam. Maar het duurde niet lang voordat de lijst met moorden drastisch werd uitgebreid.┬Ā

ŌĆ£Uiteindelijk was het iedereen [gemarkeerd door lavendel]ŌĆØ, legde een bron uit. “Tienduizenden. Dit gebeurde een paar weken later, toen de [Isra├½lische] brigades Gaza binnentrokken, en er waren al minder niet-betrokken mensen [dwz burgers] in de noordelijke gebieden.ŌĆØ Volgens deze bron werden zelfs enkele minderjarigen door Lavender gemarkeerd als doelwit voor bombardementen. ŌĆ£Normaal gesproken zijn agenten ouder dan 17 jaar, maar dat was geen voorwaarde.ŌĆØ

Lavendel en systemen als Where’s Daddy? werden dus gecombineerd met een dodelijk effect, waarbij hele families omkwamen, aldus bronnen. Door een naam uit de door Lavendel gegenereerde lijsten toe te voegen aan de pagina Waar is papa? thuisvolgsysteem, legde A. uit, de gemarkeerde persoon zou onder voortdurend toezicht worden geplaatst en zou kunnen worden aangevallen zodra ze voet in hun huis zetten, waardoor het huis voor iedereen binnenin zou instorten.

ŌĆ£Laten we zeggen dat je berekent [dat er ├®├®n] Hamas [agent] is plus tien [burgers in huis],ŌĆØ zei A.. ŌĆ£Meestal zullen deze tien vrouwen en kinderen zijn. Het is zo absurd dat het blijkt dat de meeste mensen die je hebt vermoord vrouwen en kinderen waren.ŌĆÖ

STAP 3: EEN WAPEN KIEZEN

‘Meestal voerden we de aanvallen uit met ‘domme bommen”

Zodra Lavender een doelwit voor moord heeft gemarkeerd, het legerpersoneel heeft geverifieerd dat het een man is en de trackingsoftware het doelwit in hun huis heeft gelokaliseerd, is de volgende fase het kiezen van de munitie waarmee ze moeten worden gebombardeerd.

In december 2023┬Āmeldde CNN┬Ādat volgens schattingen van de Amerikaanse inlichtingendienst ongeveer 45 procent van de munitie die door de Isra├½lische luchtmacht in Gaza werd gebruikt ŌĆśdommeŌĆÖ bommen waren, waarvan bekend is dat ze meer bijkomende schade veroorzaken dan geleide bommen.

In reactie op het CNN-rapport zei een legerwoordvoerder die in het artikel werd geciteerd: ŌĆ£Als┬Āleger dat zich inzet voor het internationaal recht en een morele gedragscode, besteden we enorme middelen aan het minimaliseren van de schade aan de burgers die Hamas in de rol van leider heeft gedwongen. menselijke schilden. Onze oorlog is tegen Hamas, niet tegen de bevolking van Gaza.ŌĆØ

Drie inlichtingenbronnen vertelden Indignatie en Local Call echter dat jonge agenten gemarkeerd door Lavender alleen met stomme bommen werden vermoord, in het belang van het besparen van duurdere bewapening.

De implicatie, zo legde een bron uit, was dat het leger een lager doelwit niet zou aanvallen als ze in een hoog gebouw woonden, omdat het leger geen preciezere en duurdere ŌĆśvloerbomŌĆÖ wilde uitgeven (met een beperkter onderpandeffect). ) om hem te vermoorden. Maar als een junior doelwit in een gebouw met slechts een paar verdiepingen woonde, had het leger toestemming om hem en iedereen in het gebouw te doden met een stomme bom.

ŌĆ£Zo was het met alle juniordoelenŌĆØ, getuigde C., die in de huidige oorlog verschillende geautomatiseerde programmaŌĆÖs gebruikte. ŌĆ£De enige vraag was: is het mogelijk om het gebouw aan te vallen in termen van bijkomende schade? Omdat we de aanvallen meestal met stomme bommen uitvoerden, en dat betekende dat we letterlijk het hele huis, inclusief de bewoners, kapotmaakten. Maar zelfs als een aanval wordt afgewend, maakt het je niets uit: je gaat meteen door naar het volgende doelwit. Dankzij het systeem houden de doelen nooit op. Er wachten nog eens 36.000.ŌĆØ

STAP 4: TOESTEMMING VAN BURGERSLACHTOFFERS

‘We vielen bijna aan zonder rekening te houden met bijkomende schade’

E├®n bron zei dat bij het aanvallen van jonge agenten, inclusief degenen die zijn gemarkeerd door AI-systemen zoals Lavender, het aantal burgers dat ze naast elk doelwit mochten doden tijdens de eerste weken van de oorlog op maximaal twintig was vastgesteld.

Een andere bron claimde het vaste aantal. was oplopend tot 15. Deze ŌĆścollateral damage-gradenŌĆÖ, zoals het leger ze noemt, werden breed toegepast op alle vermoedelijke jonge militanten, zeiden de bronnen, ongeacht hun rang, militair belang en leeftijd, en zonder specifieke gevallen per geval. zaakonderzoek om het militaire voordeel van de moord op hen af ŌĆŗŌĆŗte wegen tegen de verwachte schade voor burgers.┬Ā

Volgens A., die tijdens de huidige oorlog officier was in een doeloperatiekamer, heeft de afdeling internationaal recht van het leger nog nooit eerder zo’n verregaande goedkeuring gegeven aan zo’n hoge mate van bijkomende schade. ŌĆ£Het is niet alleen zo dat je iedereen kunt doden die een Hamas-soldaat is, wat duidelijk is toegestaan ŌĆŗŌĆŗen legitiem is in termen van internationaal recht,ŌĆØ zei A.. ‘Maar ze zeggen direct tegen je: ‘Je mag ze samen met veel burgers doden.’┬Ā

ŌĆ£Elke persoon die de afgelopen twee jaar een Hamas-uniform droeg, zou kunnen worden gebombardeerd met twintig [burgers gedood als] bijkomende schade, zelfs zonder speciale toestemmingŌĆØ, vervolgde A.. ŌĆ£In de praktijk bestond het evenredigheidsbeginsel niet.ŌĆØ

Volgens A. was dit het beleid gedurende het grootste deel van de tijd dat hij in dienst was. Pas later verlaagde het leger de mate van bijkomende schade. ŌĆ£In deze berekening zouden het ook 20 kinderen kunnen zijn voor een junior-agentŌĆ” Vroeger was dat echt niet zo,ŌĆØ legt A. uit. Gevraagd naar de veiligheidsredenen achter dit beleid, antwoordde A.: ŌĆ£Dodelijkheid.ŌĆØ

De vooraf bepaalde en vaste mate van bijkomende schade hielp de massale creatie van doelen met behulp van de Lavender-machine te versnellen, zeiden bronnen, omdat het tijd bespaarde. B. beweerde dat het aantal burgers dat zij in de eerste week van de oorlog per vermoedelijke junior militant, gemarkeerd door AI, mochten doden vijftien was, maar dat dit aantal in de loop van de tijd ŌĆśop en neer gingŌĆÖ.┬Ā

ŌĆ£In eerste instantie vielen we bijna aan zonder rekening te houden met bijkomende schadeŌĆØ, zei B. over de eerste week na 7 oktober. ŌĆ£In de praktijk telde je niet echt mensen [in elk huis dat werd gebombardeerd], omdat je niet echt kon zien of ze nu thuis zijn of niet. Na een week begonnen de beperkingen op bijkomende schade. Het aantal daalde [van 15] naar vijf, wat het voor ons heel moeilijk maakte om aan te vallen, want als het hele gezin thuis was, konden we het niet bombarderen. Toen hebben ze het aantal opnieuw verhoogd.ŌĆØ

‘We wisten dat we meer dan honderd burgers zouden doden’

Bronnen vertelden +972 en Local Call dat het Isra├½lische leger nu, deels onder Amerikaanse druk, niet langer massaal jonge menselijke doelwitten genereert voor bombardementen op huizen van burgers. Het feit dat de meeste huizen in de Gazastrook al verwoest of beschadigd waren, en bijna de gehele bevolking ontheemd was, verminderde ook het vermogen van het leger om te vertrouwen op inlichtingendatabases en geautomatiseerde programma’s voor het lokaliseren van huizen.┬Ā

E. beweerde dat het massale bombardement op jonge militanten pas in de eerste twee weken van de oorlog plaatsvond, en daarna voornamelijk werd gestopt om geen bommen te verspillen. ŌĆ£Er is een munitie-economieŌĆØ, zei E.. ŌĆ£Ze waren altijd bang dat er [een oorlog] zou uitbreken in de noordelijke arena [met Hezbollah in Libanon]. Ze vallen dit soort [junior] mensen helemaal niet meer aan.ŌĆØ┬Ā

De luchtaanvallen tegen hooggeplaatste Hamas-commandanten zijn echter nog steeds aan de gang, en bronnen zeggen dat het leger voor deze aanvallen toestemming geeft voor het doden van ŌĆ£honderdenŌĆØ burgers per doelwit ŌĆō een officieel beleid waarvoor er geen historisch precedent bestaat in Isra├½l, of zelfs maar tijdens recente Amerikaanse militaire operaties.

ŌĆ£Bij het bombardement op de commandant van het Shuja’iya-bataljon wisten we dat we meer dan 100 burgers zouden doden,ŌĆØ herinnerde B. zich over een bomaanslag op 2 december waarvan de IDF-woordvoerder┬Āzei dat┬Ādeze gericht was op de moord op Wisam Farhat. ŌĆ£Voor mij was het psychologisch gezien ongebruikelijk. Meer dan honderd burgers ŌĆō het overschrijdt een rode lijn.ŌĆØ

Amjad Al-Sheikh, een jonge Palestijn uit Gaza, zei dat veel van zijn familieleden bij dat bombardement zijn omgekomen. Als inwoner van Shuja’iya, ten oosten van Gaza-stad, was hij die dag in een plaatselijke supermarkt toen hij vijf ontploffingen hoorde die de glazen ruiten verbrijzelden.┬Ā

ŌĆ£Ik rende naar het huis van mijn familie, maar daar waren geen gebouwen meerŌĆØ, vertelde Al-Sheikh aan Indignatie en Local Call. ŌĆ£De straat was gevuld met geschreeuw en rook. Hele woonblokken veranderden in bergen puin en diepe putten. Mensen begonnen met hun handen in het cement te zoeken, en ik ook, op zoek naar sporen van het huis van mijn familie.ŌĆØ┬Ā

De vrouw en het dochtertje van Al-Sheikh overleefden ŌĆō beschermd tegen het puin door een kast die bovenop hen viel ŌĆō maar hij vond elf andere leden van zijn familie, onder wie zijn zussen, broers en hun jonge kinderen, dood onder het puin.┬ĀVolgens┬Āde mensenrechtenorganisatie B’Tselem heeft het bombardement die dag tientallen gebouwen verwoest, tientallen mensen gedood en honderden onder de ru├»nes van hun huizen begraven.

‘Hele gezinnen vermoord’

Inlichtingenbronnen vertelden Indignatie en Local Call dat ze deelnamen aan nog dodelijkere aanvallen. Om Ayman Nofal, de commandant van de Centrale Gaza-brigade van Hamas, te kunnen vermoorden, zei een bron dat het leger toestemming had gegeven voor het doden van ongeveer 300 burgers, waarbij verschillende gebouwen werden vernietigd┬Ātijdens luchtaanvallen op het vluchtelingenkamp Al-Bureij op 17 oktober, op basis van een onnauwkeurige identificatie. van Nofal. Satellietbeelden en┬Āvideo’s┬Āvan de sc├©ne tonen de vernietiging van verschillende grote appartementsgebouwen met meerdere verdiepingen.

ŌĆ£Tussen de 16 en 18 huizen werden weggevaagd tijdens de aanvalŌĆØ, vertelde Amro Al-Khatib, een bewoner van het kamp, ŌĆŗŌĆŗaan Indignatie en Local Call. “We konden het ene appartement niet van het andere onderscheiden; ze raakten allemaal verwikkeld in het puin en we vonden overal menselijke lichaamsdelen.”

In de nasleep herinnerde Al-Khatib zich dat ongeveer vijftig dode lichamen uit het puin waren gehaald, en dat ongeveer tweehonderd mensen gewond raakten, van wie velen ernstig. Maar dat was pas de eerste dag. De bewoners van het kamp waren vijf dagen bezig met het uittrekken van de doden en gewonden, zei hij.

Nael Al-Bahisi, een paramedicus, was een van de eersten ter plaatse. Hij telde op die eerste dag tussen de 50 en 70 slachtoffers. ŌĆ£Op een gegeven moment begrepen we dat het doelwit van de aanval Hamas-commandant Ayman Nofal wasŌĆØ, vertelde hij aan Indignatie en Local Call. ‘Ze hebben hem vermoord, en ook veel mensen die niet wisten dat hij daar was. Hele gezinnen met kinderen werden vermoord.ŌĆØ

Een andere inlichtingenbron vertelde aan Indignatie en Local Call dat het leger half december┬Āeen hoogbouwgebouw in Rafah verwoestte , waarbij ŌĆśtientallen burgersŌĆÖ omkwamen, in┬Āeen poging┬ĀMohammed Shabaneh, de commandant van de Rafah Brigade van Hamas, te vermoorden. Het is niet duidelijk of hij bij de aanval om het leven kwam). Vaak, zo zei de bron, verstoppen de oppercommandanten zich in tunnels die onder civiele gebouwen door lopen, en daarom doodt de keuze om hen met een luchtaanval te vermoorden noodzakelijkerwijs burgers.

ŌĆ£De meeste gewonden waren kinderenŌĆØ, zei Wael Al-Sir, 55, die getuige was van de grootschalige staking waarvan sommige Gazanen dachten dat het een moordaanslag was. Hij vertelde Indignatie en Local Call dat het bombardement op 20 december een ŌĆ£volledig woonblokŌĆØ verwoestte en minstens tien kinderen doodde.

ŌĆ£Er was een volledig tolerant beleid met betrekking tot de slachtoffers van [bombardementen] operaties ŌĆō zo tolerant dat er naar mijn mening een element van wraak in zatŌĆØ, beweerde D., een inlichtingenbron. ŌĆ£De kern hiervan waren de moorden op hoge [Hamas- en PIJ-commandanten] voor wie ze bereid waren honderden burgers te doden. We hadden een berekening: hoeveel voor een brigadecommandant, hoeveel voor een bataljonscommandant, enzovoort.ŌĆØ

ŌĆ£Er waren regels, maar die waren gewoon heel soepelŌĆØ, zegt E., een andere inlichtingenbron. ŌĆ£We hebben mensen gedood met bijkomende schade in de hoge dubbele cijfers, zo niet in de lage drievoudige cijfers. Dit zijn dingen die nog niet eerder zijn gebeurd.ŌĆØ

ZoŌĆÖn hoog percentage ŌĆśbijkomende schadeŌĆÖ is uitzonderlijk, niet alleen vergeleken met wat het Isra├½lische leger voorheen acceptabel achtte, maar ook vergeleken met de oorlogen die de Verenigde Staten voerden in Irak, Syri├½ en Afghanistan.┬Ā

Generaal Peter Gersten,┬Āplaatsvervangend commandant voor Operaties en Inlichtingen┬Āin de operatie ter bestrijding van ISIS in Irak en Syri├½,┬Āvertelde┬Āin 2021 aan een Amerikaans defensiemagazine dat een aanval met bijkomende schade aan 15 burgers afweek van de procedure; Om dit uit te voeren had hij speciale toestemming nodig van het hoofd van het Amerikaanse Centrale Commando, generaal Lloyd Austin, die nu minister van Defensie is.┬Ā

ŌĆ£Met Osama Bin Laden zou je een NCV [Non-combatant Casualty Value] van 30 hebben, maar als je een commandant op laag niveau had, was zijn NCV doorgaans nulŌĆØ, zei Gersten. ŌĆ£We hebben het langst op nul gereden.ŌĆØ

‘Er werd ons verteld: ‘Wat je ook kunt, bombardeer”

Alle voor dit onderzoek ge├»nterviewde bronnen zeiden dat de bloedbaden van Hamas op 7 oktober en de ontvoering van gijzelaars een grote invloed hadden op het vuurbeleid van het leger en de mate van bijkomende schade. ŌĆ£In eerste instantie was de sfeer pijnlijk en wraakzuchtigŌĆØ, zegt B., die direct na 7 oktober werd opgeroepen voor het leger en diende in een doeloperatiekamer. ŌĆ£De regels waren heel soepel. Ze haalden vier gebouwen neer toen ze wisten dat het doelwit zich in ├®├®n ervan bevond. Het was gek.

ŌĆ£Er was sprake van dissonantie: aan de ene kant waren de mensen hier gefrustreerd omdat we niet genoeg aanvielenŌĆØ, vervolgde B.. ŌĆ£Aan de andere kant zie je uiteindelijk dat nog eens duizend Gazanen zijn omgekomen, de meesten van hen burgers.ŌĆØ

ŌĆ£Er heerste hysterie in de professionele gelederenŌĆØ, aldus D., die ook direct na 7 oktober werd opgeroepen. ŌĆ£Ze hadden totaal geen idee hoe ze moesten reageren. Het enige wat ze wisten te doen was gewoon als gekken beginnen met bombarderen in een poging de capaciteiten van Hamas te ontmantelen.ŌĆØ

D. benadrukte dat hen niet expliciet werd verteld dat het doel van het leger ŌĆ£wraakŌĆØ was, maar zei dat ŌĆ£zodra elk doelwit dat verband houdt met Hamas legitiem wordt, en met vrijwel elke bijkomende schade die wordt goedgekeurd, het u duidelijk is dat duizenden mensen zullen worden vermoord. Zelfs als officieel elk doelwit verbonden is met Hamas, verliest het beleid elke betekenis als het zo tolerant is.ŌĆØ

A. gebruikte ook het woord ŌĆśwraakŌĆÖ om de sfeer binnen het leger na 7 oktober te beschrijven. ŌĆśNiemand dacht na over wat ze daarna moesten doen, als de oorlog voorbij is, of hoe het mogelijk zal zijn om in Gaza te leven en wat ze zullen doen. doe er maar meeŌĆØ, zei A.. ŌĆ£Ons werd verteld: nu moeten we Hamas verpesten, koste wat het kost. Wat je ook kunt, je bombardeert.ŌĆÖ

B., de senior inlichtingenbron, zei dat hij achteraf gezien gelooft dat dit ŌĆ£disproportioneleŌĆØ beleid van het doden van Palestijnen in Gaza ook de Isra├½li├½rs in gevaar brengt, en dat dit een van de redenen was waarom hij besloot ge├»nterviewd te worden.

ŌĆ£Op de korte termijn zijn we veiliger, omdat we Hamas pijn doen. Maar ik denk dat we op de lange termijn minder veilig zijn. Ik zie hoe alle nabestaanden in Gaza ŌĆō en dat is bijna iedereen ŌĆō de motivatie voor [mensen om zich bij] Hamas aan te sluiten, tien jaar later zullen vergroten. En het zal voor [Hamas] veel gemakkelijker zijn om ze te rekruteren.ŌĆØ

In een verklaring aan Indignatie en Local Call ontkende het Isra├½lische leger veel van wat de bronnen ons vertelden, en beweerde dat ŌĆ£elk doelwit afzonderlijk wordt onderzocht, terwijl een individuele beoordeling wordt gemaakt van het militaire voordeel en de bijkomende schade die van de aanval wordt verwacht ŌĆ” IDF voert geen aanvallen uit wanneer de bijkomende schade die van de aanval wordt verwacht buitensporig is in verhouding tot het militaire voordeel.ŌĆØ

STAP 5: BIJKOMENDE SCHADE BEREKENEN

‘Het model sloot niet aan bij de werkelijkheid’

Volgens de inlichtingenbronnen werd de berekening door het Isra├½lische leger van het aantal burgers dat naar verwachting in elk huis naast een doelwit zou worden gedood ŌĆō een procedure die in een┬Āeerder onderzoek door Indignatie en Local Call werd onderzocht ŌĆō uitgevoerd met behulp van automatische en onnauwkeurige hulpmiddelen. .

In eerdere oorlogen besteedde inlichtingenpersoneel veel tijd aan het verifi├½ren hoeveel mensen zich in een huis bevonden dat gebombardeerd zou worden, waarbij het aantal burgers dat waarschijnlijk gedood zou worden, werd vermeld als onderdeel van een ŌĆśdoeldossierŌĆÖ. Na 7 oktober werd deze grondige verificatie echter grotendeels verlaten ten gunste van automatisering.┬Ā

In oktober berichtte┬ĀThe New York Times┬Āover een systeem dat wordt beheerd vanuit een speciale basis in het zuiden van Isra├½l, dat informatie verzamelt van mobiele telefoons in de Gazastrook en het leger een live schatting geeft van het aantal Palestijnen dat de noordelijke Gazastrook naar het zuiden is ontvlucht.┬Ā

Generaal Udi Ben Muha vertelde de Times: ŌĆ£Het is geen 100 procent perfect systeem ŌĆō maar het geeft je de informatie die je nodig hebt om een ŌĆŗŌĆŗbeslissing te nemen.ŌĆØ Het systeem werkt op basis van kleuren: rood gemarkeerde gebieden waar veel mensen zijn, en groen en geel gemarkeerde gebieden die relatief vrij zijn van bewoners.

De bronnen die met Indignatie en Local Call spraken, beschreven een soortgelijk systeem voor het berekenen van bijkomende schade, dat werd gebruikt om te beslissen of een gebouw in Gaza zou worden gebombardeerd. Ze zeiden dat de software het aantal burgers berekende dat v├│├│r de oorlog in elk huis woonde ŌĆō door de grootte van het gebouw te beoordelen en de lijst met bewoners te bekijken ŌĆō en dat aantal vervolgens te verminderen met het aantal bewoners dat zogenaamd de buurt had ge├½vacueerd.┬Ā

Ter illustratie: als het leger schatte dat de helft van de bewoners van een wijk was vertrokken, zou het programma een huis dat gewoonlijk uit tien bewoners bestond, tellen als een huis met vijf bewoners. Om tijd te besparen, zeggen de bronnen, heeft het leger de huizen niet in de gaten gehouden om te controleren hoeveel mensen daar daadwerkelijk woonden, zoals bij eerdere operaties, om erachter te komen of de schatting van het programma inderdaad juist was.

ŌĆ£Dit model was niet verbonden met de werkelijkheidŌĆØ, beweerde een bron. ŌĆ£Er was geen verband tussen degenen die nu, tijdens de oorlog, in het huis waren, en degenen die daar v├│├│r de oorlog woonden. [Bij ├®├®n gelegenheid] hebben we een huis gebombardeerd zonder te weten dat er meerdere gezinnen in zaten, die zich samen verborgen hielden.ŌĆØ

De bron zei dat hoewel het leger wist dat dergelijke fouten konden optreden, dit onnauwkeurige model toch werd aangenomen, omdat het sneller was. Als zodanig, zo zei de bron, ŌĆ£was de berekening van de bijkomende schade volledig automatisch en statistischŌĆØ ŌĆō en leverde het zelfs cijfers op die geen hele getallen waren.

STAP 6: EEN GEZINSHUIS BOMBARDEREN

‘Je hebt een gezin zonder reden vermoord’

De bronnen die met Indignatie en Local Call spraken, legden uit dat er soms een aanzienlijke kloof zat tussen het moment waarop trackingsystemen als Where’s Daddy? waarschuwde een officier dat een doelwit hun huis was binnengedrongen, en het bombardement zelf ŌĆō wat leidde tot de dood van hele gezinnen, zelfs zonder het doelwit van het leger te raken. “Het is mij vaak overkomen dat we een huis aanvielen, maar de persoon was niet eens thuis”, zei een bron. ŌĆśHet resultaat is dat je zonder reden een gezin hebt vermoord.ŌĆÖ

Drie inlichtingenbronnen vertelden Indignatie en Local Call dat ze getuige waren geweest van een incident waarbij het Isra├½lische leger de priv├®woning van een gezin bombardeerde. Later bleek dat het beoogde doelwit van de moord niet eens in het huis was, aangezien er geen verdere verificatie plaatsvond. in realtime uitgevoerd.

“Soms was [het doelwit] eerder thuis, en dan ging hij ’s nachts ergens anders slapen, bijvoorbeeld ondergronds, en jij wist er niets van”, zei een van de bronnen. “Er zijn momenten waarop je de locatie nog eens controleert, en er zijn momenten waarop je gewoon zegt: ‘Ok├®, hij was de afgelopen uren in huis, dus je kunt gewoon bombarderen.'”

Een andere bron beschreef een soortgelijk incident dat hem trof en hem ertoe aanzette voor dit onderzoek ge├»nterviewd te worden. ŌĆ£We begrepen dat het doelwit om 20.00 uur thuis was. Uiteindelijk bombardeerde de luchtmacht het huis om 3.00 uur. Toen kwamen we erachter dat hij erin was geslaagd om met zijn gezin naar een ander huis te verhuizen. Er waren nog twee andere gezinnen met kinderen in het gebouw dat we bombardeerden.ŌĆØ

In eerdere oorlogen in Gaza voerde de Isra├½lische inlichtingendienst na de moord op menselijke doelwitten BDA-procedures (bom damage assessment) uit ŌĆō een routinematige controle na de aanval om te zien of de hogere commandant werd gedood en hoeveel burgers samen met hem werden gedood. Zoals uit een┬Āeerder onderzoek┬Ābleek , ging het hierbij om het afluisteren van telefoontjes van familieleden die hun dierbaren verloren.

In de huidige oorlog echter, in ieder geval met betrekking tot jonge militanten die gemarkeerd zijn met behulp van AI, zeggen bronnen dat deze procedure werd afgeschaft om tijd te besparen. De bronnen zeiden dat ze niet wisten hoeveel burgers daadwerkelijk werden gedood bij elke aanval, en van de laaggeplaatste vermoedelijke Hamas- en PIJ-agenten die door AI werden gemarkeerd, wisten ze niet eens of het doelwit zelf was gedood.

ŌĆ£Je weet niet precies hoeveel je hebt gedood en wie je hebt vermoordŌĆØ, vertelde een inlichtingenbron┬Āaan Local Call┬Āvoor een eerder onderzoek dat in januari werd gepubliceerd. ŌĆ£Alleen als het om hoge Hamas-agenten gaat, volg je de BDA-procedure. In de rest van de gevallen maakt het je niets uit. Je krijgt een rapport van de luchtmacht of het gebouw is opgeblazen, en dat is alles. Je hebt geen idee hoeveel bijkomende schade er was; je gaat meteen door naar het volgende doel. De nadruk lag op het cre├½ren van zoveel mogelijk doelen, zo snel mogelijk.ŌĆØ

Maar terwijl het Isra├½lische leger na elke aanval verder kan gaan zonder stil te staan ŌĆŗŌĆŗbij het aantal slachtoffers, zei Amjad Al-Sheikh, de inwoner van Shuja’iya die elf van zijn familieleden verloor bij het bombardement van 2 december, dat hij en zijn buren nog steeds op zoek naar lijken.

ŌĆ£Tot nu toe liggen er lichamen onder het puinŌĆØ, zei hij. ŌĆ£Veertien woongebouwen werden gebombardeerd met de bewoners erin. Sommige van mijn familieleden en buren liggen nog steeds begraven.ŌĆØ