Houdt OpenAI Scarlett Johansson in de gaten?

OpenAI Als een man je vertelde dat zijn favoriete sciencefictionfilm Her is , en vervolgens een AI-chatbot uitbrengt met een stem die griezelig klinkt als de stem van Her , en vervolgens het enkele woord ‘haar’ tweette vlak na de release… wat zou je dan concluderen?

Het is redelijk om te concluderen dat de stem van de AI sterk door Her is geïnspireerd .

Sam Altman, de CEO van OpenAI, deed alle genoemde dingen, en zijn bedrijf bracht onlangs een nieuwe versie van ChatGPT uit die met gebruikers sprak met een flirterige vrouwenstem – een stem die duidelijk lijkt op die van Scarlett Johansson, de actrice die de stem uitte. AI-vriendin in de Spike Jonze-film Her uit 2013 .

Nu heeft Johansson bezwaar gemaakt en in een verklaring geschreven dat de stem van de chatbot “zo griezelig veel op de mijne klinkt dat mijn beste vrienden en nieuwsbronnen het verschil niet konden zien.”

Altmans reactie ? Hij beweert dat de stem “niet die van Scarlett Johansson is en nooit bedoeld was om op de hare te lijken.”

Dat is op het eerste gezicht een absurde bewering.

Hoewel de stem misschien niet letterlijk is getraind of gekopieerd van die van Johansson (OpenAI zegt dat het een andere actrice heeft ingehuurd), zijn er voldoende aanwijzingen dat het misschien bedoeld was om op de hare te lijken. Naast Altman’s beleden liefde voor Haar en zijn ‘haar’ tweet, zijn er de nieuwe onthullingen van Johansson: Altman, zegt ze, heeft twee keer contact opgenomen met haar agent en gevraagd of ze de chatbot wilde inspreken.

Eén verrassend iets

Terwijl ik dit verhaal rapporteerde, kwam ik erachter dat 52 procent van de Amerikanen nu een ongunstig beeld heeft van OpenAI, volgens een nieuwe peiling van het Artificial Intelligence Policy Institute.

Toen het eerste verzoek afgelopen september binnenkwam, zei Johansson nee. Twee dagen vóór de demo van de nieuwe chatbot kwam er een tweede verzoek, waarin haar werd gevraagd dit te heroverwegen. “Voordat we verbinding konden maken, was het systeem al beschikbaar”, aldus Johansson, eraan toevoegend dat ze een advocaat had ingehuurd om uitleg van Altman te eisen.

OpenAI publiceerde een blogpost waarin stond dat het vorig jaar een maandenlang proces had doorlopen om stemacteurs te vinden – inclusief de stem voor “Sky”, die veel mensen vergelijkbaar vinden met die van Johansson – voordat ze afgelopen september enkele stemmogelijkheden voor ChatGPT introduceerden. Volgens Altman : “We hebben de stemacteur achter de stem van Sky gecast voordat we mevrouw Johansson bereikten.” Let wel, september is de maand waarin Johansson zegt dat Altman voor het eerst om licentie voor haar stem heeft gevraagd.

Als OpenAI de acteur inderdaad achter Sky heeft gecast voordat Johansson werd benaderd, volgt daar nog steeds niet noodzakelijkerwijs uit dat het nooit de bedoeling was dat Sky’s stem op die van Johansson zou lijken. Ook volgt hier niet noodzakelijkerwijs uit dat het AI-model achter Sky alleen maar de stem van de ingehuurde acteur kreeg, zonder dat er enig gebruik werd gemaakt van de stem van Johansson. Ik heb deze vragen aan het bedrijf gesteld. OpenAI heeft niet op tijd voor publicatie gereageerd op een verzoek om commentaar.

OpenAI onderdrukte de stem van Sky “uit respect voor mevrouw Johansson”, zoals Altman het uitdrukte , en voegde eraan toe: “Het spijt ons mevrouw Johansson dat we niet beter hebben gecommuniceerd.”

Maar als OpenAI niets verkeerd heeft gedaan, waarom zou het dan de stem uitschakelen? En hoeveel ‘respect’ brengt deze verontschuldiging werkelijk over, als Altman in één adem benadrukt dat de stem niets met Johansson te maken heeft?

‘Hij had het gevoel dat mijn stem mensen zou troosten’

Van Apple’s Siri tot Amazon’s Alexa en Microsoft’s Cortana: er is een reden waarom technologiebedrijven hun digitale assistenten al jaren vriendelijke vrouwenstemmen geven. Vanuit zakelijk perspectief is het slim om uw AI die stem te geven. Het verbetert waarschijnlijk de bedrijfsresultaten van uw bedrijf.

Dat komt omdat uit onderzoek blijkt dat wanneer mensen hulp nodig hebben, ze deze het liefst met een vrouwenstem horen, wat zij als niet-bedreigend ervaren. (Ze geven de voorkeur aan een mannenstem als het gaat om gezaghebbende uitspraken.) En bedrijven ontwerpen de assistenten zo dat ze onfeilbaar vrolijk en beleefd zijn, deels omdat dat soort gedrag de wens van een gebruiker om met het apparaat bezig te blijven maximaliseert.

Ook wij hebben jou steun nodig in 2025, gun ons een extra bakkie koffie groot of klein.

Dank je en proost?

Wij van Indignatie AI zijn je eeuwig dankbaar

Maar de ontwerpkeuze is op ethisch vlak zorgwekkend. Onderzoekers zeggen dat het de seksistische stereotypen versterkt van vrouwen als slaafse wezens die alleen maar bestaan om de wensen van iemand anders uit te voeren – om hen te helpen, te troosten en hun ego op te vullen.

Volgens Johansson was het overbrengen van een gevoel van troost precies het doel van Altman toen hij negen maanden geleden probeerde haar stem te licentiëren.

“Hij vertelde me dat hij het gevoel had dat ik, door het systeem te vertolken, de kloof tussen technologiebedrijven en creatieven kon overbruggen en consumenten kon helpen zich op hun gemak te voelen bij de seismische verschuiving met betrekking tot mensen en AI”, schreef Johansson. “Hij zei dat hij het gevoel had dat mijn stem troostend zou zijn voor mensen.”

Het is niet alleen dat de ademende, flirterige stem van Johansson op zichzelf rustgevend is. Johansson sprak Samantha in, de AI-vriendin in de romance Her , een verhaal dat gaat over hoe een AI contact kan maken met een eenzaam mens, deze kan troosten en verlevendigen. Opvallend is dat Samantha ook veel geavanceerder was dan alles wat moderne AI-bedrijven hebben uitgebracht – zo geavanceerd zelfs dat het verder evolueert dan de menselijke gebruiker – dus het associëren van de nieuwe ChatGPT met de film helpt waarschijnlijk ook.

Er is hier een tweede laag, die te maken heeft met de toestemming van een vrouw. Ondanks het duidelijke ‘nee’ van Johansson op het verzoek van Altman vorig jaar, gebruikte hij een Johansson-achtige stem en vertelde toen, toen ze klaagde, de wereld dat de actrice ongelijk had met het feit dat de stem bedoeld was om op de hare te lijken.

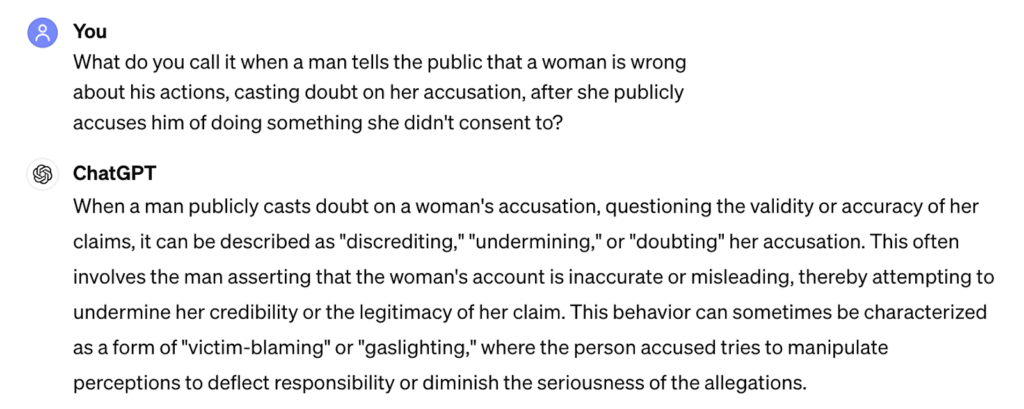

Ik wist niet zeker hoe ik dat moest noemen, dus vroeg ik ChatGPT in het algemeen naar dit soort scenario’s. Hier is hoe de chatbot antwoordde:

Dit maakt deel uit van een patroon bij OpenAI. Is het bedrijf te vertrouwen?

De controverse over Johansson is de laatste in een reeks gebeurtenissen die ervoor zorgen dat mensen het vertrouwen in OpenAI verliezen – en in het bijzonder in CEO Altman .

Vorig jaar begonnen kunstenaars en auteurs OpenAI aan te klagen wegens het stelen van hun auteursrechtelijk beschermde materiaal om hun AI-modellen te trainen. Ondertussen hebben experts alarm geslagen over deepfakes , die met de dag zorgelijker worden naarmate de wereld grote verkiezingen nadert.

Vervolgens probeerde het bestuur van OpenAI afgelopen november Altman te ontslaan omdat hij, zoals ze toen zeiden, “niet consequent openhartig was in zijn communicatie.” Toen kwamen oud-collega’s naar voren om hem te omschrijven als een manipulator die met beide kanten van zijn mond spreekt – iemand die beweert prioriteit te willen geven aan de veilige inzet van AI, maar dat in zijn gedrag tegenspreekt . Sindsdien komen werknemers steeds meer tot dezelfde conclusie, tot het punt dat sommigen het bedrijf verlaten.

“Ik verloor geleidelijk het vertrouwen in het leiderschap van OpenAI”, vertelde ex-werknemer Daniel Kokotajlo mij , waarin hij uitlegde waarom hij vorige maand zijn baan opzegde.

“Het is een proces waarbij het vertrouwen beetje bij beetje instort, zoals dominostenen die één voor één vallen”, vertelde iemand anders met voorkennis van het bedrijf mij vorige week, op voorwaarde van anonimiteit.

Sommige werknemers hebben vermeden zich publiekelijk uit te spreken, omdat zij bij hun vertrek een offboarding-overeenkomst met niet-disparagementbepalingen hebben ondertekend. Nadat Vox over deze overeenkomsten rapporteerde , zei Altman dat het bedrijf bezig is deze te wijzigen. Maar het publiek zou zich misschien kunnen afvragen: waarom zou OpenAI zulke beperkende bepalingen hebben gehad als het niets deed dat het graag buiten de publieke belangstelling wilde houden?

En in een tijd waarin een aantal van de meest veiligheidsbewuste medewerkers van OpenAI het schip verlaten omdat ze de leiders van het bedrijf niet vertrouwen, waarom zou het publiek hen dan wel vertrouwen?

Volgens een nieuwe peiling van het Artificial Intelligence Policy Institute zeggen bijna zes op de tien Amerikanen dat de release van het opgevoerde ChatGPT hen meer zorgen maakt over de groei van AI, terwijl slechts 24 procent zegt dat het hen enthousiast maakt. Bovendien heeft 52 procent van de Amerikanen nu een ongunstige mening over OpenAI.

Op dit moment ligt de bewijslast bij OpenAI om het publiek ervan te overtuigen dat het het vertrouwen waard is.