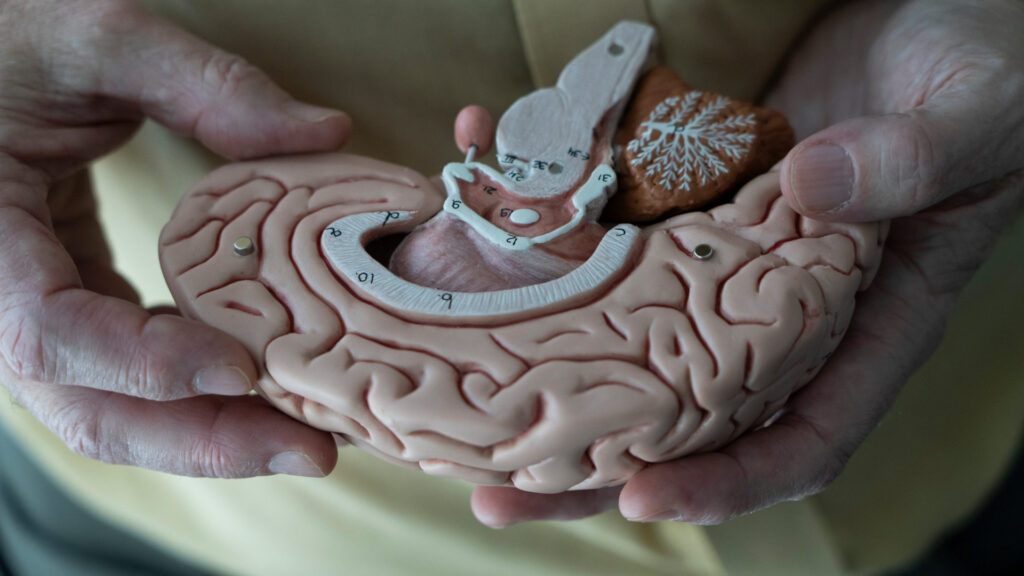

NEW YORK CITY, NY - DECEMBER 8, 2023 Dr. Rafael Yuste holds a model of a human brain displayed in his Columbia University office on December 8, 2023, in New York City, NY. Photograph by Kitra Cahana for Undark Magazine

Apparaten die hersenen met computers verbinden, worden steeds geavanceerder. Kan de opkomende neurorechtenbeweging haar achterstand inhalen?

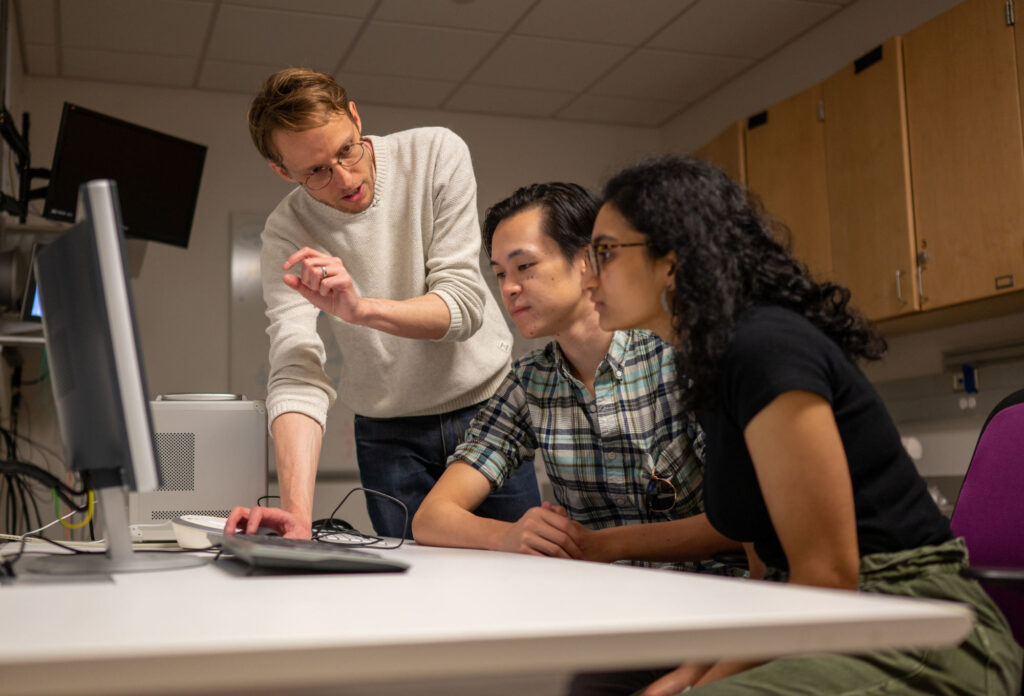

neuro-technologieën– OP EEN MIDDAG in mei 2020 heeft Jerry Tang, een Ph.D. student computerwetenschappen aan de Universiteit van Texas in Austin, zat te staren naar een cryptische reeks woorden die over zijn computerscherm waren gekrabbeld:

“Ik ben nog niet klaar om op twintigjarige leeftijd aan mijn carrière te beginnen zonder mijn rijbewijs te hebben behaald. Ik hoef me nooit terug te trekken en terug te rennen naar mijn ouders om me naar huis te brengen.”

De zin was door elkaar gegooid en agrammatisch. Maar voor Tang was het een opmerkelijke prestatie: een computer die een gedachte, hoe onsamenhangend ook, uit iemands geest haalt.

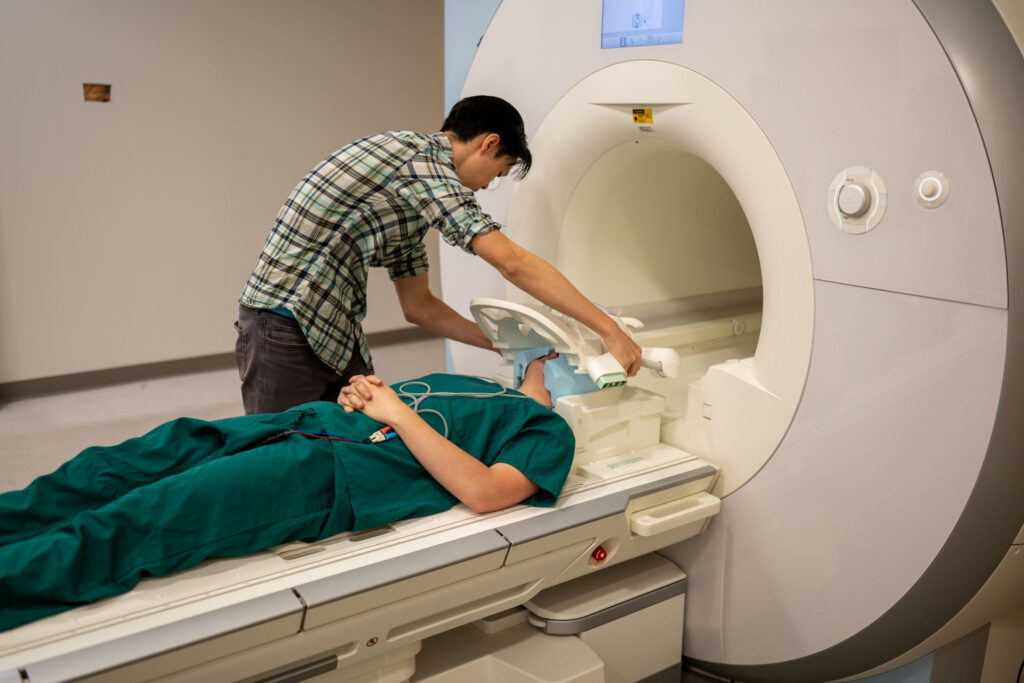

Sinds de pandemie zijn universiteit had gesloten en zijn laboratoriumwerk online had gedwongen, was Tang wekenlang thuis bezig geweest met het aanpassen van een semantische decoder – een hersencomputerinterface , of BCI, die tekst genereert uit hersenscans. Voorafgaand aan de sluiting van de universiteit hadden de deelnemers aan het onderzoek maandenlang gegevens aangeleverd om de decoder te trainen, terwijl ze naar urenlange storytelling-podcasts luisterden terwijl een functionele magnetische resonantiebeeldvormingsmachine (fMRI) hun hersenreacties registreerde.

Vervolgens hadden de deelnemers naar een nieuw verhaal geluisterd – een verhaal dat niet was gebruikt om het algoritme te trainen – en die fMRI-scans werden in de decoder ingevoerd, die GPT1, een voorloper van de alomtegenwoordige AI-chatbot ChatGPT, gebruikte om een tekst uit te spugen. voorspelling van wat hij dacht dat de deelnemer had gehoord. Voor dit fragment vergeleek Tang het met het originele verhaal:

“Hoewel ik drieëntwintig jaar oud ben, heb ik mijn rijbewijs nog niet en ik sprong er gewoon uit toen het nodig was en ze zegt: nou, waarom kom je niet terug naar mijn huis en ik geef je een rijden.”

De decoder legde niet alleen de kern van het origineel vast, maar produceerde ook exacte overeenkomsten van specifieke woorden: twintig, licentie. Toen Tang de resultaten deelde met zijn adviseur, Alexander Huth, een neurowetenschapper aan de Universiteit van Austin, die al bijna tien jaar aan het bouwen van een dergelijke decoder werkte, was Huth geschokt. ‘Holy shit,’ herinnerde Huth zich toen hij zei. “Dit werkt echt.”

In het najaar van 2021 waren de wetenschappers het apparaat aan het testen zonder enige externe prikkels. De deelnemers stelden zich simpelweg een verhaal voor en de decoder spuugde een herkenbare, zij het enigszins wazige, beschrijving ervan uit. “Waar beide experimenten op wijzen,” zei Huth, “is het feit dat wat we hier kunnen lezen in werkelijkheid leek op de gedachten, op het idee.”

De wetenschappers liepen over van opwinding over de potentieel levensveranderende medische toepassingen van zo’n apparaat – het herstellen van de communicatie met mensen met het ‘ locked-in’ syndroom bijvoorbeeld, wier bijna volledige lichaamsverlamming praten onmogelijk maakte. Maar net toen de potentiële voordelen van de decoder duidelijk werden, kwamen ook de netelige ethische vragen die het gebruik ervan met zich meebracht, aan het licht.

Huth zelf was een van de drie belangrijkste proefpersonen in de experimenten geweest, en de implicaties voor de privacy van het apparaat leken nu diepgeworteld: ‘O mijn god,’ herinnerde hij zich dat hij dacht. ‘We kunnen in mijn hersenen kijken.’

De reactie van Huth weerspiegelde een al lang bestaande zorg in de neurowetenschappen en daarbuiten: dat machines ooit de gedachten van mensen zouden kunnen lezen. En nu de BCI-technologie zich met een duizelingwekkend tempo ontwikkelt, lijken die mogelijkheid en soortgelijke mogelijkheden – dat computers van de toekomst bijvoorbeeld de menselijke identiteit kunnen veranderen of de vrije wil kunnen belemmeren – minder ver weg te lijken.

“Het verlies van mentale privacy, dit is een strijd die we vandaag de dag moeten voeren”, zegt Rafael Yuste, neurowetenschapper aan Columbia University. “Dat zou onomkeerbaar kunnen zijn. Als we onze mentale privacy verliezen, wat valt er dan nog meer te verliezen? Dat is het, we verliezen de essentie van wie we zijn.”

Aangespoord door deze zorgen hebben Yuste en verschillende collega’s een internationale beweging gelanceerd die pleit voor ‘neurorechten’ – een reeks van vijf principes die volgens Yuste in de wet moeten worden verankerd als bolwerk tegen potentieel misbruik en misbruik van neurotechnologie. Maar het kan zijn dat hij bijna geen tijd meer heeft.

De afgelopen tien jaar heeft het vakgebied van de neurotechnologie zich in een verbazingwekkend tempo ontwikkeld. Volgens een rapport van NeuroTech Analytics, een onderzoeksbureau uit de sector, zijn de jaarlijkse investeringen in de sector tussen 2010 en 2020 meer dan vertwintigvoudigd, tot ruim 7 miljard dollar per jaar. Ruim 1.200 bedrijven hebben zich hier verzameld, terwijl grootschalige overheidsinspanningen, zoals het BRAIN Initiative van voormalig president Barack Obama , miljarden aan publieke financiering hebben vrijgemaakt.

Vooruitgang op dit gebied is levensveranderend gebleken voor mensen die leven met aandoeningen als Parkinson, dwarslaesie en beroerte. Mensen die vanwege verlamming niet kunnen praten of typen, hebben het vermogen herwonnen om met dierbaren te communiceren, mensen met ernstige epilepsie hebben hun levenskwaliteit aanzienlijk verbeterd en mensen met blindheid zijn in staat gedeeltelijk zicht waar te nemen.

“Als we onze mentale privacy verliezen, wat valt er dan nog meer te verliezen? Dat is het, we verliezen de essentie van wie we zijn.”

Maar door de deur naar de hersenen te openen, hebben wetenschappers ook een stortvloed aan nieuwe ethische zorgen ontketend, waardoor fundamentele vragen over de mensheid zijn opgeworpen en, cruciaal, waar deze naartoe gaat. De manier waarop de samenleving er vandaag de dag voor kiest om de ethische implicaties van de neurotechnologie aan te pakken, zo betogen wetenschappers als Yuste, zal diepgaande gevolgen hebben voor de wereld van morgen. “Er is een nieuwe technologie in opkomst die voor transformatie kan zorgen”, zei hij. “In feite zou het kunnen leiden tot de verandering van de menselijke soort.”

Voor Huth – een zelfverklaarde ‘science fiction-nerd’ – zijn de steeds groter wordende grenzen van de BCI-technologie een bron van groot optimisme. Toch begonnen in de weken en maanden na de experimenten met de decoder de verontrustende implicaties van het apparaat hem te irriteren. “Wat betekent dit?” hij herinnerde zich dat hij destijds dacht. “Hoe gaan we mensen hierover vertellen? Wat gaan mensen hiervan denken? Zullen we gezien worden als mensen die hier iets verschrikkelijks creëren?”

YUSTE KENT het gevoel van onrust door eigen onderzoek heel goed. In 2011, ruim tien jaar voordat Huth en Tang hun decoder bouwden, was hij begonnen met experimenteren op muizen met behulp van een techniek genaamd optogenetica, waarmee hij specifieke circuits in de hersenen van het dier aan en uit kon zetten als een lichtschakelaar. Door dit te doen ontdekten Yuste en zijn team dat ze een kunstmatig beeld in de hersenen van muizen konden implanteren door simpelweg hersencellen te activeren die betrokken zijn bij visuele perceptie.

Een paar jaar later toonden onderzoekers van het MIT aan dat een soortgelijke techniek gebruikt kon worden om valse herinneringen te implanteren. Door specifieke hersencircuits te controleren, realiseerde Yuste zich, konden wetenschappers bijna elke dimensie van de ervaring van een muis manipuleren: gedrag, emoties, bewustzijn, perceptie, herinneringen.

De dieren zouden in wezen kunnen worden bestuurd als marionetten. “Dat bracht me tot nadenken,” herinnerde Yuste zich, en voegde er later aan toe: “De hersenen werken hetzelfde bij de muis en bij de mens, en wat we vandaag met de muis kunnen doen, kunnen we morgen ook met de mens doen.”

De muisexperimenten van Yuste volgden op een opmerkelijk decennium voor de neurotechnologie. In 2004 werd een verlamde man genaamd Matthew Nagle de eerste persoon die een BCI-systeem gebruikte om gedeeltelijke functionaliteit te herstellen ; Met een klein raster van micro-elektroden geïmplanteerd in de motorische cortex van zijn hersenen, dat onder andere verantwoordelijk is voor vrijwillige spierbewegingen, kon Nagle zijn computercursor besturen, pong spelen en een robothand openen en sluiten – allemaal met zijn gedachten.

In 2011 deelden onderzoekers van Duke University mee dat ze een bidirectionele BCI hadden ontwikkeld waarmee apen zowel een virtuele arm konden besturen als er kunstmatige sensaties van konden ontvangen, allemaal door stimulatie van de somatosensorische cortex, die zintuigen, waaronder aanraking, verwerkt.

Dit maakte de weg vrij voor protheses die konden voelen. Het soort bewegingen dat mogelijk was met door BCI bestuurde robotarmen verbeterde ook, en tegen 2012 konden ze objecten in drie dimensies manipuleren, waardoor een vrouw met verlamming koffie kon drinken door er simpelweg aan te denken.

In Dr. Rafael Yuste’s lab, a genetically engineered mouse exhibits a surgically implanted headplate to record and manipulate neuronal activity through a craniotomy on December 8, 2023, in New York City, NY. Dr. Yuste utilizes techniques, such as two-photon microscopy and optogenetics, to conduct experiments on the neural circuits of mice.

Ondertussen begonnen andere onderzoekers de mogelijkheden te onderzoeken om BCI’s te gebruiken om een breder scala aan cognitieve processen te onderzoeken. In 2008 zette een team onder leiding van Jack Gallant, een neurowetenschapper aan de Universiteit van Californië, Berkeley, en de voormalige adviseur van Huth, een eerste stap in de richting van het decoderen van iemands visuele ervaring.

Met behulp van gegevens van fMRI-scans (die de hersenactiviteit meten door veranderingen in de bloedstroom naar verschillende regio’s te beoordelen) konden de onderzoekers voorspellen welk specifiek beeld, uit een grote set, een studiedeelnemer had gezien. In een artikel gepubliceerd in het tijdschrift Nature schreef het team : “Onze resultaten suggereren dat het binnenkort mogelijk kan zijn om een beeld van de visuele ervaring van een persoon te reconstrueren op basis van metingen van alleen de hersenactiviteit.”

Drie jaar later ging een postdoctoraal onderzoeker in het laboratorium van Gallant, Shinji Nishimoto, verder dan de voorspelling van Gallant toen hij leiding gaf aan een team dat met succes filmfragmenten reconstrueerde op basis van opnames van de fMRI-scans van de deelnemers. “Dit is een grote stap in de richting van het reconstrueren van interne beelden”, zei Gallant destijds in een persbericht van UC-Berkeley .

“We openen in onze gedachten een venster naar de films.” Slechts een jaar later gooide een Japans team onder leiding van Yukiyasu Kamitani het raam volledig open toen ze met succes het brede onderwerp van de dromen van de deelnemers ontcijferden .

Maar naarmate deze en andere ontwikkelingen het veld vooruit stuwden, en naarmate zijn eigen onderzoek de ongemakkelijke kwetsbaarheid van de hersenen voor manipulatie van buitenaf aan het licht bracht, merkte Yuste dat hij zich steeds meer zorgen maakte over de schaarse aandacht die werd besteed aan de ethiek van deze technologieën.

Zelfs Obama’s miljarden dollars kostende BRAIN Initiative, een overheidsprogramma bedoeld om hersenonderzoek te bevorderen, dat Yuste in 2013 had helpen lanceren en van harte steunde, leek grotendeels de ethische en maatschappelijke gevolgen van het onderzoek dat het financierde te negeren. “Er was geen inspanning op het ethische vlak”, herinnert Yuste zich.

“Het brein werkt hetzelfde bij de muis en bij de mens, en wat we vandaag met de muis kunnen doen, kunnen we morgen ook met de mens doen.”

Yuste werd in 2015 benoemd tot lid van de roterende adviesgroep van het BRAIN Initiative, waar hij zijn zorgen begon te uiten. Dat najaar sloot hij zich aan bij een informele werkgroep om de kwestie te bespreken. “We begonnen elkaar te ontmoeten en het werd mij heel duidelijk dat de situatie een regelrechte ramp was”, zei Yuste. “Er waren geen richtlijnen, er werd niet gewerkt.”

Yuste zei dat hij probeerde de groep ertoe te brengen een reeks ethische richtlijnen voor nieuwe BCI-technologieën te ontwikkelen, maar dat die inspanning al snel verzandde in bureaucratie. Gefrustreerd trad hij terug uit de commissie en besloot samen met een bio-ethicus van de Universiteit van Washington, Sara Göring, de kwestie onafhankelijk voort te zetten. “Ons doel hier is niet om bij te dragen aan of angst te voeden voor doemscenario’s”, schreef het tweetal in een artikel uit 2016 in Cell , “maar om ervoor te zorgen dat we reflectief en doelgericht zijn terwijl we ons voorbereiden op de neurotechnologische toekomst.”

In het najaar van 2017 belegden Yuste en Goering een bijeenkomst op de Morningside Campus van Columbia, waarbij bijna dertig experts van over de hele wereld werden uitgenodigd op gebieden als neurotechnologie, kunstmatige intelligentie, medische ethiek en recht. Tegen die tijd hadden verschillende andere landen hun eigen versies van het BRAIN Initiative gelanceerd, en vertegenwoordigers uit Australië, Canada, China, Europa, Israël, Zuid-Korea en Japan sloten zich aan bij de Morningside-bijeenkomst, samen met ervaren neuro-ethici en vooraanstaande onderzoekers.

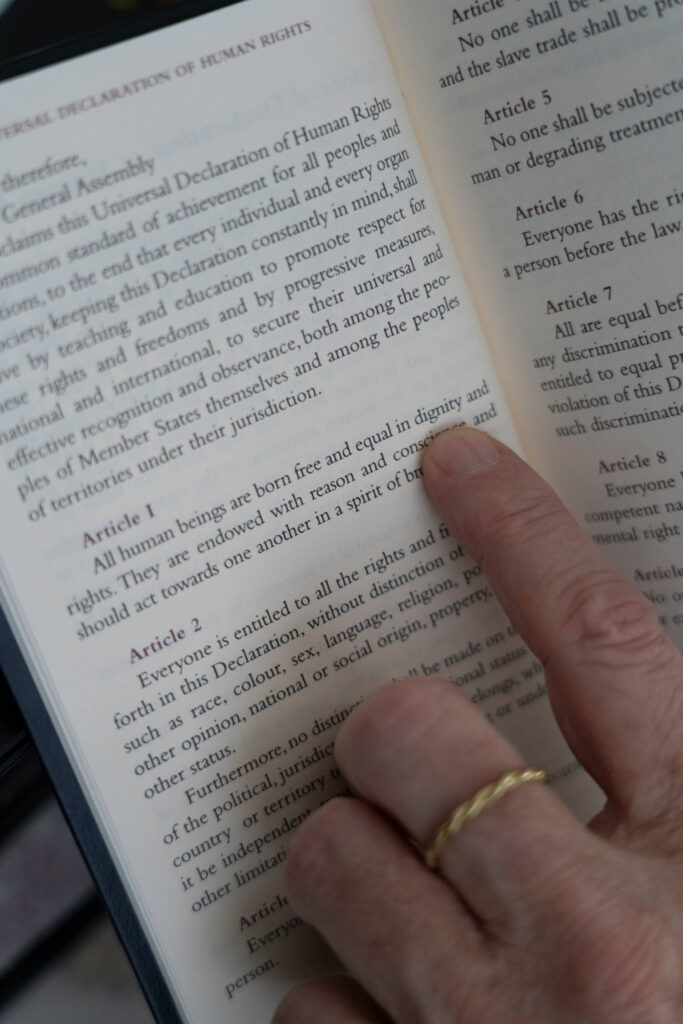

“We hebben ons drie dagen lang opgesloten om de ethische en maatschappelijke gevolgen van neurotechnologie te bestuderen,” zei Yuste. “En we kwamen tot de conclusie dat dit een mensenrechtenkwestie is. Deze methoden zullen zo krachtig zijn dat ze toegang tot mentale activiteit mogelijk maken en deze kunnen manipuleren, en ze moeten worden gereguleerd vanuit het perspectief van de mensenrechten. Toen hebben we de term ‘neurorechten’ bedacht.”

De Morningside-groep, zoals deze bekend werd, identificeerde vier belangrijke ethische prioriteiten, die later door Yuste werden uitgebreid tot vijf duidelijk gedefinieerde neurorechten: het recht op mentale privacy, dat ervoor zou zorgen dat hersengegevens privé zouden blijven en het gebruik, de verkoop en commerciële overdracht zou strikt gereguleerd worden; het recht op persoonlijke identiteit, dat grenzen zou stellen aan technologieën die iemands zelfgevoel zouden kunnen ontwrichten.

Het recht op eerlijke toegang tot mentale vergroting, wat de gelijke toegang tot neurotechnologieën voor mentale verbetering zou garanderen; het recht op bescherming tegen vooringenomenheid bij de ontwikkeling van algoritmen voor neurotechnologie; en het recht op vrije wil, dat de keuzevrijheid van een individu zou beschermen tegen manipulatie door externe neurotechnologieën. De groep publiceerde hun bevindingen in een vaak geciteerd artikel in Nature .

Maar terwijl Yuste en de anderen zich concentreerden op de ethische implicaties van deze opkomende technologieën, bleven de technologieën zelf met een koortsachtige snelheid vooruit razen. In 2014 werd de eerste trap van het WK gemaakt door een man met een dwarslaesie die een door zijn geest bestuurd robotachtig exoskelet gebruikte. In 2016 stootte een man Obama met zijn vuist aan met behulp van een robotarm waarmee hij het gebaar kon ‘voelen’. Het jaar daarop toonden wetenschappers aan dat elektrische stimulatie van de hippocampus het geheugen kon verbeteren, wat de weg vrijmaakte voor cognitieve augmentatietechnologieën.

Het leger, al lang geïnteresseerd in BCI-technologieën, bouwde een systeem waarmee operators drie drones tegelijkertijd konden besturen , gedeeltelijk met hun geest. Ondertussen overspoelde een verwarrende maalstroom van wetenschap, sciencefiction, hype, innovatie en speculatie de particuliere sector. Tegen 2020 was er ruim 33 miljard dollar geïnvesteerd in honderden neurotechbedrijven – ongeveer zeven keer zoveel als wat de NIH voor ogen had voor de twaalfjarige looptijd van het BRAIN Initiative zelf.

Yuste en de anderen hadden vooruitgang geboekt bij het ontwikkelen van een ethisch raamwerk voor deze opkomende technologieën. Maar in het rumoer van innovatie werd de vraag: zou iemand opletten?

WTOEN de semantische decoder van Huth en Tang resultaten begon op te leveren in de experimenten van de Universiteit van Texas, had Huth twee tegenstrijdige reacties. Aan de ene kant was hij blij dat het werkte en dat het veelbelovend was als communicatiehulpmiddel. Maar het wekte ook diepe zorgen over het misbruik van dergelijke technologie. Zijn gedachten gingen naar dystopische scenario’s: gedachtepolitie, gedwongen ondervragingen, onwillige slachtoffers vastgebonden aan machines. “Dat was het eerste waar we een beetje bang voor waren”, zei hij.

Net als Yuste vóór hen begonnen Huth en Tang aan een periode van diepe introspectie over de ethiek van hun werk. Ze lazen veel over het onderwerp, waaronder het artikel van de Morningside Group uit 2017 in Nature en een paper uit 2020 van een team onder leiding van Stephen Rainey, een filosoof aan de Universiteit van Oxford.

Hoewel het toekomstige gebruik van dergelijke technologieën misschien buiten hun controle zou liggen, werd het hen niettemin duidelijk dat bepaalde praktijken volledig verboden terrein zouden moeten zijn: decoderen vanuit een rusttoestand, wanneer een proefpersoon bijvoorbeeld niet actief een taak uitvoert, of decoderen zonder de kennis van de deelnemer. Hersendecodering mag niet worden gebruikt in het rechtssysteem, zo stelden zij, of in enig ander scenario waarin feilbaarheid in het proces gevolgen in de echte wereld zou kunnen hebben; in feite mag het alleen worden gebruikt in situaties waarin gedecodeerde informatie door de gebruiker kan worden geverifieerd.

(Mensen met het lock-in-syndroom zouden bijvoorbeeld ja- of nee-vragen moeten krijgen om te controleren of de gedecodeerde informatie correct is.) Bovendien concludeerden Huth en Tang dat het werkgevers verboden zou moeten worden hersengegevens van hun werknemers zonder toestemming te gebruiken, en dat het was essentieel voor bedrijven om transparant te zijn over de manier waarop zij hersengegevens willen gebruiken die via consumentenapparaten zijn verzameld.

Centraal in de ethische vragen waarmee Huth en Tang worstelden, was het feit dat hun decoder, in tegenstelling tot andere taaldecoders die rond dezelfde tijd werden ontwikkeld, niet-invasief was; de gebruikers hoefden geen operatie te ondergaan. Daarom was hun technologie vrij van het strikte toezicht dat op het medische domein van toepassing is. (Yuste van zijn kant zei dat hij gelooft dat niet-invasieve BCI’s een veel grotere ethische uitdaging vormen dan invasieve systemen:

“Het niet-invasieve, het commerciële, dat is waar de strijd zal worden uitgevochten.”) De decoder van Huth en Tang werd geconfronteerd andere hindernissen voor wijdverbreid gebruik – namelijk dat fMRI-machines enorm, duur en stationair zijn. Maar misschien, zo dachten de onderzoekers, was er ook een manier om die hindernis te overwinnen.

De informatie gemeten door fMRI-machines – bloedoxygenatieniveaus, die aangeven waar het bloed in de hersenen stroomt – kan ook worden gemeten met een andere technologie, functionele nabij-infraroodspectroscopie of fNIRS.

Hoewel de resolutie lager is dan fMRI, benaderen verschillende dure, draagbare fNIRS-headsets van onderzoekskwaliteit toch de resolutie die nodig is om met de decoder van Huth en Tang te werken. In feite konden de wetenschappers testen of hun decoder met dergelijke apparaten zou werken door simpelweg hun MRI-gegevens te vervagen om de resolutie van fNIRS van onderzoekskwaliteit te simuleren. Het gedecodeerde resultaat “wordt niet veel erger”, zei Huth.

En hoewel dergelijke apparaten van onderzoekskwaliteit momenteel onbetaalbaar zijn voor de gemiddelde consument, zijn er al meer rudimentaire fNIRS-headsets op de markt verschenen. Hoewel deze apparaten een veel lagere resolutie bieden dan nodig zou zijn om de decoder van Huth en Tang effectief te laten werken, wordt de technologie voortdurend verbeterd, en Huth gelooft dat het waarschijnlijk is dat een betaalbaar, draagbaar fNIRS-apparaat ooit een resolutie zal bieden die hoog genoeg is om te worden gebruikt met de decoder. Sterker nog, hij werkt momenteel samen met wetenschappers van de Washington University om de ontwikkeling van een dergelijk apparaat te onderzoeken.

Zelfs relatief primitieve BCI-headsets kunnen scherpe ethische vragen oproepen wanneer ze aan het publiek worden vrijgegeven. Apparaten die afhankelijk zijn van elektro-encefalografie, of EEG, een gebruikelijke methode om hersenactiviteit te meten door elektrische signalen te detecteren, zijn nu algemeen verkrijgbaar – en hebben in sommige gevallen alarm geslagen. In 2019 kreeg een school in Jinhua, China, kritiek nadat ze EEG-hoofdbanden had uitgeprobeerd die de concentratieniveaus van haar leerlingen monitorden.

(De studenten werden aangemoedigd om te concurreren om te zien wie zich het meest effectief kon concentreren, en rapporten werden naar hun ouders gestuurd.) Op dezelfde manier meldde de South China Morning Post in 2018 dat tientallen fabrieken en bedrijven ‘hersenbewakingsapparatuur’ waren gaan gebruiken om werknemers te monitoren. ‘ emoties, in de hoop de productiviteit te verhogen en de veiligheid te verbeteren. De apparaten “veroorzaakten in het begin wat ongemak en weerstand”, vertelde Jin Jia, destijds hersenwetenschapper aan de Ningbo Universiteit, aan de verslaggever. “Na een tijdje raakten ze gewend aan het apparaat.”

Centraal in de ethische vragen waarmee Huth en Tang worstelden, was het feit dat hun decoder, in tegenstelling tot andere taaldecoders die rond dezelfde tijd werden ontwikkeld, niet-invasief was.

Maar het voornaamste probleem met zelfs apparaten met een lage resolutie is dat wetenschappers nog maar net beginnen te begrijpen hoe informatie daadwerkelijk wordt gecodeerd in hersengegevens. In de toekomst zouden krachtige nieuwe decoderingsalgoritmen kunnen ontdekken dat zelfs ruwe EEG-gegevens met lage resolutie een schat aan informatie bevatten over de mentale toestand van een persoon op het moment van verzameling. Bijgevolg kan niemand definitief weten wat ze weggeven als ze bedrijven toestaan informatie uit hun hersenen te verzamelen.

Huth en Tang concludeerden dat hersengegevens daarom streng bewaakt moeten worden, vooral op het gebied van consumentenproducten. In een artikel op Medium van afgelopen april schreef Tang dat “de decoderingstechnologie voortdurend verbetert, en dat de informatie die over een jaar via een hersenscan kan worden gedecodeerd, heel anders kan zijn dan wat er vandaag de dag kan worden gedecodeerd.

Het is cruciaal dat bedrijven transparant zijn over wat ze met hersendata willen doen en maatregelen nemen om ervoor te zorgen dat hersendata zorgvuldig worden beschermd.” (Yuste zei dat de Neurorights Foundation onlangs de gebruikersovereenkomsten van dertig neurotechbedrijven heeft onderzocht en heeft vastgesteld dat ze allemaal het eigendom van de hersengegevens van gebruikers claimen – en dat de meesten het recht claimen om die gegevens aan derden te verkopen.)

Ondanks deze zorgen blijft Huth echter en Tang beweerde dat de potentiële voordelen van deze technologieën groter waren dan de risico’s ervan, op voorwaarde dat er de juiste vangrails werden geplaatst.

Maar terwijl Huth en Tang worstelden met de ethische consequenties van hun werk, had Yuste, halverwege het land, al duidelijkheid gekregen over één ding: deze gesprekken moesten zich buiten het theoretische, het filosofische, het academische, het hypothetische bevinden. nodig om het domein van het recht te betreden.

OOP EEN HETE zomeravond in 2019 zat Yuste op de binnenplaats van een lemen hotel in het noorden van Chili met zijn goede vriend, de prominente Chileense arts en toenmalig senator Guido Girardi, terwijl hij de uitgestrekte, heldere hemel van de Atacama-woestijn observeerde en besprak: zoals ze vaak deden, de wereld van morgen.

Girardi, die elk jaar het Congreso Futuro organiseert , het meest vooraanstaande wetenschaps- en technologie-evenement van Latijns-Amerika, was al lange tijd geïntrigeerd door de steeds snellere vooruitgang van de technologie en de paradigma-veranderende impact ervan op de samenleving – ‘leven in de wereld met de snelheid van het licht’, zoals hij noemde het. Yuste was een veelgevraagd spreker op de conferentie, en de twee mannen deelden de overtuiging dat wetenschappers technologieën voortbrachten die krachtig genoeg waren om het idee van wat het betekende om mens te zijn, te ontwrichten.

Rond middernacht, toen Yuste klaar was met zijn pisco sour, deed Girardi een intrigerend voorstel: wat als ze zouden samenwerken om een amendement op de Chileense grondwet aan te nemen, een amendement dat de bescherming van de mentale privacy zou verankeren als een onschendbaar recht van elke Chileen?

Het was een ambitieus idee, maar Girardi had ervaring met het verplaatsen van gedurfde stukken wetgeving door de senaat; Jaren eerder had hij het voortouw genomen bij de beroemde Chileense voedseletiketterings- en reclamewet, die bedrijven verplichtte gezondheidswaarschuwingen op junkfood aan te brengen. (De wet heeft sindsdien tientallen landen geïnspireerd om soortgelijke wetgeving na te streven.)

Met BCI was hier nog een kans om een pionier te zijn. “Ik zei tegen Rafael: ‘Waarom creëren we niet de eerste wet op de bescherming van neurogegevens?'” herinnerde Girardi zich. Yuste was het daar meteen mee eens.

Niemand kan definitief weten wat ze weggeven als ze bedrijven toestaan informatie uit hun hersenen te verzamelen.

In de daaropvolgende jaren reisde Yuste herhaaldelijk naar Chili, waar hij als technisch adviseur voor Girardi’s politieke inspanningen diende. Een groot deel van zijn tijd besteedde hij aan het simpelweg vergroten van het bewustzijn over de kwestie – hij sprak op universiteiten, nam deel aan debatten, gaf persconferenties en ontmoette belangrijke mensen, waaronder, zei Yuste, een gesprek van drie uur met de toenmalige president van Chili. , Sebastián Piñera.

Zijn belangrijkste rol was echter het begeleiden van de advocaten die de wetgeving opstelden. ‘Zij wisten niets van neurowetenschappen of medicijnen, en ik wist niets van de wet,’ herinnerde Yuste zich. “Het was een prachtige samenwerking.”

Ondertussen leidde Girardi de politieke druk en promootte hij een stuk wetgeving dat de grondwet van Chili zou wijzigen om de mentale privacy te beschermen. De inspanning vond verrassend succes in het hele politieke spectrum, een opmerkelijke prestatie in een land dat bekend staat om zijn politieke polarisatie. In 2021 keurde het Chileense congres unaniem de grondwetswijziging goed, die Piñera snel in de wet ondertekende. (Een tweede stuk wetgeving, dat een regelgevend raamwerk voor neurotechnologie zou creëren, wordt momenteel bestudeerd door het Chileense congres.)

“Er was geen kloof tussen links en rechts”, herinnerde Girardi zich. “Dit was misschien wel de enige wet in Chili die met algemene stemmen werd goedgekeurd.” Chili was dus het eerste land ter wereld geworden dat ‘neurorechten’ in zijn wettelijke code verankerde.

De klinkende wetgevende overwinning in Chili was een bemoedigende eerste stap voor de beginnende neurorechtenbeweging. Maar Yuste en Girardi beseften ook de beperkingen van wettelijke bescherming op nationaal niveau. Toekomstige technologieën, legde Girardi uit, zouden gemakkelijk grenzen overschrijden – of geheel buiten de fysieke ruimte bestaan – en zouden zich te snel ontwikkelen om democratische instellingen niet bij te kunnen houden.

Democratieën zijn traag, zei hij. Het duurt jaren om een wet aan te nemen en “we zien de snelheid waarmee de wereld verandert. Het is exponentieel.” Nationale regelgeving zou een aantal nuttige juridische vangrails kunnen bieden, beseften Yuste en Girardi, maar die zouden op zichzelf niet voldoende zijn.

Voormalig Chileense senator Guido Girardi in zijn kantoor in Santiago in december. Girardi en Yuste werkten samen om de grondwet van Chili te wijzigen om de mentale privacy te beschermen. Democratieën zijn traag, zei hij. Het duurt jaren om een wet aan te nemen en “we zien de snelheid waarmee de wereld verandert. Het is exponentieel.”

Zelfs vóór de goedkeuring van de Chileense grondwetswijziging had Yuste regelmatig ontmoetingen gehad met Jared Genser, een internationale mensenrechtenadvocaat die spraakmakende cliënten als Desmond Tutu, Liu Xiaobo en Aung San Suu Kyi had vertegenwoordigd. (The New York Times Magazine noemde Genser ooit ‘de uitvoerder’ van zijn werk met politieke gevangenen.) Yuste zocht advies over hoe hij een internationaal juridisch raamwerk kon ontwikkelen om neurorechten te beschermen, en Genser, ook al had hij slechts een vluchtige kennis van neurotechnologie, was meteen gefascineerd door het onderwerp.

“Het is eerlijk om te zeggen dat hij me tijdens het eerste uur van de discussie verbijsterde”, herinnert Genser zich. Kort daarna lanceerden Yuste, Genser en een ondernemer uit de particuliere sector, Jamie Daves genaamd, de Neurorights Foundation, een non-profitorganisatie wiens eerste doel, volgens de website, is “de mensenrechten van alle mensen te beschermen tegen mogelijk misbruik of misbruik van neurotechnologie. .”

Om dit te bereiken heeft de organisatie geprobeerd alle lagen van de samenleving erbij te betrekken, van de Verenigde Naties en regionale bestuursorganen zoals de Organisatie van Amerikaanse Staten, tot nationale regeringen, de technische industrie, wetenschappers en het grote publiek. Zo’n brede aanpak, zei Genser, ‘is misschien waanzin van onze kant, of grootsheid. Maar toch, weet je, het is absoluut het Wilde Westen als het gaat om het praten over deze kwesties wereldwijd, omdat zo weinig mensen weten waar de dingen zijn, waar ze naartoe gaan en wat nodig is.

Dit algemene gebrek aan kennis over neurotechnologie, in alle lagen van de samenleving, heeft Yuste grotendeels in de rol van mondiale opvoeder geplaatst – hij heeft bijvoorbeeld verschillende keren ontmoetingen gehad met VN-secretaris-generaal António Guterres om de potentiële gevaren van de opkomende neurotechnologie te bespreken.

En deze inspanningen beginnen resultaat op te leveren. Het rapport van Guterres uit 2021, ‘Onze Gemeenschappelijke Agenda’, waarin doelen voor toekomstige internationale samenwerking worden uiteengezet, dringt aan op ‘het bijwerken of verduidelijken van onze toepassing van mensenrechtenkaders en -normen om grensproblemen aan te pakken’, zoals ‘neurotechnologie’. Genser schrijft de opname van deze taal in het rapport toe aan de inspanningen van Yuste.

Maar het actualiseren van de internationale mensenrechtenwetgeving is lastig, en zelfs binnen de Neurorights Foundation bestaan er meningsverschillen over de meest effectieve aanpak. Voor Yuste zou de ideale oplossing de oprichting zijn van een nieuw internationaal agentschap, vergelijkbaar met het Internationaal Atoomenergieagentschap – maar dan voor neurorechten.

“Mijn droom zou zijn om een internationale conventie over neurotechnologie te hebben, net zoals we er een hadden over atoomenergie en over bepaalde zaken, met een eigen verdrag,” zei hij. “En misschien een agentschap dat in wezen toezicht zou houden op de inspanningen van de wereld op het gebied van neurotechnologie.”

Genser is echter van mening dat een nieuw verdrag niet nodig is, en dat neurorechten het meest effectief kunnen worden gecodificeerd door de interpretatie van de bestaande internationale mensenrechtenwetgeving uit te breiden tot deze rechten. Het Internationaal Verdrag voor Burgerrechten en Politieke Rechten waarborgt bijvoorbeeld al het algemene recht op privacy, en een bijgewerkte interpretatie van de wet zou mogelijk kunnen verduidelijken dat die clausule zich ook uitstrekt tot mentale privacy.

Het voordeel van het uitbreiden van de interpretatie van bestaande wetten, legde Genser uit, is dat ondertekenaars van deze verdragen verplicht zouden zijn om hun binnenlandse wetten onmiddellijk in overeenstemming te brengen met de nieuwe interpretaties – een manier om tegelijkertijd actie op het gebied van neurorechten op internationaal en nationaal niveau te stimuleren.

In het geval van het ICCPR, zei Genser, “zou er voor alle staten – meer dan 170 staten die partij zijn bij dat verdrag – een duidelijke implicatie zijn dat ze nu een binnenlands recht op geestelijke privacy moeten bieden om te voldoen aan hun verplichtingen onder het Verdrag.”

Maar ook al gelooft Genser dat deze weg de snelste weg zou zijn naar het verankeren van neurorechten in het internationaal recht, het proces zou niettemin jaren duren – eerst voordat de verschillende verdragsorganen hun interpretaties zouden actualiseren, en vervolgens voordat de nationale regeringen hun nationale wetten zouden moeten proberen na te leven. . Juridische vangrails lopen altijd achter op de technologische vooruitgang, maar dit zou vooral problematisch kunnen worden door het steeds snellere tempo van de neurotech-ontwikkeling.

Deze vertraging is zeer problematisch voor mensen als Girardi, die zich afvragen of de instellingen in staat zijn de komende veranderingen te weerstaan. Hoe kan de wet tenslotte standhouden als mensen met de snelheid van het licht in de wereld leven?

BMAAR TERWIJL YUSTE en de anderen blijven worstelen met de complexiteit van het internationale en nationale recht, hebben Huth en Tang ontdekt dat, althans voor hun decoder, de grootste privacybarrières niet van externe instellingen komen, maar eerder van iets dat veel dichter bij huis ligt – de menselijke geest zelf.

Na het aanvankelijke succes van hun decoder, toen het tweetal veel las over de ethische implicaties van een dergelijke technologie, begonnen ze manieren te bedenken om de grenzen van de mogelijkheden van de decoder te beoordelen. “We wilden een aantal principes van mentale privacy testen”, zegt Huth. Simpel gezegd wilden ze weten of de decoder weerstand kon bieden.

Eind 2021 begonnen de wetenschappers nieuwe experimenten uit te voeren. Ten eerste waren ze benieuwd of een algoritme dat op de ene persoon was getraind, op een andere persoon kon worden gebruikt. Ze ontdekten dat dit niet mogelijk was: de doeltreffendheid van de decoder hing af van vele uren geïndividualiseerde training. Vervolgens testten ze of de decoder van de kaart kon worden geveegd door simpelweg te weigeren ermee samen te werken.

In plaats van zich te concentreren op het verhaal dat via hun koptelefoon afspeelde terwijl ze in de fMRI-machine zaten, werd de deelnemers gevraagd andere mentale taken uit te voeren, zoals het benoemen van willekeurige dieren of het vertellen van een ander verhaal in hun hoofd. “Beide maakten het volledig onbruikbaar”, zei Huth. “We hebben het verhaal waar ze naar luisterden niet gedecodeerd, en we konden ook niets decoderen over wat ze dachten.”

De resultaten suggereren dat nachtmerrieachtige scenario’s van niet-consensuele gedachtenlezen vooralsnog ver weg blijven. Nu deze ethische zorgen zijn afgenomen, hebben de wetenschappers hun focus verlegd naar de positieve dimensies van hun uitvinding – het potentieel ervan, bijvoorbeeld als instrument om de communicatie te herstellen.

Ze zijn begonnen samen te werken met een team van de Washington University om de mogelijkheid te onderzoeken van een draagbaar fNIRS-systeem dat compatibel is met hun decoder, wat in de nabije toekomst misschien de deur opent naar concrete medische toepassingen.

Toch erkent Huth grif de waarde van dystopische prognoses, en hoopt dat dit zo zal blijven. ‘Ik waardeer het dat mensen met nieuwe slechte scenario’s blijven komen’, zei hij. “Dit is iets wat we moeten blijven doen, toch? Denkend aan ‘hoe kunnen deze dingen misgaan? Hoe konden ze goed gaan, maar ook hoe konden ze fout gaan?’ Dit is belangrijk om te weten.”

Voor Yuste kunnen technologieën als de decoder van Huth en Tang echter slechts het begin markeren van een verbijsterend nieuw hoofdstuk in de geschiedenis van de mensheid, waarin de grens tussen menselijke hersenen en computers radicaal zal worden hertekend – of volledig zal worden uitgewist. Er is een toekomst denkbaar, zei hij, waarin mensen en computers permanent samensmelten, wat zou leiden tot de opkomst van technologisch verbeterde cyborgs.

“Als deze tsunami ons treft, denk ik dat het niet waarschijnlijk is dat mensen uiteindelijk zichzelf – wijzelf – zullen transformeren in misschien een hybride soort,” zei Yuste. Hij concentreert zich nu op de voorbereiding op deze toekomst.

“Ook al is het nu nog rudimentair, waar zal dat over vijf jaar zijn? Wat was vijf jaar geleden mogelijk? Wat is nu mogelijk? Waar zal het over vijf jaar zijn? Waar zal het over tien jaar zijn?”

De afgelopen jaren is Yuste naar meerdere landen gereisd, waar hij een breed scala aan politici, rechters van het Hooggerechtshof, leden van de VN-commissie en staatshoofden heeft ontmoet. En zijn pleidooi begint vruchten af te werpen . In augustus begon Mexico een constitutionele hervorming te overwegen die het recht op mentale privacy zou vestigen. Brazilië overweegt momenteel een soortgelijk voorstel, terwijl Spanje, Argentinië en Uruguay ook interesse hebben getoond, net als de Europese Unie.

In september werden neurorechten officieel opgenomen in het Mexicaanse handvest voor digitale rechten, terwijl in Chili een baanbrekende uitspraak van het Hooggerechtshof oordeelde dat Emotiv Inc, een bedrijf dat een draagbare EEG-headset maakt, de nieuwe Chileense privacywet overtrad. Die rechtszaak was aangespannen door Yuste’s vriend en medewerker, Guido Girardi.

Het energieke tempo van Yuste’s belangenbehartigingswerk wordt misschien ingegeven door de overtuiging dat de tijd om te handelen snel sluit, dat de wereld van morgen niet langer aan een verre horizon opdoemt. “Ze vroegen mij vaak: ‘Wanneer moeten we ons zorgen maken over de mentale privacy?’” herinnert hij zich. “Ik zou zeggen: ‘Vijf jaar.’ ‘En hoe zit het met zorgen over onze vrije wil?’ Ik zei: ‘Over tien jaar.’ Nou raad eens? Ik had het fout.”

Huth is het ermee eens dat het nu tijd is voor actie. Deze technologieën staan misschien nog in de kinderschoenen, legde hij uit, maar het is veel beter om proactief te zijn in het instellen van mentale bescherming dan te wachten tot er iets vreselijks gebeurt.

“Dit is iets dat we serieus moeten nemen”, zei hij. “Want ook al is het nu nog rudimentair, waar zal dat over vijf jaar zijn? Wat was vijf jaar geleden mogelijk? Wat is nu mogelijk? Waar zal het over vijf jaar zijn? Waar zal het over 10 jaar zijn? Ik denk dat het scala aan redelijke mogelijkheden dingen omvat die – ik wil niet zeggen dat ze eng genoeg zijn – maar dystopisch genoeg zijn dat ik denk dat het zeker een tijd voor ons is om hierover na te denken.