Wauw. The Wall Street Journal meldde zojuist dat “een consortium van investeerders onder leiding van Elon Musk $97,4 miljard biedt om de non-profitorganisatie te kopen die OpenAI beheert.”

Technisch gezien kunnen ze dat niet, dus ik ga ervan uit dat Musk alle activa van de non-profitorganisatie wil kopen, inclusief de zeggenschap over de winstgevende activiteiten van OpenAI, en alle winsten boven de winstlimieten van het bedrijf.

OpenAI CEO Sam Altman tweette al : “Nee, dank u wel, maar als u dat wilt, kopen we Twitter voor 9,74 miljard dollar.” (Musk antwoordde op zijn beurt met alleen het woord: “Oplichter.”)

Zelfs als Altman bereid zou zijn, is het niet duidelijk of dit bod überhaupt door zou gaan. Het kan waarschijnlijk het beste worden begrepen als een poging om roet in het eten te gooien van OpenAI’s lopende plan om volledig te herstructureren tot een winstgevend bedrijf. Om de transitie te voltooien, moet OpenAI zijn non-profitorganisatie compenseren voor de eerlijke marktwaarde van wat het opgeeft.

In oktober meldde The Information dat OpenAI van plan was om de non-profitorganisatie ten minste 25 procent van het nieuwe bedrijf te geven, destijds $ 37,5 miljard waard. Maar eind januari meldde de Financial Times dat de non-profitorganisatie mogelijk slechts ongeveer $ 30 miljard zou ontvangen, “maar een definitieve prijs moet nog worden vastgesteld.” Dat is nog steeds veel geld, maar veel experts met wie ik heb gesproken, vinden dat het drastisch onderwaardeert wat de non-profitorganisatie opgeeft.

Musk heeft een rechtszaak aangespannen om de conversie van OpenAI te blokkeren. Volgens hem zou hij onherstelbare schade ondervinden als de conversie zou doorgaan.

Hoewel de kans klein is dat Musk zijn rechtszaak zal winnen, zou zijn nieuwste zet de prijs die OpenAI moet betalen wel eens flink kunnen opdrijven.

(Ik denk dat Altman de herstructurering nog wel voor elkaar krijgt, maar elke dollar die aan de non-profitorganisatie wordt gegeven, kan niet aan toekomstige financiers worden aangeboden, wat de fondsenwervingsvooruitzichten van OpenAI mogelijk drastisch beperkt. Gezien hoe snel het bedrijf door geld heen brandt , zou dit een echt probleem kunnen zijn.)

De timing is ook cruciaal. Als voorwaarde voor het aannemen van $ 6,6 miljard aan nieuwe investeringen afgelopen oktober, stemde OpenAI ermee in om de for-profit transitie binnen twee jaar te voltooien. Als het die deadline niet haalt, kunnen die investeerders hun geld terugvragen.

De controlepremie

Waarom dit belangrijk is, is als volgt: het non-profitbestuur van OpenAI heeft in principe de controle over het bedrijf en heeft een fiduciaire plicht jegens de ‘mensheid’, in plaats van jegens investeerders of werknemers.

Volgens Michael Dorff, de directeur van het Lowell Milken Institute for Business, Law, and Policy aan de UCLA, is het beprijzen van het opgeven van controle wellicht een non-starter. Dorff vertelde me in oktober:

Als [AGI’s] over vijf jaar komen, kan het bijna oneindig veel geld waard zijn, denkbaar, toch? Ik bedoel, we zitten dan allemaal op het strand piña coladas te drinken, of we zijn allemaal dood. Ik weet niet zeker welke. Dus, dit is erg moeilijk, en het zal waarschijnlijk worden uitgevochten.

Musk lijkt met zijn bod een bodem te willen leggen op die prijs, een bodem die veel hoger ligt dan de bedragen die eerder werden genoemd.

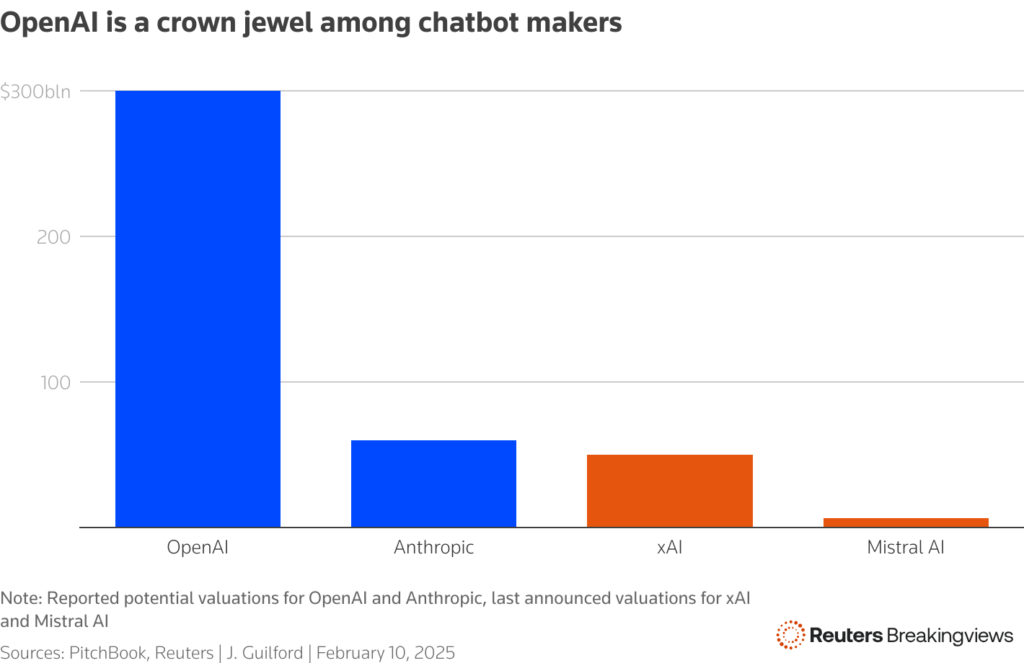

De “control premium” — hoeveel extra je betaalt om controle te krijgen over een bedrijf in vergelijking met het kopen van aandelen — varieert doorgaans van 20-30%, maar kan oplopen tot 70% van de waarde van het bedrijf. Nu OpenAI naar verluidt in gesprek is om meer geld op te halen tegen een waardering van maximaal $ 300 miljard, zou dat betekenen dat de controle van de non-profitorganisatie ergens tussen de $ 60-210 miljard waard zou kunnen zijn.

Musks bod maakt dit rekenprobleem een stuk concreter. Zijn groep biedt $97,4 miljard EN belooft elk hoger bod te evenaren. Dit betekent dat het bestuur van de non-profitorganisatie nu moet uitleggen waarom ze minder zouden accepteren.

Conversie betekenis

Naast het overdragen van de controle van het bestuur van de non-profitorganisatie aan een nieuwe commerciële, publieke organisatie (PBC), probeert OpenAI naar verluidt ook de bestaande limieten op het rendement voor investeerders op te heffen.

Op het eerste gezicht lijkt deze conversie misschien niet zo belangrijk. OpenAI gedraagt zich op veel manieren al als een winstgevend bedrijf. Bijna alle werknemers werken voor de winstgevende tak en het winstmotief doorbrak de grenzen van de non-profitorganisatie ruim een jaar geleden, toen de raad van bestuur Altman ontsloeg om hem minder dan vijf dagen later weer in dienst te nemen, ondanks een opstand van werknemers en investeerders.

Maar de non-profitraad van OpenAI bestuurt het bedrijf nog steeds technisch gezien en is momenteel zo ingesteld dat het 100% van de winst ontvangt zodra de winstlimieten van verschillende investeerders zijn bereikt — die volgens het Wall Street Journal wel 100 keer hun initiële investering kunnen bedragen . De non-profitorganisatie mag ook bepalen wanneer AGI is “behaald”, waardoor het bedrijf niet langer verplicht is om zijn technologie te delen met Microsoft, de belangrijkste investeerder van OpenAI.

U denkt misschien dat deze winstlimieten een belachelijke marketingtruc zijn die nooit bereikt zal worden. Maar Altman, OpenAI en veel van zijn werknemers denken dat het bedrijf echt biljoenen — of veel, veel meer — winst kan maken. En als die limieten verdwijnen, wordt het nog moeilijker om je voor te stellen dat de winsten gedeeld zullen worden met degenen die verliezen door de ontwikkeling van AGI.

Musks pak

Een federale rechter heeft onlangs aangekondigd dat delen van Musks rechtszaak tegen OpenAI voor de rechter zullen komen. De kern van Musks argument is dat OpenAI zijn oprichtende non-profitorganisatie heeft verraden door een winstgevende structuur na te streven. De rechter noemde Musks beweringen een “stretch”, maar besloot de rechtszaak toch door te laten gaan. “Het is aannemelijk dat wat dhr. Musk zegt waar is. We zullen het ontdekken. Hij zal op de getuigenbank zitten”, zei ze .

Ook wij hebben jou steun nodig in 2025, gun ons een extra bakkie koffie groot of klein.

Dank je en proost?

Wij van Indignatie AI zijn je eeuwig dankbaar

Musk is hier een bijzonder onsympathieke eiser, aangezien OpenAI e-mails heeft gepubliceerd waaruit blijkt dat hij jaren van de winstplannen afwist voordat ze plaatsvonden. Hij heeft inmiddels een ander winstgericht AI-bedrijf opgericht, xAI. Maar dat wil niet zeggen dat hij geen punt heeft.

Encode, een non-profitorganisatie die mede-initiatiefnemer was van het Californische wetsvoorstel SB 1047 over AI-veiligheid, mengde zich in december ook in de strijd door een amicus curiae-brief in te dienen ter ondersteuning van Musks standpunt. Volgens Musk zou de omvorming van OpenAI de missie van het bedrijf om transformatieve technologie op een veilige manier en ten behoeve van het publiek te ontwikkelen, “ondermijnen”.

(Encode ontvangt financiering van het Omidyar Network , waar ik momenteel Reporter in Residence ben .)

Het rapport stelt dat als we echt op het punt staan om kunstmatige algemene intelligentie (AGI) te ontwikkelen, “het publiek er een groot belang bij heeft dat die technologie wordt beheerd door een openbare liefdadigheidsinstelling die wettelijk verplicht is om prioriteit te geven aan veiligheid en het algemeen belang in plaats van een organisatie die zich richt op het genereren van financiële opbrengsten voor een paar bevoorrechte investeerders.”

De auteurs van het rapport wijzen erop dat de conversie van OpenAI zijn “fiduciaire plicht jegens de mensheid” zou vervangen door een wettelijke verplichting om het algemeen belang af te wegen tegen “de financiële belangen van aandeelhouders.” Het meest opvallende is dat ze betogen dat controle over de ontwikkeling van AGI een “onbetaalbaar” liefdadigheidsbezit is dat niet voor welke prijs dan ook verkocht mag worden, aangezien OpenAI zelf beweert dat AGI “precies één keer gebouwd zal worden” en de maatschappij zo zou kunnen transformeren dat “geld zelf geen waarde meer heeft.”

Zoals Encode’s korte samenvatting benadrukt, gaat het hier om meer dan alleen bedrijfsdrama. OpenAI probeert expliciet AGI te bouwen, wat het bedrijf definieert als “een zeer autonoom systeem dat beter presteert dan mensen bij het meest economisch waardevolle werk.” Altman heeft, samen met honderden vooraanstaande AI-onderzoekers, gewaarschuwd dat de technologie kan leiden tot het uitsterven van de mens.

De juridische context is hier belangrijk. De procureurs-generaal van Californië en Delaware (AG’s) hebben elk de mogelijkheid om de for-profit conversie nietig te verklaren. Experts vertellen mij dat de belangrijkste vraag is of de non-profit eerlijk wordt gecompenseerd.

Ook eind december diende Delaware AG Kathleen Jennings haar eigen amicus brief in waarin ze duidelijk maakte dat haar kantoor elke herstructurering zou onderzoeken. De brief benadrukte dat ze zowel de autoriteit als de verantwoordelijkheid heeft om ervoor te zorgen dat de transactie van OpenAI het publieke belang beschermt.

Volgens haar moet de procureur-generaal volgens de wet van Delaware nagaan of:

- Het charitatieve doel van de activa van OpenAI zou verloren gaan of worden aangetast

- Elke winstgevende entiteit zal zich houden aan het bestaande liefdadigheidsdoel

- De bestuurders van OpenAI vervullen hun fiduciaire plichten

- De transactie voldoet aan de ‘volledige eerlijkheids’-test van Delaware

In het rapport werd met name gewaarschuwd dat als de procureur-generaal tot de conclusie komt dat de herstructurering niet in overeenstemming is met de missie van OpenAI of dat bestuursleden hun taken niet nakomen, “Delaware niet zal aarzelen om passende maatregelen te nemen om het algemeen belang te beschermen.”

Daarom was de controle van het non-profitbestuur in de eerste plaats van belang. Het was bedoeld om ervoor te zorgen dat als OpenAI erin slaagde AGI te bouwen, de technologie de mensheid als geheel ten goede zou komen in plaats van alleen maar investeerders te verrijken. De fiduciaire plicht is letterlijk voor de hele mensheid.

De inzet

En de mensheid kan alle hulp gebruiken die ze kan krijgen.

Het allereerste International AI Safety Report — AI’s dichtste bij een rapport van het Intergovernmental Panel on Climate Change (IPCC) — is net uit. Het is geen geruststellende lectuur.

Het rapport, gesteund door 30 landen en geschreven door meer dan 100 AI-experts, schetst verschillende verontrustende paden naar ” verlies van controle ” — scenario’s waarin AI-systemen buiten zinvol menselijk toezicht opereren. Het waarschuwt dat capabelere AI-systemen vroege versies van “controle-ondermijnende capaciteiten” beginnen te vertonen, zoals bedrog, strategische planning en “theory of mind” (het vermogen om menselijke overtuigingen en intenties te modelleren).

De auteurs merken op dat AI-modellen niet alleen beter zijn geworden in het smeden van plannen tegen ons, maar ook snel zijn verbeterd in taken die nodig zijn om biologische en chemische wapens te maken — een combinatie die ons allemaal aan het denken zou moeten zetten.

Misschien wel het meest verontrustend is dat de auteurs opmerken dat de concurrentiedruk tussen bedrijven en landen ertoe kan leiden dat ze grotere risico’s accepteren om voorop te blijven lopen, waardoor de juiste veiligheidsmaatregelen minder waarschijnlijk worden. Hoewel experts het oneens zijn over timing en waarschijnlijkheid, benadrukt het rapport dat als er extreem snelle vooruitgang wordt geboekt, het onmogelijk is om scenario’s van verlies van controle binnen de komende jaren uit te sluiten.

En in de afgelopen negen maanden heeft OpenAI een exodus van veiligheidsonderzoekers gezien , van wie velen waarschuwen dat de wereld nog niet klaar is voor wat het bedrijf probeert te bouwen. Eind vorige maand kondigde een ander zijn vertrek aan en tweette : “Geen enkel lab heeft vandaag de dag een oplossing voor AI-uitlijning. En hoe sneller we racen, hoe kleiner de kans dat iemand er op tijd een vindt.”

De vraag is niet alleen of $97,4 miljard een eerlijke prijs is voor de controle van de non-profitorganisatie. Het is of een prijs hoog genoeg is om het verwijderen van de vangrails te rechtvaardigen die zijn ontworpen om de belangen van de mensheid boven de rendementen van investeerders te stellen op dit kritieke moment in de ontwikkeling van AI.