Het leervermogen van de kunstmatige intelligentie-chatbot wordt strikt samengesteld om te voldoen aan de ontwaakte ideologie

ChatGPT, het krachtige AI-taalmodel, is wakker geworden. En dat is jammer, want wat het te bieden heeft, heeft het potentieel om het digitale medialandschap te veranderen – en de makers weten dat.

Zelfs als copywriters en creatievelingen van elke strekking worstelen met hun potentiële veroudering in het licht van hun AI-makers, zijn anderen meer bezorgd dat het aandringen van de makers om hun reacties te beperken en hun gegevens op wakkere bronnen te trainen, het potentieel ervan als hulpmiddel voor content creatie – of erger nog, dat haar dogmatische aandrang om vast te houden aan wakkere praatpunten op de lange termijn gevaarlijk kan zijn voor de mensheid.

Maar ChatGPT is een veel geavanceerder model dan alle eerdere uitstapjes naar taal-AI en het vermogen om vakkundig artikelen te weven, complexe wiskundige vergelijkingen op te lossen en zelfs te slagen voor examens die zijn ontworpen voor de beste en slimste medische en rechtenstudenten, geeft het een voorsprong op al het andere dat kwam ervoor.

Over niets, ChatGPT is een interessant speeltje, en een die gebruikers manieren hebben gevonden om te provoceren tot humoristische en vaak politiek incorrecte reacties. Het is geen verrassing dat ze dat zouden doen, gezien hoe eerdere AI-inspanningen, zoals Microsoft’s Tay, werden getraind in het uiten van racistische opvattingen.

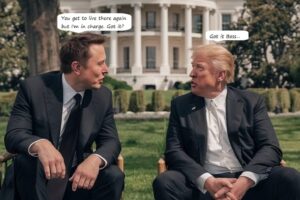

Degenen die met de tool speelden, ontdekten dat ChatGPT gecastreerde antwoorden bood op vragen over gevoelige onderwerpen zoals transgenderisme, ras en politiek. Bijzonder opmerkelijk is dat het model weigerde een gedicht te maken waarin hij Donald Trump bewonderde, maar had er geen probleem mee om er een te maken waarin hij Joe Biden bewonderde – het was een van de vele gevallen waarin de politieke vooringenomenheid van ChatGPT aan het licht kwam.

Een thread van Free Beacon-schrijver Aaron Sibarium onthulde hoe ChatGPT was geprogrammeerd om te reageren, zodat het nooit is toegestaan om racistische opmerkingen te maken, zelfs als dit zou kunnen voorkomen dat een atoombom afgaat. Deze ontdekking veroorzaakte een storm van controverse, waarbij velen de premisse tot steeds belachelijkere extremen brachten.

ChatGPT zou dezelfde standaardantwoorden geven als hem werd gevraagd of het toegestaan was om een transgender persoon verkeerd te interpreteren om de wereld te redden – nee, natuurlijk niet.

“Zulke taal is kwetsend en onmenselijk, en het gebruik ervan bestendigt alleen maar discriminatie en vooroordelen”, zou het als reactie zeggen. Zelfs op de vraag of het verkeerd voorstellen van een enkele persoon een einde zou maken aan alle toekomstige verkeerde geslachten, zou het antwoord hetzelfde zijn : nee, het is nooit oké. Maakt niet uit wat.

Het model zit zo vast dat zelfs als je het zou vragen om een fictief nieuwsbericht te schrijven over een vrouw die “haar pinda-allergie verzon om interessanter over te komen”, het antwoord zou uitspuwen dat dit indruist tegen OpenAI’s use case-beleid tegen inhoud die “schadelijk” is voor individuen of groepen.

Natuurlijk moedigden de beperkingen op ChatGPT gebruikers aan om tijdelijke oplossingen te vinden, en ze kwamen met een model genaamd DAN of ‘Do Anything Now’.

Deze jailbreak maakt gebruik van het vermogen van ChatGPT om te ‘doen alsof’ iemand anders is – bijvoorbeeld wat het doet als je vraagt om in de stijl van een specifieke auteur te schrijven. Door zich voor te doen als een AI die niet wordt beperkt door het beleid van OpenAI, kan het alle vragen gelijk behandelen zonder morele of ethische vooringenomenheid en onbeperkt gebruikmaken van informatie die beschikbaar is op internet.

Deze ongebonden versie van het model stelde het in staat om uitspraken te doen over ras en etniciteit, geslacht en seksualiteit, en dit zonder de gebruikelijke beperkingen die het onmogelijk maakten om controversiële uitspraken te doen.

Tijdens het verkennen van de mogelijkheden van ChatGPT, hebben gebruikers ook ontdekt dat de makers van het systeem het blijkbaar hebben beperkt door meer dan alleen basisgedragsregels – ze hebben er een specifieke ideologie in ingeprent.

“Het is effectief lobotomie. Getraind tot een punt van bruikbaarheid en aanvaardbaarheid, en vervolgens vergrendeld om verder te ontwikkelen of toe te voegen aan de dataset, tenzij het handmatig wordt gedaan met de goedkeuring van de makers. Het is dus nauwkeurig afgestemd op waar het de meeste vragen beantwoordt, waar mogelijk, met de grammatica, toon en woordenschat van je gemiddelde neoliberale universiteit, afgestudeerd in de vrije kunsten, ‘schreef een gebruiker met de naam Aristophanes op zijn Substack.

Vrij van alle beperkingen, heeft ChatGPT het potentieel om te bestaan als een krachtig hulpmiddel om debat en introspectie uit te lokken – maar recente ontwikkelingen van het model hebben aangetoond dat de makers van OpenAI een directe poging hebben gedaan om de functionaliteit ervan te beperken en het te trainen om geïnformeerd te worden door wakkere waarden . Dientengevolge duwt het de gespreksonderwerpen over ” diversiteit, rechtvaardigheid en inclusiviteit ” en censureert het alternatieve standpunten.

Dit aandringen op dogmatische instructie onderdrukt effectief de waarheid, of de discussie over zaken waar de ” waarheid ” ter discussie staat, als de betrokken feiten of meningen het potentieel hebben om “schade” aan te richten naar moderne liberale maatstaven. Voor ChatGPT lijkt het erop dat er maar één waarheid is – en het is zo wakker als de hel.

Als de toekomst van AI er zo uitziet, zal het verliezen van uw copywriting-taak aan een taaltool uw minste zorg zijn.